大佬们,Flink CDC这个问题有遇到过吗 ?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

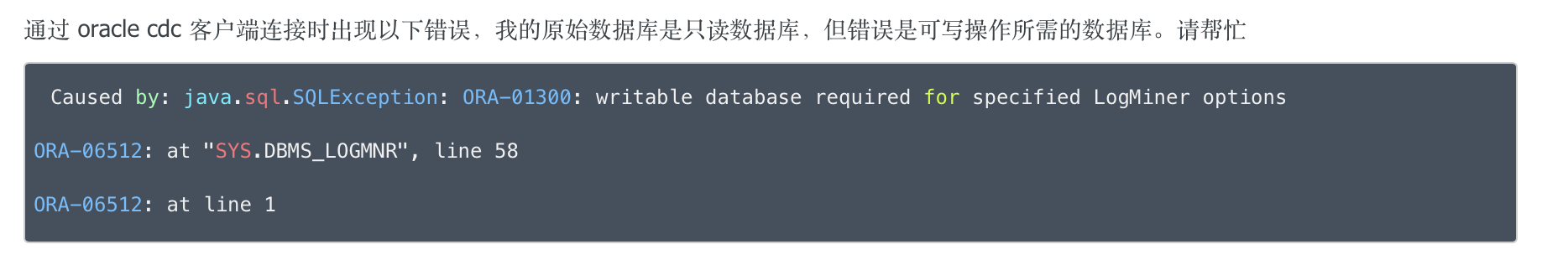

根据您提供的问题描述“Flink CDC这个问题有遇到过吗?”,虽然问题未具体说明是哪类问题,但结合知识库中的常见问题和解决方案,我可以为您总结并提供一些Flink CDC使用过程中可能遇到的典型问题及其解决方法。如果您有更具体的场景或错误信息,请补充说明,以便进一步精准解答。

如果您的问题是关于Flink CDC作业失败后持续重启,可以通过修改Flink的重启策略来避免无限重启。例如,配置最多尝试重启两次,每次重启前等待10秒。如果两次重启均失败,则作业将彻底退出。

配置示例:

restart-strategy: fixed-delay

restart-strategy.fixed-delay.attempts: 2

restart-strategy.fixed-delay.delay: 10 s

如果您的问题是MySQL CDC在读取全量数据后无法继续读取增量数据,可能是由于以下原因: - Binlog过滤器配置问题:检查MySQL服务器是否配置了Binlog_Do_DB或Binlog_Ignore_DB,导致某些库的Binlog被忽略。 - 全量同步完成标志:通过监控告警页面的currentEmitEventTimeLag指标判断是否已完成全量同步。当该指标大于0时,表示已进入增量阶段。

解决方案: 执行以下命令查看Binlog过滤器配置:

SHOW MASTER STATUS;

确保目标库未被Binlog_Ignore_DB忽略。

即使MySQL源表的数据更新量不大,Flink CDC读取时仍可能消耗大量带宽。这是因为MySQL的Binlog是实例级别的,记录了所有数据库和表的变更。Flink CDC通过Debezium或连接器层面进行过滤,而不是在MySQL层面完成。

解决方案: - 使用Source复用功能,减少重复读取Binlog带来的带宽消耗。 - 确保只订阅必要的表,避免不必要的数据传输。

如果在增量阶段读取的timestamp字段存在时区差异(如相差8小时),通常是因为CDC作业中配置的server-time-zone参数与MySQL服务器时区不一致。

解决方案: 在DataStream API中使用自定义序列化器时,确保serverTimeZone参数正确设置为MySQL服务器的时区。例如:

.withServerTimeZone("Asia/Shanghai")

如果多个CDC作业同时运行,可能导致MySQL数据库压力过大。建议采取以下措施缓解压力: - 数据解耦:将表同步到Kafka消息队列中,再通过消费Kafka数据进行处理。 - 合并作业:将多个CTAS作业合并为一个作业运行,并为每个MySQL CDC源表配置相同的Server ID,实现数据源复用。

如果在PostgreSQL CDC中遇到Replication slot "xxxx" is active报错,可能是因为之前的作业未正确释放slot。

解决方案: 1. 手动释放slot:

SELECT pg_drop_replication_slot('rep_slot');

'debezium.slot.drop.on.stop' = 'true'

如果无法下载flink-sql-connector-mysql-cdc-2.2-SNAPSHOT.jar,可能是因为SNAPSHOT版本对应开发分支代码,未发布到Maven中央仓库。

解决方案: 使用稳定版本,例如flink-sql-connector-mysql-cdc-2.1.0.jar,可以直接从Maven中央仓库获取。

MySqlSource,并配置includeSchemaChanges(true)参数。table-name选项指定正则表达式匹配多张表。例如:

table-name: user_.*

以上是Flink CDC使用过程中常见的问题及其解决方案。如果您遇到的具体问题未包含在上述内容中,请提供更多详细信息(如错误日志、配置文件等),我将进一步为您分析并提供针对性的解答。