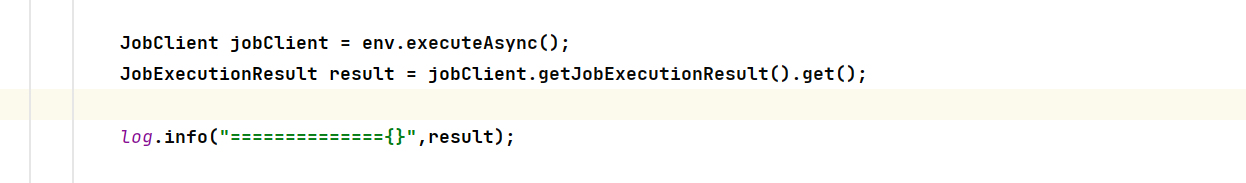

有大佬知道,Flink CDC为什么这个会一直卡住吗? 我先实现这个任务执行完了,再执行下个

我先实现这个任务执行完了,再执行下个

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

Flink CDC任务卡住的问题可能由多种原因引起,以下是一些常见的原因及对应的解决方案,基于您提供的知识库内容进行分析:

问题原因

在全量阶段,MySQL CDC源表会通过JDBC连接读取全量数据。如果数据量较大或并发度不足,可能导致读取时间过长,甚至出现内存溢出(OOM)问题,从而导致任务卡住。

解决方案

parallelism.default参数调整并发度。execution.checkpointing.interval: 5min

问题原因

如果使用的是RDS MySQL的只读实例或备库,可能会因为Binlog日志未写入或被快速清理而导致增量数据无法读取。此外,阿里云RDS MySQL默认的日志保留策略为最长18小时或占用存储空间不超过30%,满足任一条件都会触发清理。

解决方案

mysql> set global expire_logs_days=7;

问题原因

在全量阶段,如果未开启增量快照功能且触发了Checkpoint,可能会因Checkpoint超时导致任务Failover,进而卡住。

解决方案

scan.incremental.snapshot.enabled=true启用增量快照功能,避免全量阶段的Checkpoint超时问题。execution.checkpointing.tolerable-failed-checkpoints: 100

restart-strategy: fixed-delay

restart-strategy.fixed-delay.attempts: 2147483647

问题原因

如果同一作业中有多个MySQL CDC源表,每个源表都会启动一个Binlog Client,这会对数据库造成较大的连接压力,可能导致任务卡住。

解决方案

server-id实现Source复用,减少对数据库的连接压力。server-id,以减小数据库压力。问题原因

如果下游算子(如聚合或Sink)处理速度较慢,可能会导致反压传递到Source端,使Source无法正常消费Binlog数据。

解决方案

问题原因

Binlog_Do_DB或Binlog_Ignore_DB,导致某些库的Binlog被忽略。解决方案

mysql> show master status;

为了确保Flink CDC任务能够顺利完成并避免卡住问题,建议按照以下步骤操作: 1. 优化全量阶段:增加并发度、调整Checkpoint间隔时间。 2. 确保Binlog可用性:避免使用只读实例,延长Binlog保留时间。 3. 启用增量快照功能:避免全量阶段的Checkpoint超时问题。 4. 减轻数据库压力:启用Source复用功能或合并多个CDC作业。 5. 监控下游性能:优化下游算子逻辑,避免反压问题。

如果问题仍然存在,建议检查Flink作业日志中的具体错误信息,并结合上述方案逐一排查。