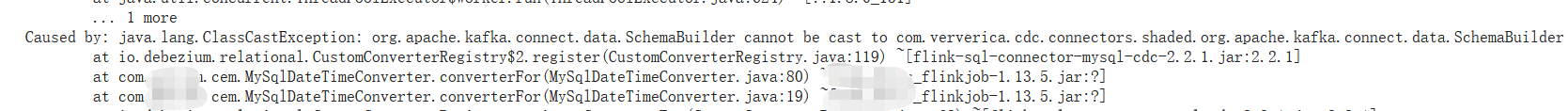

但是我看2.2.1的代码就是org.apache.kafka.connect.data.SchemaBuilder这个类

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

您提到的org.apache.kafka.connect.data.SchemaBuilder类是Kafka Connect框架中用于构建数据模式(Schema)的一个关键类。这个类主要用于定义消息中的数据结构,确保在Kafka传输过程中数据格式的一致性和可解析性。它允许用户定义字段名、字段类型以及字段的必要性等属性,从而创建出复杂的结构化数据模式。

从参考资料来看,虽然直接示例代码没有明确展示SchemaBuilder的使用,但其概念与配置实践密切相关。例如,在Debezium Connector配置中,通过value.converter.schemas.enable=false这一设置,实际上间接涉及到了对消息Value部分是否携带Schema信息的选择。当此选项设为true时,Kafka Connect在处理消息时会利用如SchemaBuilder这样的工具来构建和嵌入模式信息到消息体中,以支持更复杂的数据类型和增强的类型安全性。

而在另一份文档关于Kafka导入数据的示例中,尽管直接代码未展示SchemaBuilder的应用,但配置了key.converter和value.converter,其中value.converter=org.apache.kafka.connect.json.JsonConverter表明使用JSON转换器处理消息值。在某些场景下,如果需要自定义或更精细地控制消息的Schema,就可能需要直接操作SchemaBuilder来生成符合需求的Schema对象,并配合相应的转换器(如Avro Converter)来序列化和反序列化这些带有Schema的消息。

总结来说,尽管给出的知识库资料未直接包含org.apache.kafka.connect.data.SchemaBuilder的代码示例,该类对于理解Kafka Connect中数据模式的构建和消息处理机制至关重要。它常用于确保数据序列化与反序列化过程中的类型安全,尤其是在启用Schema Registry或者处理非字符串、非字节流等复杂数据类型时。如果您需要在项目中根据具体需求定制消息模式,可以参考Kafka Connect官方文档中关于SchemaBuilder的使用说明进行深入学习和应用。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。