版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

MongoDB作为Flink的数据源,可以使用Flink官方提供的MongoDB Connector来实现数据的读取。对于MongoDB Connector中的并行度问题,可以进行如下解释:

MongoDB Connector的并行度由Flink的并行度决定:在Flink中,每个任务并行执行的并发度由并行度参数决定。对于MongoDB Connector而言,它作为一个Flink的数据源,其并行度也受到任务的并行度参数影响。

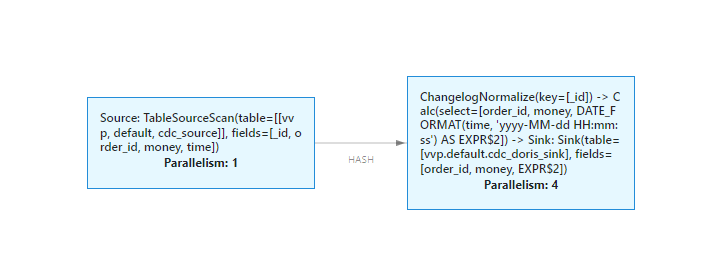

MongoDB Connector的并行度可以通过Flink的并行度参数进行调整:在Flink中,可以通过指定任务的并行度参数,来调整MongoDB Connector的并行度。例如,在使用Flink SQL读取MongoDB数据源时,可以通过在SQL语句中指定并行度参数,“WITH ( 'connector' = 'mongodb', 'hosts' = 'localhost', 'database' = 'test', 'collection' = 'collection', 'parallelism' = '4')”,来控制MongoDB Connector的并行度。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。