FlinkCDC报错:Tables were locked explicitly, but to get a consistent snapshot we cannot release the locks until we've read all tables.该如何解决呢?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

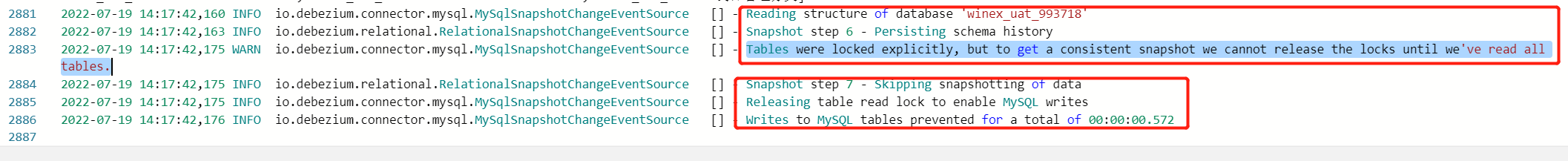

遇到Flink CDC报错信息:“Tables were locked explicitly, but to get a consistent snapshot we cannot release the locks until we've read all tables.” 这通常意味着在执行全量数据拉取时,为了保证数据的一致性,Flink对表进行了显式锁定,但在完成所有表的数据读取之前无法释放这些锁。这可能导致数据库操作受阻或作业进度停滞。以下是解决此问题的几个建议步骤:

检查并优化并发度设置:

scan.parallelism)足够高,以便更快地并行读取所有表的数据。增加并发可以加速全量快照的读取过程,从而尽早释放锁。监控与资源调整:

优化全量抽取策略:

检查表依赖关系:

调整Checkpoint策略:

故障排查与重试机制:

数据库层面的优化:

通过上述措施,可以有效应对Flink CDC在执行全量快照时遇到的锁表问题,加快数据抽取速度,减少对数据库操作的影响。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。