我正在尝试创建一个spark应用程序来对层次结构数据集进行聚合。

示例场景如下。

我有一个包含以下行的数据集 在此处输入图像描述

我有一个在我的数据库中定义的类别层次结构。我的层次结构如下

在此处输入图像描述

我需要类别层次结构中每个元素的聚合结果。

与此类似,我需要层次结构节点中所有元素的计数。

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

"我假设不存在的“父元素”是4002,因为它在您的层次结构中,而不是在您的输入中,而是在您的输出中。如果没有,你真的需要更具体。

"我假设不存在的“父元素”是4002,因为它在您的层次结构中,而不是在您的输入中,而是在您的输出中。如果没有,你真的需要更具体。

在任何情况下,您都应将“层次结构”数据集读入第二个数据框并将其连接到第一个数据框。但你必须确保它准备得当。

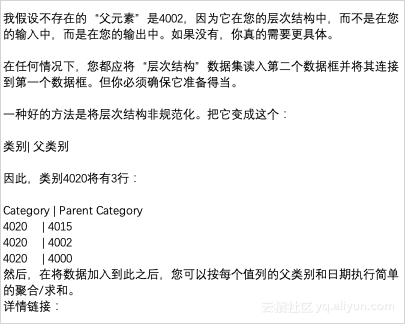

一种好的方法是将层次结构非规范化。把它变成这个:

类别| 父类别

因此,类别4020将有3行:

Category | Parent Category

4020 | 4015

4020 | 4002

4020 | 4000

然后,在将数据加入到此之后,您可以按每个值列的父类别和日期执行简单的聚合/求和。