在phoenix中建了个TEST的表,并建了个二级索引:IDX_TEST_IDS,然后插入1000条记录之后,

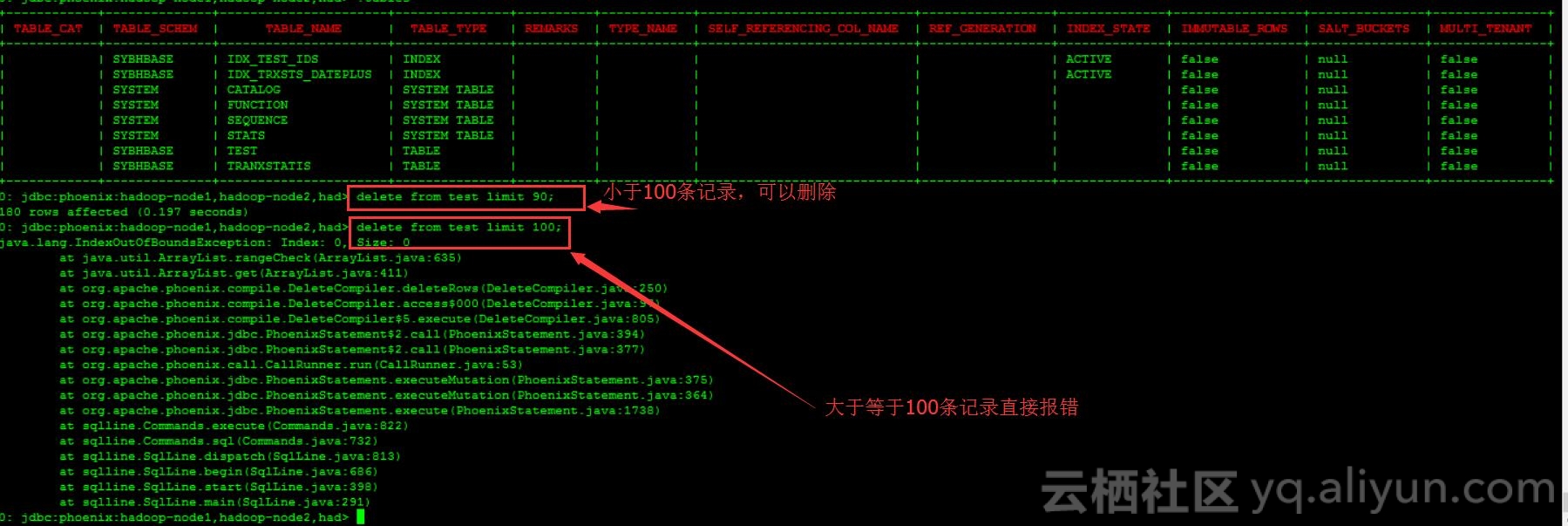

1、删除小于100条记录,操作成功!(delete from test limit 90)

2、删除大于等于100条记录,操作失败!(delete from test limit 100)

不明白为什么删除超过100条记录就会失败呢???????????求大神解答

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在Apache Phoenix中,操作行为与你描述的可能不完全符合。Phoenix 是一个基于HBase的SQL皮肤,它提供了SQL查询能力,但底层仍然是HBase,这意味着它受到HBase的一些限制和特性的约束。

关于你的问题,Phoenix 中的 DELETE 语句并不直接从HBase中移除数据行,而是通过标记这些行为删除状态(通常是在列族中添加一个删除标记或版本)。当你执行删除操作时,实际上是在更新这些行的状态,而不是物理删除记录。因此,LIMIT 子句在Phoenix的DELETE操作中并不适用,因为它是针对查询结果集的限制,在大多数SQL数据库中用于限制返回的结果数量,而不是影响DELETE操作的行数。

对于你提到的“操作成功”和“操作失败”,这可能是因为对Phoenix的误解或者执行命令的方式有误。正确的删除操作应该直接指定条件,例如根据某个字段的值来删除记录,而不是使用LIMIT。例如,如果你想删除ID小于100的所有记录,你应该这样操作:

DELETE FROM TEST WHERE id < 100;

如果遇到删除大量记录失败的情况,可能是因为HBase的限制、RegionServer的压力、或者事务日志大小等多方面因素导致。确保检查Phoenix和HBase的日志以获取更具体的错误信息,这将有助于诊断问题。

另外,如果你确实需要批量删除大量数据,考虑使用批处理工具或直接操作HBase的API来实现,同时注意监控集群资源使用情况,避免对系统造成过大压力。