此为Nginx的默认配置,让我们逐步揭开Nginx的神秘面纱。 #user nobody; worker_processes 1; #error_log logs/error.log; #error_log logs/error.log notice; #error_log logs/error.log info; #pid logs/nginx.pid; events { worker_connections 1024; } http { include mime.types; default_type application/octet-stream; #log_format main '$remote_addr - $remote_user [$time_local] "$request" ' # '$status $body_bytes_sent "$http_referer" ' # '"$http_user_agent" "$http_x_forwarded_for"'; #access_log logs/access.log main; sendfile on; #tcp_nopush on; #keepalive_timeout 0; keepalive_timeout 65; #gzip on; server { listen 80; server_name localhost; #charset koi8-r; #access_log logs/host.access.log main; location / { root html; index index.html index.htm; } #error_page 404 /404.html; # redirect server error pages to the static page /50x.html # error_page 500 502 503 504 /50x.html; location = /50x.html { root html; } # proxy the PHP scripts to Apache listening on 127.0.0.1:80 # #location ~ \.php$ { # proxy_pass http://127.0.0.1; #} # pass the PHP scripts to FastCGI server listening on 127.0.0.1:9000 # #location ~ \.php$ { # root html; # fastcgi_pass 127.0.0.1:9000; # fastcgi_index index.php; # fastcgi_param SCRIPT_FILENAME /scripts$fastcgi_script_name; # include fastcgi_params; #} # deny access to .htaccess files, if Apache's document root # concurs with nginx's one # #location ~ /\.ht { # deny all; #} } # another virtual host using mix of IP-, name-, and port-based configuration # #server { # listen 8000; # listen somename:8080; # server_name somename alias another.alias; # location / { # root html; # index index.html index.htm; # } #} # HTTPS server # #server { # listen 443 ssl; # server_name localhost; # ssl_certificate cert.pem; # ssl_certificate_key cert.key; # ssl_session_cache shared:SSL:1m; # ssl_session_timeout 5m; # ssl_ciphers HIGH:!aNULL:!MD5; # ssl_prefer_server_ciphers on; # location / { # root html; # index index.html index.htm; # } #} }

性能高原因之一:

使用零拷贝技术(sendfile on);

1、nginx -s reload背后发生了什么?

master加载配置文件,worker进程由master进程启动,master向旧的worker进程发送中止信号。

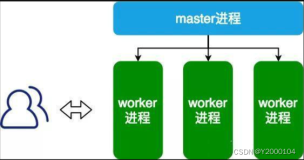

Nginx 服务器,正常运行过程中:

多进程:一个 Master 进程、多个 Worker 进程。

Master 进程:管理 Worker 进程。对外接口:接收外部的操作(信号);对内转发:根据外部的操作的不同,通过信号管理 Worker;监控:监控 Worker 进程的运行状态,Worker 进程异常终止后,自动重启 Worker 进程。

Worker 进程:所有 Worker 进程都是平等的。实际处理:网络请求,由 Worker 进程处理。Worker 进程数量:在 nginx.conf 中配置,一般设置为核心数,充分利用 CPU 资源,同时,避免进程数量过多,避免进程竞争 CPU 资源,增加上下文切换的损耗。

2、请求是连接到 Nginx,Master 进程负责处理和转发? 如何选定哪个 Worker 进程处理请求?请求的处理结果,是否还要经过 Master 进程?

master 建立listen的socket (listenfd),在master上fork worker进程,新请求到来时,所有的worker进程的listenfd都变为可读,worker进程竞争accept_mutex,获得注册的listenfd的读事件,在worker进程的读事件中,接受当前连接,并处理请求。

3、listenfd、master和worker共享一个?accept_mutex在哪里?

4、HTTP 连接建立和请求处理过程

Nginx 启动时,Master 进程,加载配置文件。

Master 进程,初始化监听的 Socket。

Master 进程,Fork 出多个 Worker 进程。

Worker 进程,竞争新的连接,获胜方通过三次握手,建立 Socket 连接,并处理请求。

5、Nginx 为什么拥有高性能并且能够支撑高并发?

Nginx 采用多进程+异步非阻塞方式(IO 多路复用 Epoll)。

请求的完整过程:建立连接→读取请求→解析请求→处理请求→响应请求。

请求的完整过程对应到底层就是:读写 Socket 事件。

6、Nginx 最大连接数

Nginx 是多进程模型,Worker 进程用于处理请求。

单个进程的连接数(文件描述符 fd),有上限(nofile):ulimit -n。

Nginx 上配置单个 Worker 进程的最大连接数:worker_connections 上限为 nofile。

Nginx 上配置 Worker 进程的数量:worker_processes。

因此,Nginx 的最大连接数:

Nginx 的最大连接数:Worker 进程数量 x 单个 Worker 进程的最大连接数。

上面是 Nginx 作为通用服务器时,最大的连接数。

Nginx 作为反向代理服务器时,能够服务的最大连接数:(Worker 进程数量 x 单个 Worker 进程的最大连接数)/ 2。

Nginx 反向代理时,会建立 Client 的连接和后端 Web Server 的连接,占用 2 个连接。

7、IO模型

处理多个请求时,可以采用:IO 多路复用或者阻塞 IO+多线程:

IO 多路复用:一个线程,跟踪多个 Socket 状态,哪个就绪,就读写哪个。

阻塞 IO+多线程:每一个请求,新建一个服务线程。

IO 多路复用和多线程的适用场景?

- IO 多路复用:单个连接的请求处理速度没有优势。

- 大并发量:只使用一个线程,处理大量的并发请求,降低上下文环境切换损耗,也不需要考虑并发问题,相对可以处理更多的请求。

- 消耗更少的系统资源(不需要线程调度开销)。

- 适用于长连接的情况(多线程模式长连接容易造成线程过多,造成频繁调度)。

- 阻塞 IO +多线程:实现简单,可以不依赖系统调用。

- 每个线程,都需要时间和空间。

- 线程数量增长时,线程调度开销指数增长

select,poll,epoll:

- I/O 多路复用的机制。

- I/O 多路复用就通过一种机制,可以监视多个描述符,一旦某个描述符就绪(一般是读就绪或者写就绪),能够通知程序进行相应的读写操作;监视多个文件描述符。

- 但 select,poll,epoll 本质上都是同步 I/O:用户进程负责读写(从内核空间拷贝到用户空间),读写过程中,用户进程是阻塞的;异步 IO,无需用户进程负责读写,异步 IO,会负责从内核空间拷贝到用户空间。

-----------------------------2019年7月13日17:18:19------------------------------------------

今天阅读了《计算机网络自顶向下》第二章的2.2.5. 文中提到web缓存器技术。

通过阅读该文,让我想起了Nginx 派发请求为何这很快,于是翻阅了nginx相关技术文档。

proxy_cache_path /usr/local/nginx/cache levels=1:2 keys_zone=cache_one:500m inactive=1d max_size=30g;

如果能在反向代理的基础上,打开缓存机制,这样可以加快服务的反应速度。

立下flag。2019年年底前将该技术应用到系统中。