按照ModelScope官网VLLM推理加速与部署的问题,依然报错,怎么解决?

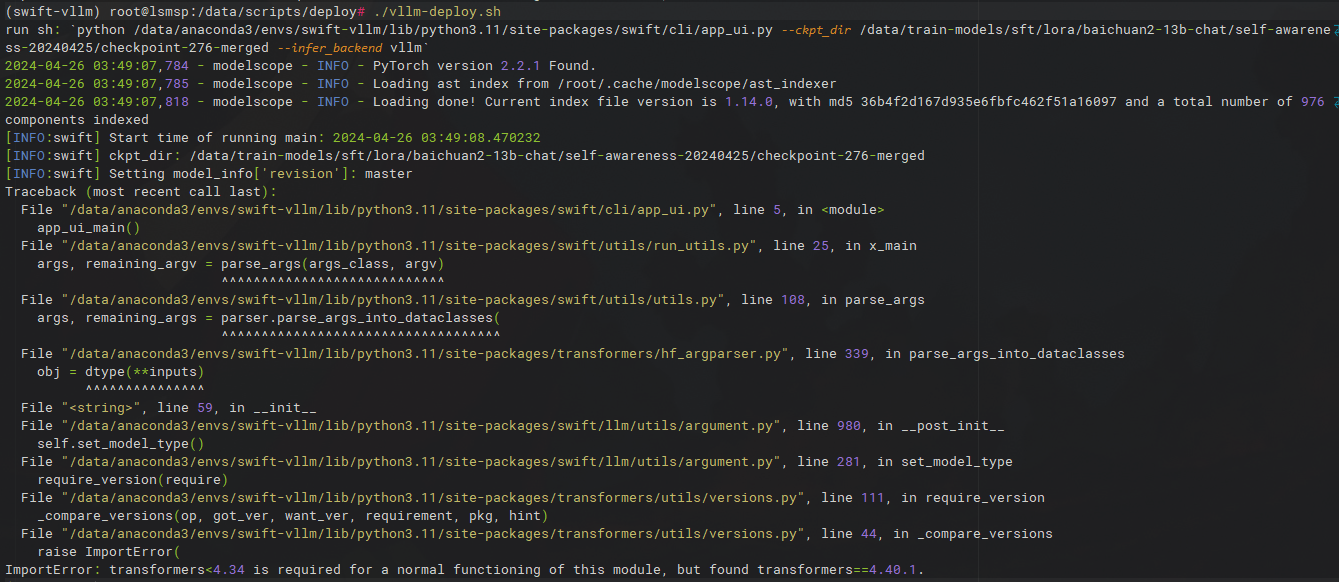

"https://github.com/modelscope/swift/blob/main/docs/source/LLM/VLLM%E6%8E%A8%E7%90%86%E5%8A%A0%E9%80%9F%E4%B8%8E%E9%83%A8%E7%BD%B2.md 按照ModelScope官网VLLM推理加速与部署的问题,依然报错,怎么解决? conda create -n swift-vllm python=3.11pip install 'ms-swift[llm]' -Upip install vllm -Upip install openai -U运行CUDA_VISIBLE_DEVICES=0 swift app-ui --ckpt_dir 'xxx/vx-xxx/checkpoint-xxx-merged' --infer_backend vllm报错如下:

随后执行了pip install transformers==4.33.2还是报错"

-

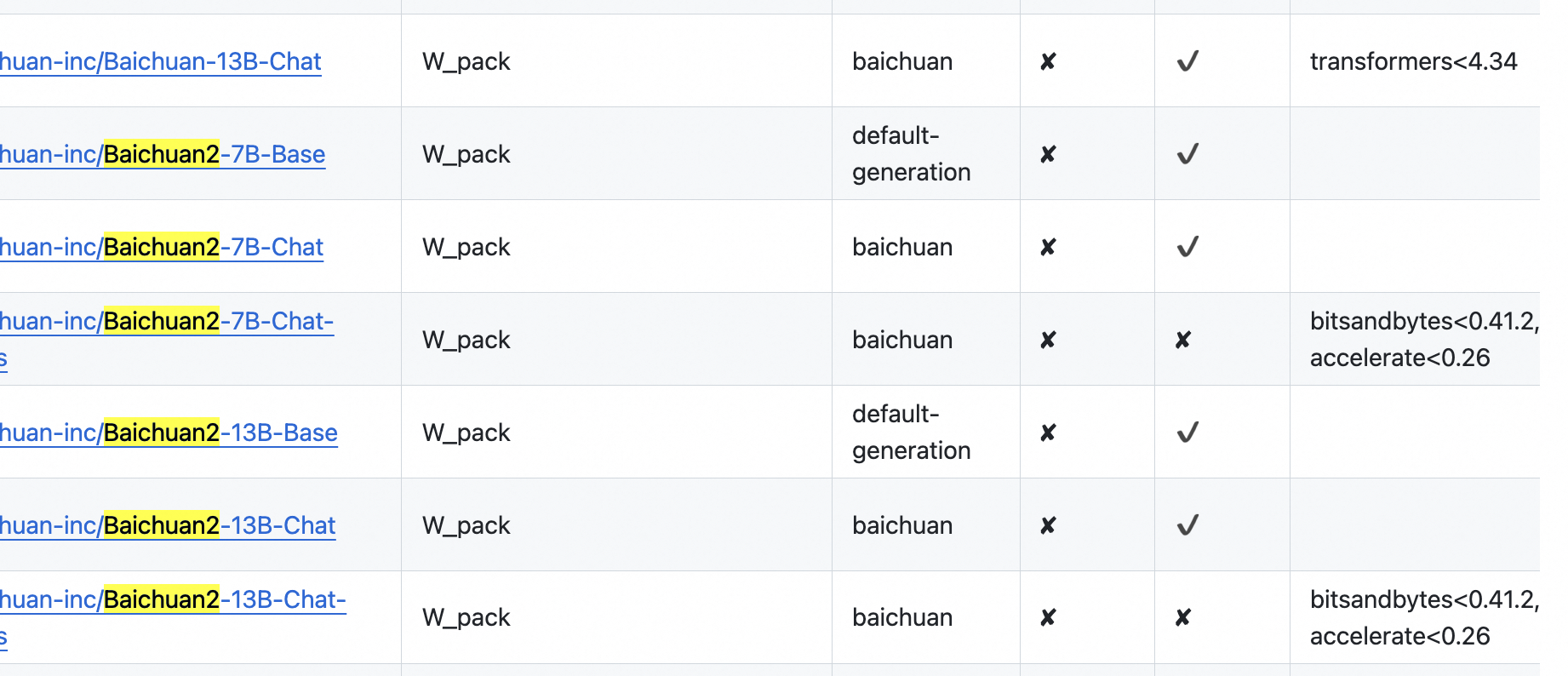

"貌似木有依赖,参考以下图片和链接

https://github.com/modelscope/swift/blob/main/docs/source/LLM/%E6%94%AF%E6%8C%81%E7%9A%84%E6%A8%A1%E5%9E%8B%E5%92%8C%E6%95%B0%E6%8D%AE%E9%9B%86.md 此回答整理自钉群“魔搭ModelScope开发者联盟群 ①”"2024-05-01 16:34:03赞同 1 展开评论 打赏

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉群号:44837352