Flink CDC中Caused by: org.apache.flink.table.api.ValidationException: 'scan.incremental.snapshot.chunk.key-column' must be set when the table doesn't have primary keys. 这个值怎么设置?scan.incremental.snapshot.chunk.key-column

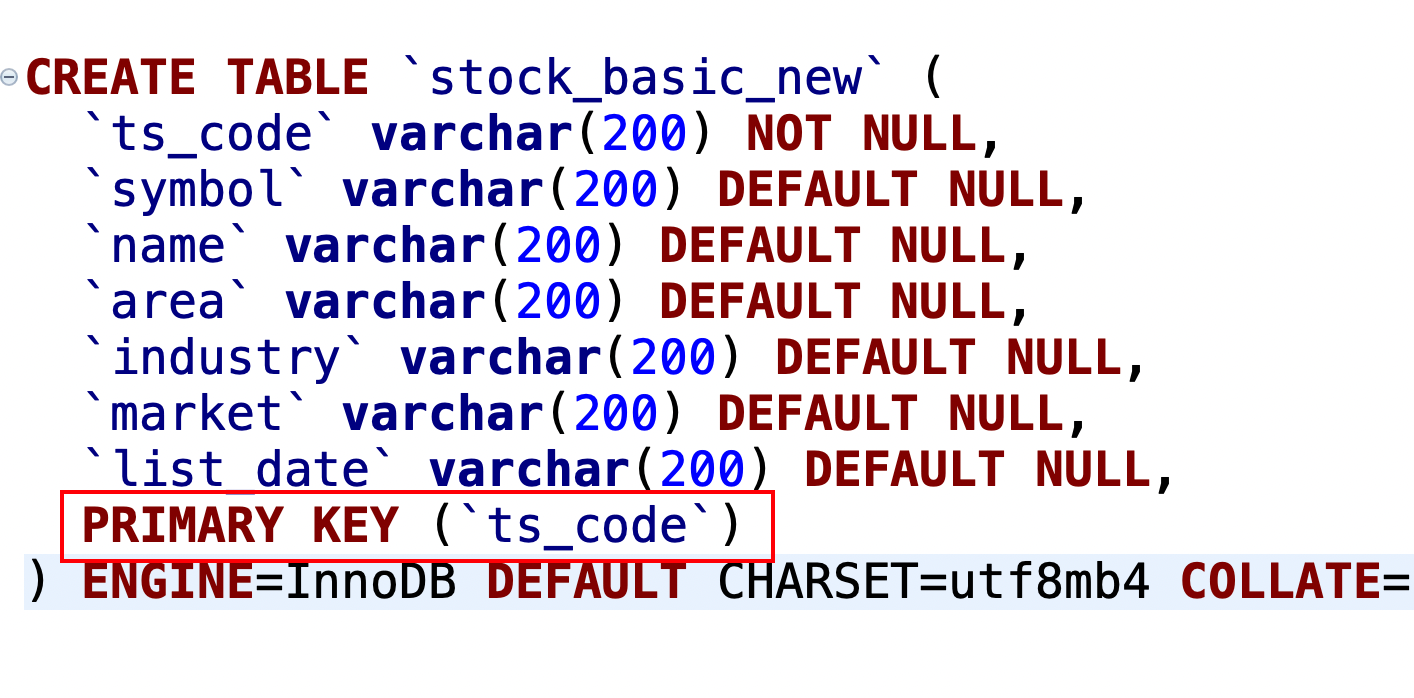

我源表里是有主键的

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在 Flink CDC 中,当你的源表具有主键时,你可以设置 scan.incremental.snapshot.chunk.key-column 属性来指定用于增量快照的键列。

你可以通过在 Flink CDC 的配置文件中或在 Flink 程序中使用 Table API 或 SQL 来设置该属性。具体的设置方式取决于你使用的 Flink 版本和编程模型。

以下是示例代码,展示了如何通过 Flink Table API 来设置 scan.incremental.snapshot.chunk.key-column 属性:

java

Copy

import org.apache.flink.configuration.Configuration;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.table.api.EnvironmentSettings;

import org.apache.flink.table.api.TableEnvironment;

public class FlinkCDCExample {

public static void main(String[] args) throws Exception {

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

EnvironmentSettings settings = EnvironmentSettings.newInstance().useBlinkPlanner().inStreamingMode().build();

TableEnvironment tEnv = TableEnvironment.create(settings);

// 设置 Flink CDC 的配置

Configuration flinkConfig = new Configuration();

flinkConfig.setString("scan.incremental.snapshot.chunk.key-column", "yourPrimaryKeyColumn");

tEnv.getConfig().setConfiguration(flinkConfig);

// 执行 Flink CDC 任务

tEnv.executeSql("CREATE TABLE sourceTable (yourPrimaryKeyColumn INT, otherColumn STRING) WITH (...)");

tEnv.executeSql("CREATE TABLE sinkTable (...) WITH (...)");

tEnv.executeSql("INSERT INTO sinkTable SELECT * FROM sourceTable");

env.execute("Flink CDC Example");

}

}

在上面的代码中,你需要将 yourPrimaryKeyColumn 替换为你源表的实际主键列名称。然后,将其设置为 scan.incremental.snapshot.chunk.key-column 的值,使 Flink CDC 在增量快照中使用该列作为键列。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。