flink cdc,读取datetime类型,全都变成了时间戳,怎么解决?下游是可以解决。但是我想知

问题1:flink cdc,读取datetime类型,全都变成了时间戳,怎么解决?下游是可以解决。但是我想知道flinkcdc本身有没有解决的办法?不是sql,是代码 问题2:我只是开启了mysql的binlog,没有做任何其他设置,要怎么解决?datastream怎么写sql?

-

北京阿里云ACE会长

Flink CDC读取MySQL的datetime类型时会转换为时间戳的问题,可以通过在Flink CDC任务中添加相应的转换器来解决。具体来说,可以在MySQL数据源的debezium.source.converter配置项中指定io.debezium.connector.mysql.converters.TimestampConverter转换器,这样Flink CDC将会将datetime类型转换为ISO-8601格式的字符串,而不是时间戳。示例如下所示:

abnf

Copy

properties.setProperty("debezium.source.connector.class", "io.debezium.connector.mysql.MySqlConnector");

properties.setProperty("debezium.source.offset.storage", "org.apache.kafka.connect.storage.FileOffsetBackingStore");

properties.setProperty("debezium.source.offset.storage.file.filename", "/path/to/offset/file");

properties.setProperty("debezium.source.converter", "io.debezium.connector.mysql.converters.TimestampConverter");

如果您只是开启了MySQL的binlog,而没有做其他的设置,那么您需要安装和配置Debezium插件来实现Flink CDC任务。具体来说,需要在Flink CDC任务的配置文件中指定Debezium插件的相关配置,例如MySQL的连接参数、binlog的位置信息、数据解析器等。同时,需要将Debezium插件的JAR包添加到Flink的CLASSPATH中,以确保Flink能够正确加载插件。需要注意的是,如果您使用的是Flink 1.13或以上版本,可以直接使用Flink的内置Debezium插件来实现CDC任务,无需安装其他插件。

对于如何使用DataStream来写SQL,Flink提供了DataStream API和Table API两种方式来操作数据。其中,DataStream API是基于流处理模式的API,可以直接操作数据流;而Table API是基于关系型数据模型的API,可以将数据流转换为关系型表,并进行类似SQL的操作。具体来说,您可以使用StreamExecutionEnvironment类来创建DataStream,并使用StreamTableEnvironment类来创建Table。示例如下所示:

reasonml

Copy

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

StreamTableEnvironment tableEnv = StreamTableEnvironment.create(env);DataStream> stream = env.fromElements(

Tuple2.of(1, "Alice"),

Tuple2.of(2, "Bob"),

Tuple2.of(3, "Charlie"));Table table = tableEnv.fromDataStream(stream, $("id"), $("name"));

Table result = table.select($("name")).where($("id").isEqual(2));DataStream resultStream = tableEnv.toDataStream(result, Row.class);

resultStream.print();

在上述示例中,首先创建了一个DataStream,并使用StreamTableEnvironment将其转换为Table。然后,对Table进行了一些操作,例如选择name列,并过滤id为2的行。最后,将Tabl2023-07-30 09:36:09赞同 展开评论 打赏 -

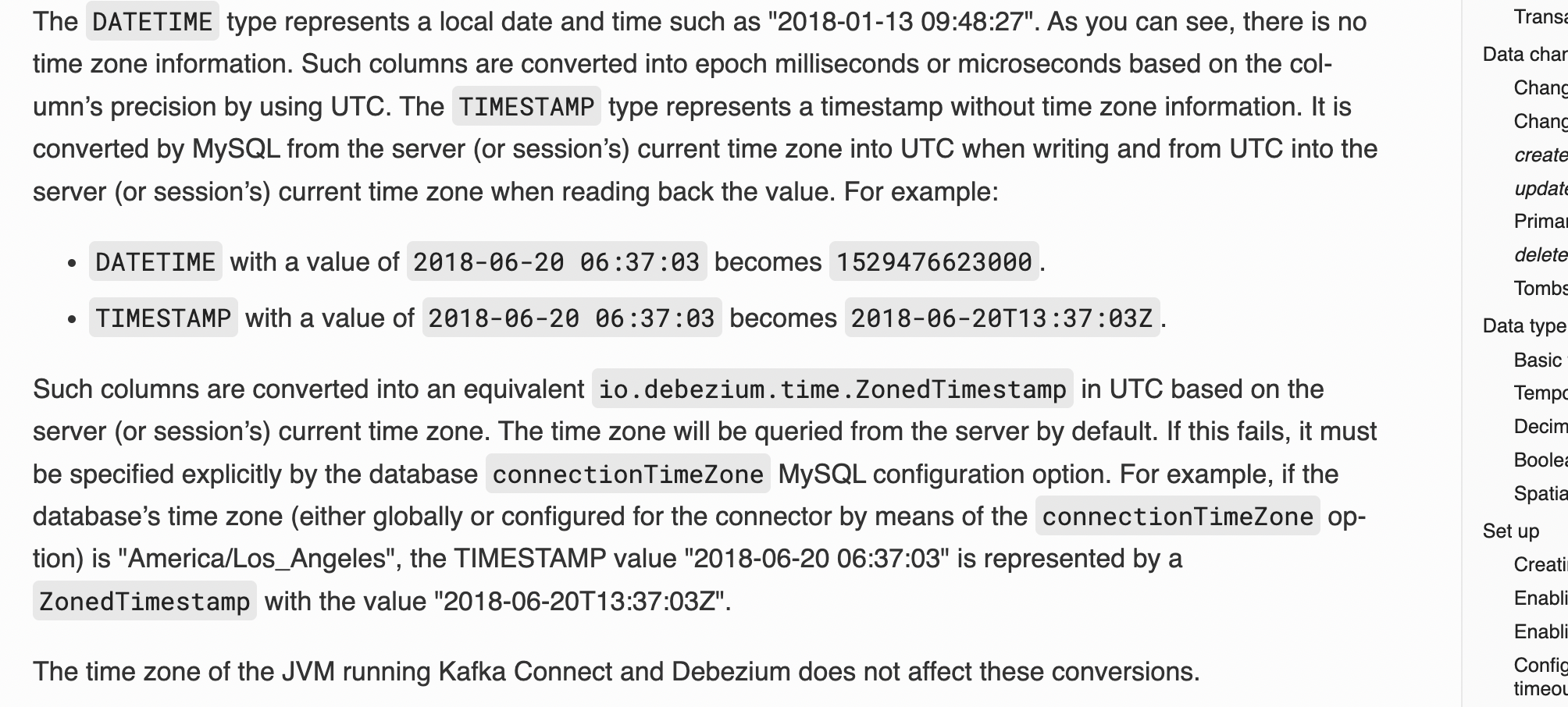

问题1:当 Flink CDC 读取 MySQL 的 datetime 类型时,将其转换为时间戳的问题。如果下游可以解决这个问题,你可以在下游进行类型转换来恢复原始的 datetime 类型。但是如果你想在 Flink CDC 本身解决这个问题,你可以通过以下两种方式来处理:

- 使用 Flink SQL:在 Flink CDC 中使用 Flink SQL 可以更方便地对数据进行类型转换。你可以在表的创建语句中使用 CAST 函数来将时间戳转换回 datetime 类型。例如:

SELECT CAST(timestamp_column AS DATETIME) FROM my_table。- 自定义代码处理:如果你使用 Flink DataStream API 处理 Flink CDC 数据流,你可以编写自定义代码来解析并转换时间戳列。在 DataStream 的 map 或 flatMap 算子中,根据具体情况使用 SimpleDateFormat 或其他日期时间处理库来解析时间戳,并将其转换为 datetime 类型。

问题2:只开启了 MySQL 的 binlog,且没有做其他设置,如何解决?如果你没有进行其他设置,Flink CDC 将默认使用 MySQL Connector/J 来连接 MySQL 数据库,并读取其 binlog。在这种情况下,你可以使用 Flink SQL 或 Flink DataStream API 来处理 Flink CDC 数据流。

- 使用 Flink SQL:你可以通过 Flink SQL 来处理 Flink CDC 数据流。首先,在 Flink SQL 中注册 CDC 数据源,并创建相应的表。然后,你可以使用标准的 SQL 查询语句来对数据进行处理和转换。

- 使用 Flink DataStream API:如果你更喜欢使用 Flink DataStream API,可以通过创建 CDCSourceFunction 并配置相应的参数来创建 Flink CDC 数据源。然后,你可以使用 DataStream 的各种算子(如 map、filter、aggregation 等)来处理 Flink CDC 数据流。

根据你的具体情况和需求,选择适合的方式来处理 Flink CDC 的数据流。

2023-07-30 09:38:55赞同 展开评论 打赏 -

回答1:下游解决不就行了,sql吗 回答2:你可以写sql对应下,sql会对数据类型转换

直接写sql语句,或者用table-pai,api,

直接写sql语句,或者用table-pai,api, ,此回答整理自钉群“Flink CDC 社区”2023-07-02 18:04:55赞同 展开评论 打赏

,此回答整理自钉群“Flink CDC 社区”2023-07-02 18:04:55赞同 展开评论 打赏

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。