问一下各位大佬,在使用flinkcdc 同步 oceanbase(企业版本)数据到kafka时,?

问一下各位大佬,在使用flinkcdc 同步 oceanbase(企业版本)数据到kafka时,logproxy.host 参数怎么获取?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

-

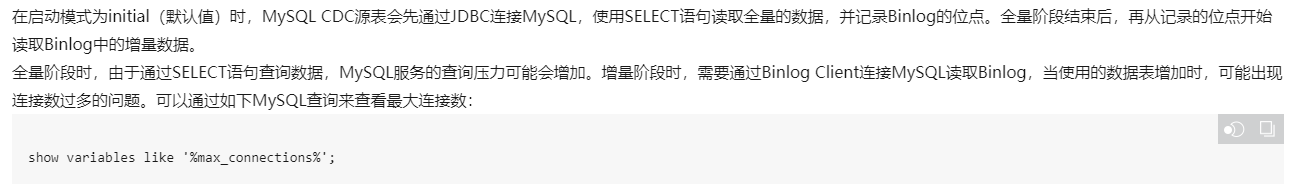

在使用Flink CDC同步OceanBase数据到Kafka时,logproxy.host参数是用于指定OceanBase集群的日志代理(Log Proxy)的主机地址。以下是获取logproxy.host参数的步骤:

首先,确保你具有OceanBase集群的管理员权限或能够访问集群的配置信息。

登录到OceanBase集群中的任意一台机器上。

打开终端或命令行界面,并执行以下命令来获取OceanBase集群的日志代理主机地址:

obclient -h <obproxy_host>:<obproxy_port> -u <username> -p <password> -e "SELECT logproxy_host FROM oceanbase.ob_server_config"其中,

<obproxy_host>和<obproxy_port>是OceanBase集群的OBProxy主机和端口,<username>和<password>是具有足够权限的OceanBase用户名和密码。- 执行上述命令后,你将获得一个结果集,其中包含了OceanBase集群的日志代理主机地址。

将获得的日志代理主机地址填写到Flink CDC的配置文件中的logproxy.host参数中。

上述命令是基于OceanBase的企业版本,如果你使用的是其他版本或定制的OceanBase集群,可能需要参考相应的文档或联系管理员获取日志代理主机地址。2023-09-11 09:46:56赞同 展开评论 -

在使用 FlinkCDC 同步 OceanBase 数据到 Kafka 时,

logproxy.host参数是用来指定 LogProxy 的主机地址的。LogProxy 是作为 FlinkCDC 和 OceanBase 之间的中间件,用于解析和传输 Binlog 数据。要获取 LogProxy 的主机地址,可以参考以下步骤:

- 首先,确保已经安装和部署了 LogProxy。LogProxy 的安装和部署可以参考 OceanBase 官方文档或者相关的部署指南。

- 安装和部署完成后,可以通过以下方式获取 LogProxy 的主机地址:

- 如果已经知道 LogProxy 的主机地址,直接使用该地址即可。

- 如果不知道 LogProxy 的主机地址,可以通过查看 LogProxy 的配置文件或者使用相关的命令行工具来获取。具体的方法可以参考 LogProxy 的官方文档或者相关的使用指南。

要获取 LogProxy 的主机地址,需要先安装和部署 LogProxy,并根据具体情况查看配置文件或者使用相关的命令行工具来获取。

2023-08-23 22:11:52赞同 展开评论 -

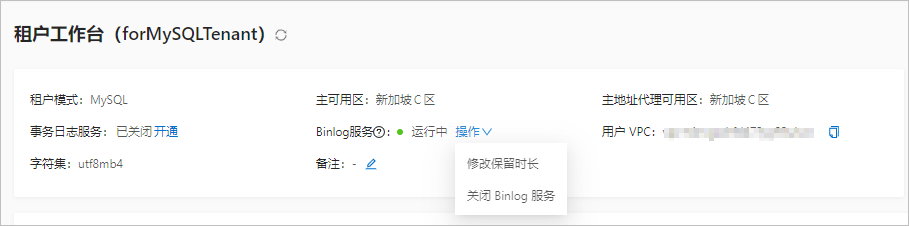

oblogproxy 是 OceanBase 数据库的增量日志代理服务。基于 libobcdc(原名:liboblog),以服务的形式提供实时增量链路接入和管理能力,方便应用接入 OceanBase 增量日志。能够解决在网络隔离的情况下,订阅增量日志的需求,并提供多种链路接入方式。

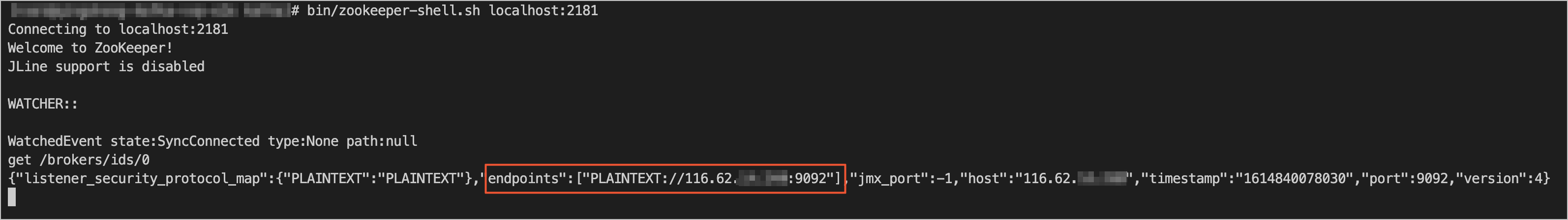

logproxy.host:OceanBase 日志代理服务 的 IP 地址或主机名。

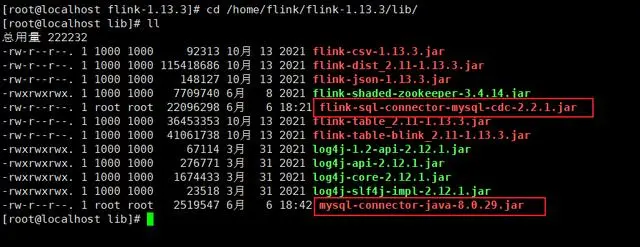

若您使用的是企业版的 OceanBase Oracle 模式,您需要先添加 OceanBase 的官方 JDBC 驱动 jar 包到 Flink 环境,并且部署企业版的 oblogproxy 服务,然后通过以下命令创建 OceanBase CDC 表:

Flink SQL> CREATE TABLE orders ( order_id INT, order_date TIMESTAMP(0), customer_name STRING, price DECIMAL(10, 5), product_id INT, order_status BOOLEAN, PRIMARY KEY (order_id) NOT ENFORCED ) WITH ( 'connector' = 'oceanbase-cdc', 'scan.startup.mode' = 'initial', 'username' = 'user@test_tenant#cluster_name', 'password' = 'pswd', 'tenant-name' = 'test_tenant', 'database-name' = '^test_db$', 'table-name' = '^orders$', 'hostname' = '127.0.0.1', 'port' = '2881', 'compatible-mode' = 'oracle', 'jdbc.driver' = 'com.oceanbase.jdbc.Driver', 'config-url' = 'http://127.0.0.1:8080/services?Action=ObRootServiceInfo&User_ID=xxx&UID=xxx&ObRegion=xxx', 'logproxy.host' = '127.0.0.1', 'logproxy.port' = '2983', 'working-mode' = 'memory' );2023-08-22 16:44:03赞同 展开评论 -

十分耕耘,一定会有一分收获!

楼主你好,在使用阿里云Flink CDC同步OceanBase(企业版本)数据到Kafka时,需要以下两步操作来获取logproxy.host参数:

- 部署LogProxy

首先需要部署OceanBase LogProxy。LogProxy是OceanBase的一个组件,用于将OceanBase的日志输出到外部存储系统,比如Kafka、RocketMQ等,具体部署步骤可以参考OceanBase官方文档或者联系OceanBase技术支持。

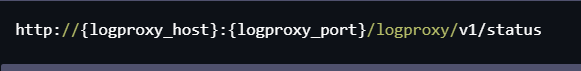

部署完成后,可以通过LogProxy提供的REST API查看LogProxy的运行状态和相关信息。REST API的URL为:

http://{logproxy_host}:{logproxy_port}/logproxy/v1/status

其中,logproxy_host为LogProxy部署的主机IP地址或者域名,logproxy_port为LogProxy监听的端口号,默认为12800。

- 获取logproxy.host参数

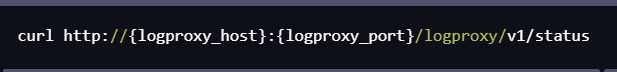

在使用阿里云Flink CDC同步OceanBase数据到Kafka时,需要配置SourceConnector的logproxy.host参数,以指定LogProxy的运行地址和端口号。可以通过以下命令获取LogProxy的运行地址和端口号:

curl http://{logproxy_host}:{logproxy_port}/logproxy/v1/status该命令会返回一个JSON格式的响应,其中包含了LogProxy的运行状态和相关信息,其中包括logproxy_host和logproxy_port参数。

将logproxy_host和logproxy_port参数填入Flink CDC SourceConnector的logproxy.host参数中即可。

注意:在获取LogProxy的运行地址和端口号时,需要保证Flink CDC和LogProxy在同一个网络环境中,否则可能无法获取到正确的地址和端口号。

2023-08-21 10:46:58赞同 展开评论 -

天下风云出我辈,一入江湖岁月催,皇图霸业谈笑中,不胜人生一场醉。

在使用Flink CDC将OceanBase(企业版)的数据同步到Kafka时,您需要提供logproxy.host参数的值。 2. 在"集群配置"页面上,找到并展开"日志代理"部分。 4. 将复制的IP地址或主机名作为logproxy.host参数的值提供给Flink CDC配置。

请注意,具体的操作步骤可能会因OceanBase版本和配置而有所不同。如果您无法找到相应的配置选项,请参考OceanBase的官方文档或联系OceanBase的技术支持团队以获取更详细的信息:https://help.aliyun.com/zh/flink/developer-reference/apache-kafka-connector?spm=a2c4g.11186623.0.i5

2023-08-16 17:07:14赞同 展开评论

2023-08-16 17:07:14赞同 展开评论 -

在使用flinkcdc同步oceanbase(企业版本)数据到kafka时,logproxy.host参数是用于指定Flink CDC调用LogProxy服务的地址,通常需要根据具体的部署情况进行配置。如果您是在本地进行开发和测试,可以将logproxy.host参数设置为本地的IP地址和端口号。如果您是在集群环境中进行部署,可以将logproxy.host参数设置为LogProxy服务的IP地址和端口号。

2023-08-15 18:36:05赞同 展开评论 -

在使用Flink CDC将OceanBase企业版数据同步到Kafka时,需要配置logproxy.host参数。该参数指定了LogProxy的主机名或IP地址,用于从OceanBase捕获增量变更日志。

要获取LogProxy的主机名或IP地址,请按照以下步骤进行操作:- 登录到OceanBase企业版的管理界面。

- 在左侧导航栏中选择“集群管理”,然后选择目标集群。

- 在目标集群的详情页面中,找到“日志服务”模块,并单击“查看”按钮。

- 在日志服务页面中,找到“LogProxy地址”字段,该字段下方的文本框中即为LogProxy的主机名或IP地址。

2023-08-15 11:07:19赞同 展开评论 -

面对过去,不要迷离;面对未来,不必彷徨;活在今天,你只要把自己完全展示给别人看。

在使用 Flink CDC 同步 OceanBase 数据到 Kafka 时,您需要提供 logproxy.host 参数来指定 LogProxy 的主机地址。以下是获取 LogProxy 主机地址的一些常见方法:

查看 OceanBase 配置文件:LogProxy 的主机地址通常在 OceanBase 集群的配置文件中指定。您可以查看集群配置文件(如

ob.cfg或logproxy.properties)中的相关参数,以获取 LogProxy 的主机地址。联系 OceanBase 运维团队:如果您没有直接访问服务器的权限或无法查看配置文件,建议联系 OceanBase 运维团队,向他们询问 LogProxy 的主机地址。他们应该能够为您提供正确的地址和端口信息。

参考文档或官方支持:OceanBase 提供了详细的文档和支持资源,您可以参考官方文档、论坛或社区来获取更多关于 LogProxy 主机地址的信息。这些资源可能包含特定版本的 OceanBase 的使用指南和配置示例。

2023-08-14 19:06:18赞同 展开评论 -

北京阿里云ACE会长

使用Flink CDC从OceanBase同步数据到Kafka时,logproxy.host参数需要获取OceanBase集群的logproxy服务地址。

具体操作如下:

登录OceanBase集群管理控制台。

选择"运维管理"->"日志服务"。

在日志服务页面上,可以看到各个实例的logproxy服务地址端口,如:

logproxy.host=ob-logproxy1.yourdomain:2345

这个logproxy地址就是Flink CDC sink连接OceanBase时需要配置的logproxy.host参数的值。

完整的参数配置为:

Copy

properties.put("debezium.source.mongodb.hosts", "logproxy.host:port");

properties.put("logproxy.host", "ob-logproxy1.yourdomain:2345");

其他OceanBase的连接参数如binlog.namespace、binlog.table等保持默认即可。

所以总结来说,获取logproxy.host的方式是登录OceanBase运维控制台,在日志服务页面查看具体OceanBase集群内各实例的logproxy服务地址。2023-08-14 15:13:05赞同 展开评论 -

全栈JAVA领域创作者

如果您想要使用Flink CDC同步OceanBase(企业版本)数据到Kafka,可以通过以下方式进行:

查看Flink CDC的配置文件:在Flink CDC的配置文件中,可以查看connector参数,以确定Flink CDC支持的数据库类型。例如,如果您的Flink CDC支持连接OceanBase(企业版本)数据库,那么您可以在connector参数中指定OceanBase(企业版本)数据库的连接信息。

查看Flink CDC的启动命令:在Flink CDC的启动命令中,可以查看--add-plugins参数,以确定Flink CDC支持的数据库类型。例如,如果您的Flink CDC支持连接OceanBase(企业版本)数据库,那么您可以在--add-plugins参数中指定OceanBase(企业版本)数据库的插件信息。

需要注意的是,如果您在生产环境中使用Flink CDC同步OceanBase(企业版本)数据库的表,那么您需要确保Flink CDC使用的是稳定版本的OceanBase(企业版本)数据库连接器。同时,您还需要确保Flink CDC的数据备份和恢复机制,以保证数据的安全性和可靠性。2023-08-14 13:50:16赞同 展开评论 -

在使用 Flink CDC (Change Data Capture) 同步 OceanBase 数据到 Kafka 时,logproxy.host 参数是用于指定 Flink CDC 客户端应用程序与 OceanBase 集群中的 LogProxy 服务的连接地址。

要获取 logproxy.host 参数,您需要执行以下步骤:在 OceanBase 集群中启动 LogProxy 服务。LogProxy 服务是一个基于 Kafka 的数据代理服务,可以将 OceanBase 中的数据变化转换为 Kafka 消息。

在 Flink 中配置 Flink CDC,以便它可以连接到 OceanBase 集群中的 LogProxy 服务。

在 Flink 中配置 Kafka 数据源,以便它可以将 Flink CDC 捕获的变化转换为 Kafka 消息。

2023-08-14 10:20:41赞同 展开评论

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。