能力说明:

了解Python语言的基本特性、编程环境的搭建、语法基础、算法基础等,了解Python的基本数据结构,对Python的网络编程与Web开发技术具备初步的知识,了解常用开发框架的基本特性,以及Python爬虫的基础知识。

Apsara Clouder云计算专项技能认证:云服务器ECS入门

Apsara Clouder云计算专项技能认证:云服务器ECS入门

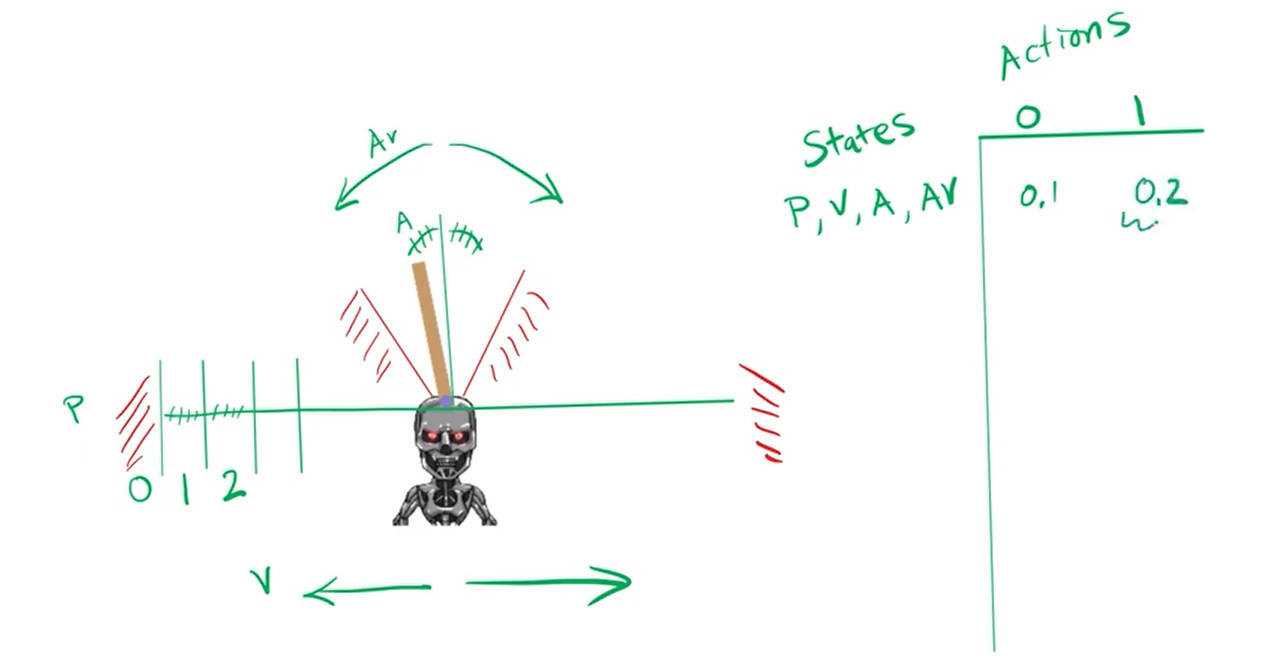

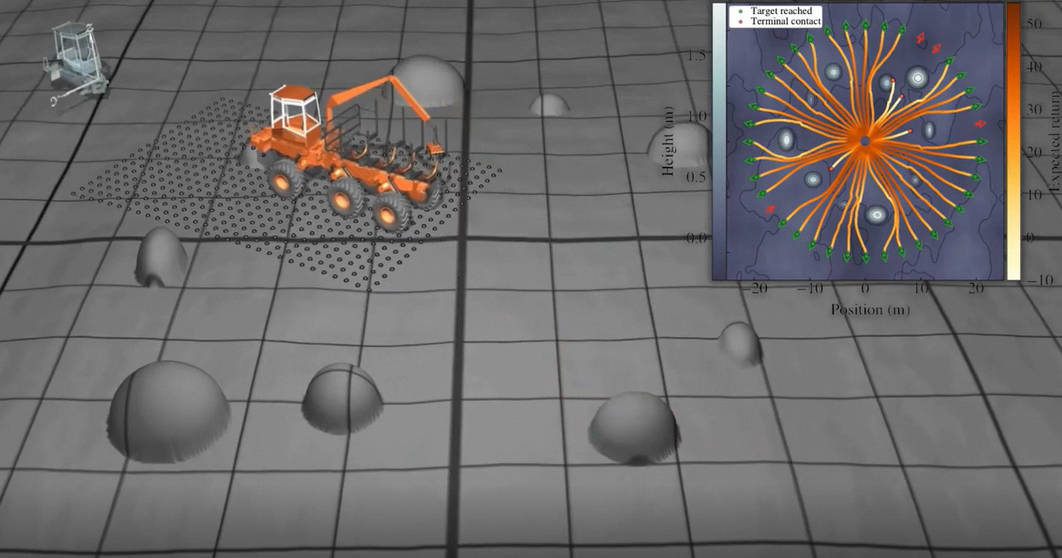

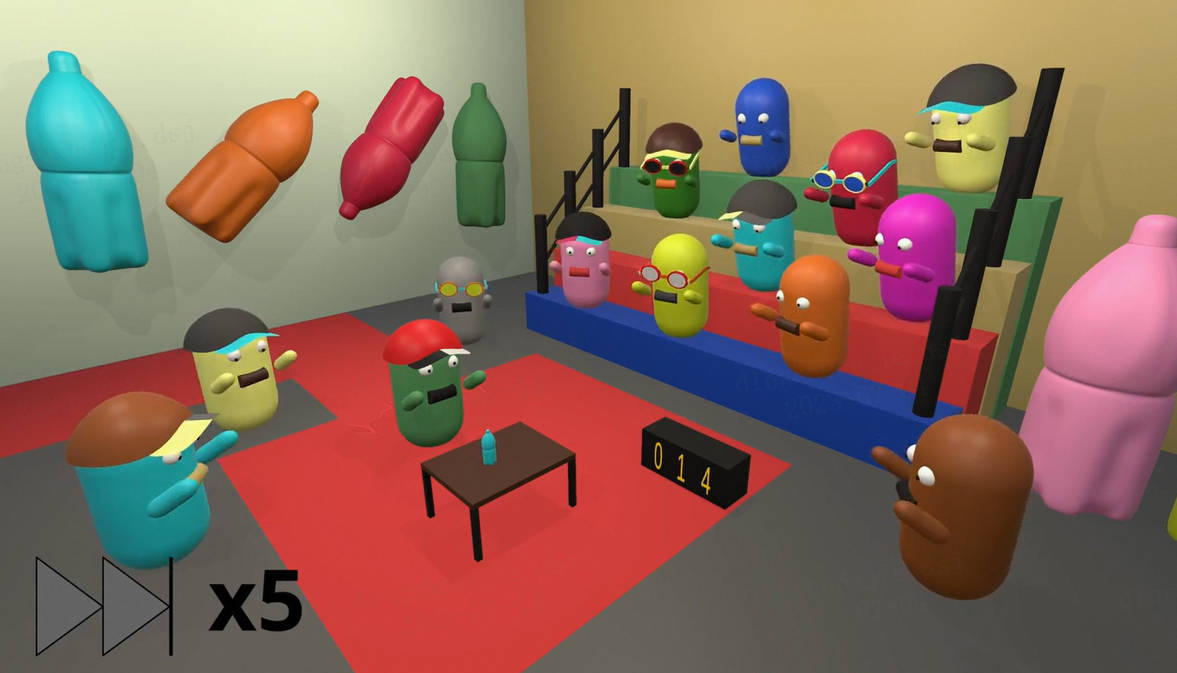

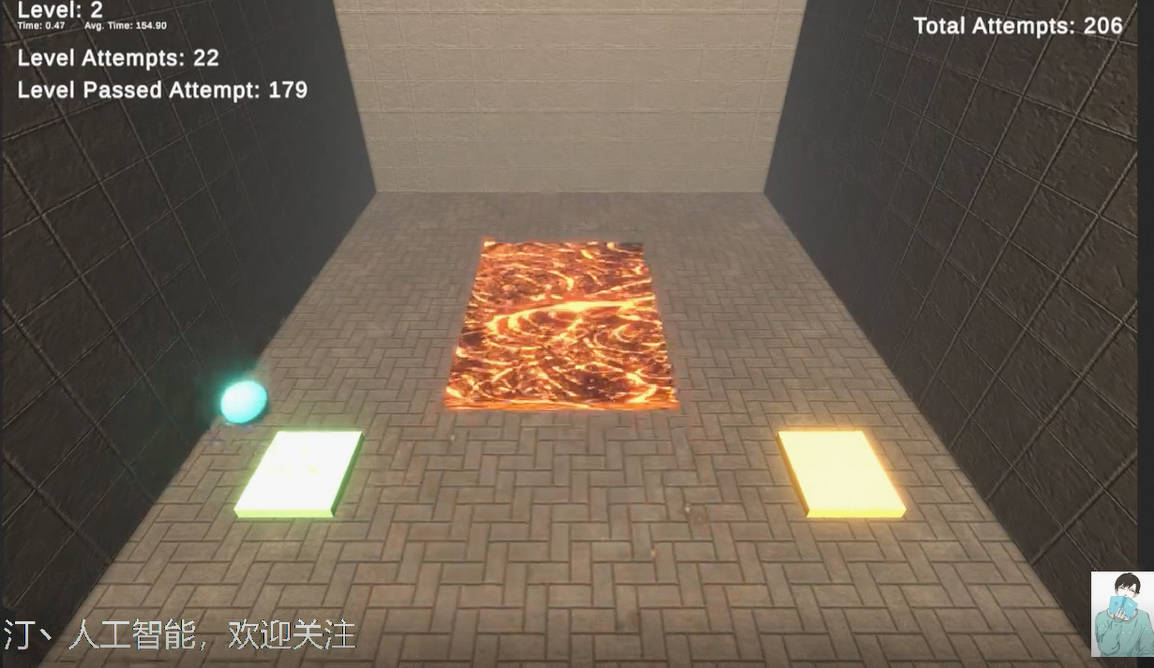

将不定期更新关于机器学习、强化学习、数据挖掘以及NLP等领域相关知识

OCR文字检测与识别系统:融合文字检测、文字识别和方向分类器的综合解决方案

解读未知:文本识别算法的突破与实际应用

突破边界:文本检测算法的革新与应用前景

深入探索OCR技术:前沿算法与工业级部署方案揭秘

“超级AI助手:全新提升!中文NLP训练框架,快速上手,海量训练数据,ChatGLM-v2、中文Bloom、助您实现更智能的应用!”

全套解决方案:基于pytorch、transformers的中文NLP训练框架,支持大模型训练和文本生成,快速上手,海量训练数据!

超越界限:大模型应用领域扩展,探索文本分类、文本匹配、信息抽取和性格测试等多领域应用

解锁ChatGLM-6B的潜力:优化大语言模型训练,突破任务困难与答案解析难题

精进语言模型:探索LLM Training微调与奖励模型技术的新途径

Prompt-“设计提示模板:用更少数据实现预训练模型的卓越表现,助力Few-Shot和Zero-Shot任务”

GPT大语言模型引爆强化学习与语言生成模型的热潮、带你了解RLHF

解锁数据潜力:信息抽取、数据增强与UIE的完美融合

解锁数据潜力:信息抽取、数据增强与UIE的完美融合

NLP文本匹配任务Text Matching [无监督训练]:SimCSE、ESimCSE、DiffCSE 项目实践

NLP文本匹配任务Text Matching [有监督训练]:PointWise(单塔)、DSSM(双塔)、Sentence BERT(双塔)项目实践

开箱即用的对话机器人解决方案,涵盖问答型对话、任务型对话和聊天型对话等多种场景,为您提供全方位的对话交互体验。

一键式文本纠错工具,整合了BERT、MacBERT、ELECTRA、ERNIE等多种模型,让您立即享受纠错的便利和效果

Similarities:精准相似度计算与语义匹配搜索工具包,多维度实现多种算法,覆盖文本、图像等领域,支持文搜、图搜文、图搜图匹配搜索

精细解析中文公司名称:智能分词工具助力地名、品牌名、行业词和后缀提取

书写自动智慧文本分类器的开发与应用:支持多分类、多标签分类、多层级分类和Kmeans聚类

TextBrewer:融合并改进了NLP和CV中的多种知识蒸馏技术、提供便捷快速的知识蒸馏框架、提升模型的推理速度,减少内存占用

MiniRBT中文小型预训练模型:结合了全词掩码(Whole Word Masking)技术和两段式知识蒸馏(Knowledge Distillation)技术,加快推理速度

VLE基于预训练文本和图像编码器的图像-文本多模态理解模型:支持视觉问答、图文匹配、图片分类、常识推理等

ChatGenTitle:使用百万arXiv论文信息在LLaMA模型上进行微调的论文题目生成模型

GPT学术优化 (GPT Academic):支持一键润色、一键中英互译、一键代码解释、chat分析报告生成、PDF论文全文翻译功能、互联网信息聚合+GPT等等

基于Milvus+ERNIE+SimCSE+In-batch Negatives样本策略的学术文献语义检索系统

语义检索系统排序模块:基于ERNIE-Gram的Pair-wise和基于RocketQA的CrossEncoder训练单塔模型

语义检索系统:基于Milvus 搭建召回系统抽取向量进行检索,加速索引

语义检索系统:基于无监督训练SimCSE+In-batch Negatives策略有监督训练的语义索引召回

语义检索系统:基于无监督预训练语义索引召回:SimCSE、Diffcse

中文多模态医学大模型智能分析X光片,实现影像诊断,完成医生问诊多轮对话

ChatPaper全流程加速科研:论文阅读+润色+优缺点分析与改进建议+审稿回复

ChatIE:通过多轮问答问题实现实命名实体识别和关系事件的零样本信息抽取,并在NYT11-HRL等数据集上超过了全监督模型

基于中文金融知识的 LLaMA 系微调模型的智能问答系统:LLaMA大模型训练微调推理等详细教学

中文LLaMA模型和指令精调的Alpaca大模型:中文数据进行二次预训练,进一步提升了中文基础语义理解能力

MedicalGPT:基于LLaMA-13B的中英医疗问答模型(LoRA)、实现包括二次预训练、有监督微调、奖励建模

基于罪名法务智能知识图谱(含码源):基于280万罪名预测、20W法务问答与法律资讯问答功能

电子商务平台市场动向的数据分析平台:阿里商品指数,包括淘宝采购指数,淘宝供应指数,1688供应指数。

基于新浪微博海量用户行为数据、博文数据数据分析:包括综合指数、移动指数、PC指数三个指数

从零构建医疗领域知识图谱的KBQA问答系统:其中7类实体,约3.7万实体,21万实体关系。

中文人物关系知识图谱(含码源):中文人物关系图谱构建、数据回标、基于远程监督人物关系抽取、知识问答等应用.

从零开始搭建医药领域知识图谱实现智能问答与分析服务(含码源):含Neo4j基于垂直网站数据的医药知识图谱构建、医药知识图谱的自动问答等

金融领域:产业链知识图谱包括上市公司、行业和产品共3类实体,构建并形成了一个节点10w+,关系边16w的十万级别产业链图谱

文心千帆:PPT 制作、数字人主播等应用场景惊艳到我了,下面给ERNIE-Bot|BLOOMZ大模型调优、RLHF训练详细教程

文心千帆:PPT 制作、数字人主播一键开播等应用场景惊艳到我了,下面给到Prompt工程详细教程应用场景及案例

文心千帆:PPT 制作、数字人主播一键开播等数十种应用场景惊艳到我了,下面给出简介和使用指南,快去使用起来吧

基于50W携程出行攻略构建事件图谱(含码源):交通工具子图谱、订酒店吃饭事件图谱等

大语言模型的预训练[6]:思维链(Chain-of-thought,CoT)定义原理详解以及在LLM上应用

大语言模型的预训练[5]:语境学习、上下文学习In-Context Learning:精调LLM、Prompt设计和打分函数(Scoring Function)设计以及ICL底层机制等原理详解

大语言模型的预训练[4]:指示学习Instruction Learning详解以及和Prompt工程、ICL区别

发表了文章

2025-12-11

发表了文章

2025-12-11

发表了文章

2025-11-19

发表了文章

2025-11-19

发表了文章

2025-11-07

发表了文章

2025-11-07

发表了文章

2025-10-22

发表了文章

2025-10-22

发表了文章

2025-09-26

发表了文章

2025-09-26

发表了文章

2025-09-23

发表了文章

2025-09-23

发表了文章

2025-09-18

发表了文章

2025-09-18

发表了文章

2025-09-17

发表了文章

2025-09-17

发表了文章

2025-09-08

发表了文章

2025-09-08

发表了文章

2025-09-02

发表了文章

2025-09-02

发表了文章

2025-08-28

发表了文章

2025-08-28

发表了文章

2025-08-22

发表了文章

2025-08-22

发表了文章

2025-08-07

发表了文章

2025-08-07

发表了文章

2025-08-06

发表了文章

2025-08-06

发表了文章

2025-07-25

发表了文章

2025-07-25

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

发表了文章

2025-07-20

回答了问题

2023-03-03

回答了问题

2023-03-03

回答了问题

2023-03-03

回答了问题

2023-03-03

回答了问题

2023-03-03

回答了问题

2023-03-03

回答了问题

2023-02-28

回答了问题

2023-02-28

回答了问题

2023-02-28

回答了问题

2023-02-28

回答了问题

2023-02-28

回答了问题

2023-02-28

回答了问题

2023-02-28

回答了问题

2023-02-28

回答了问题

2023-02-16

回答了问题

2023-02-16