DeepRec在分布式训练方面有哪些优化?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

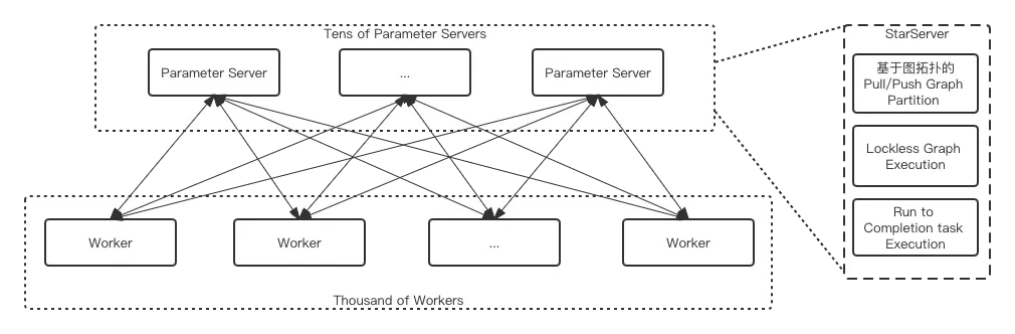

DeepRec对分布式策略进行了深度优化,包括异步训练、同步训练、半同步训练等。特别地,GPU同步训练支持HybridBackend以及NVIDIA HugeCTR-SOK。此外,StarServer作为异步训练框架,通过图、线程调度、执行引擎以及内存等优化,显著提高了并发执行子图的效率,支持3000worker规模的线性分布式扩展。