使用流水并行训练Bert Large模型时,如何解决batch size小导致的收敛问题?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

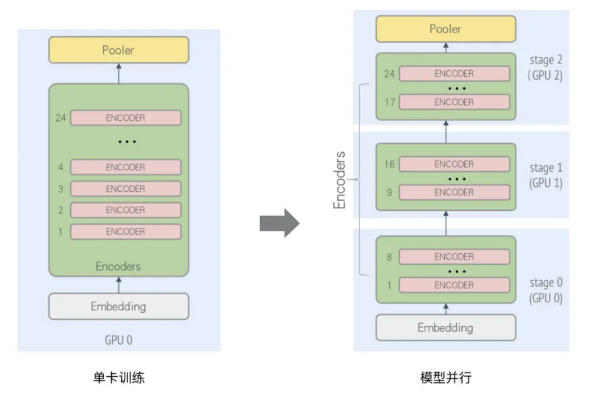

虽然流水并行可以加速Bert Large模型的训练,但batch size小仍然可能导致收敛波动大和效果差的问题。为了解决这个问题,可以考虑在保持流水并行的基础上,通过增加总GPU数量或采用其他优化技术(如混合精度、编译优化等)来进一步提高训练效率和稳定性。此外,也可以考虑调整训练超参数或使用更先进的优化算法来改善收敛效果。