什么是掩码语言建模(MLM)?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

掩码语言建模 (MLM) 是一种在自然语言处理 (NLP) 任务中广泛使用的深度学习技术,特别是在 Transformer 模型(如 BERT 、 GPT-2 和 RoBERTa)的训练中。

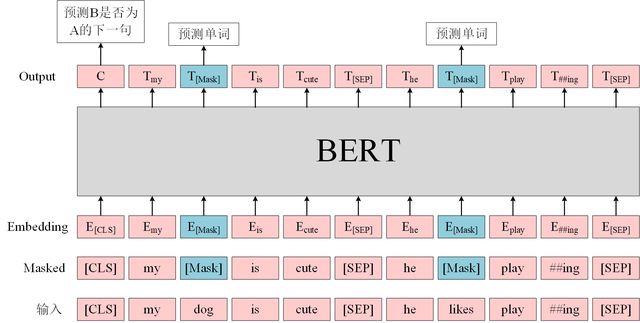

在 MLM 中,输入文本的一部分被 “屏蔽” 或随机替换为特殊标记(通常为 [MASK]),并且模型经过训练以根据其周围的上下文来预测原始标记。其背后的想法是训练模型来理解单词的上下文以及它们与句子中其他单词的关系。

MLM 是一种自监督学习技术,这意味着模型无需显式注释或标签即可学习生成文本,而是使用输入文本本身作为监督。这使其成为适用于各种 NLP 任务的多功能且强大的工具,包括文本分类、问答和文本生成。

——参考链接。