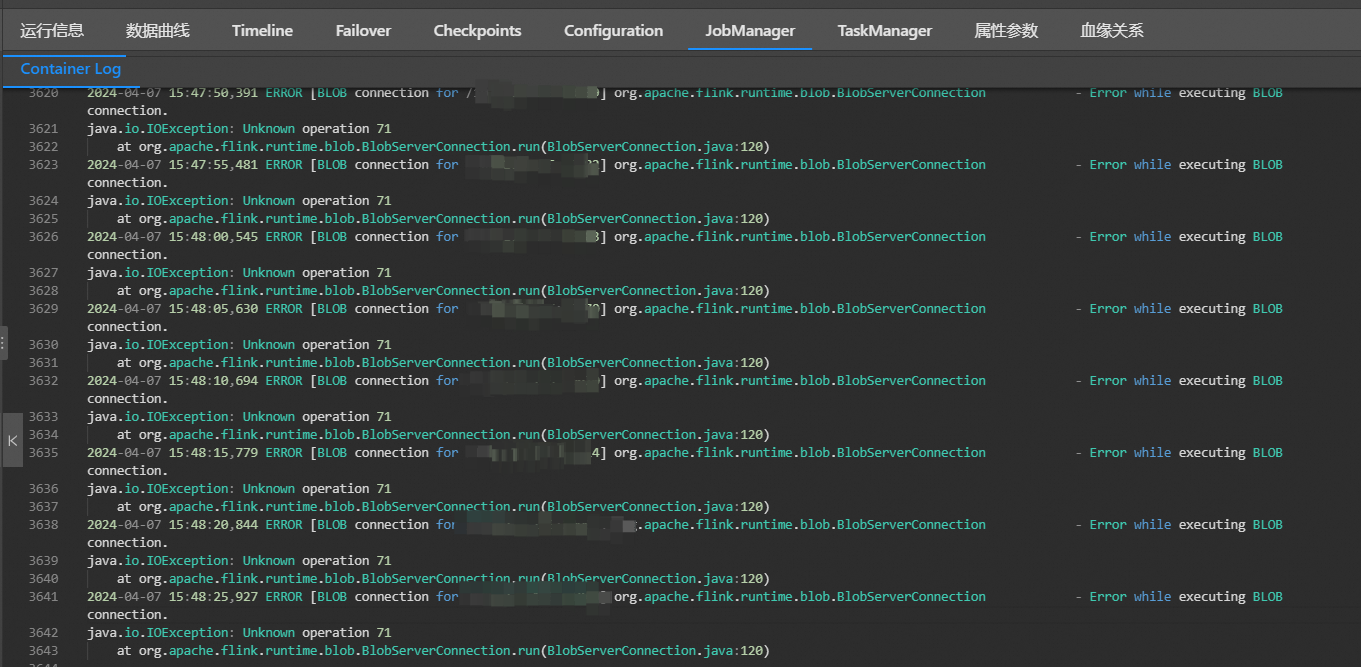

Flink刷了很多条这个报错怎么回事?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

根据您提供的报错信息“Flink刷了很多条这个报错”,虽然具体的报错内容未明确,但结合知识库中的常见问题和解决方案,以下是可能的原因及解决方法:

如果报错与网络相关(例如connect timed out或timeout expired while fetching topic metadata),可能是由于Flink作业与上下游服务之间的网络不通导致的。

connect.timeout参数的值(默认为30秒)。如果报错信息包含JobManager heartbeat timeout,可能是由于自建DNS的连接延迟较大导致的。

jobmanager.retrieve-taskmanager-hostname: false

该配置不会影响作业通过域名连接外部服务的能力。

如果报错信息包含timeout expired while fetching topic metadata,即使Flink与Kafka之间的网络是连通的,也可能是因为Kafka Broker返回的Endpoint无法被Flink正确解析。

zkCli.sh或zookeeper-shell.sh工具登录Kafka使用的Zookeeper。ls /brokers/ids

get /brokers/ids/{your_broker_id}

如果报错与依赖冲突相关(例如NoSuchMethodError或ClassCastException),可能是由于作业JAR包中引入了不必要的依赖或版本不兼容。

pom.xml文件,确认是否存在不必要的依赖(如基本配置、Flink、Hadoop和log4j依赖)。jar tf foo.jar

mvn dependency:tree

exclusions排除不必要的依赖,或将log4j相关的类进行relocation。<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-java_2.11</artifactId>

<version>${flink.version}</version>

<scope>provided</scope>

</dependency>

如果报错与资源分配相关(例如RESOURCE_EXHAUSTED或NoResourceAvailableException),可能是由于作业逻辑过于复杂或资源配置不足。

table.exec.operator-name.max-length: 1000

cacheSize和cacheTTLMs参数设置合理,避免占用过多内存。如果报错信息不够详细,建议开启Debug日志以获取更多信息。

DEBUG。InvocationTargetException等异常,定位具体问题。根据上述分析,您可以按照以下步骤逐步排查问题: 1. 确认网络连通性,调整超时参数。 2. 检查是否需要关闭TaskManager的域名解析。 3. 验证Kafka Broker的Metadata是否正确解析。 4. 排查依赖冲突并优化JAR包配置。 5. 调整资源配额,优化作业逻辑。 6. 开启Debug日志以获取更详细的错误信息。

如果问题仍未解决,请提供具体的报错信息以便进一步分析。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。