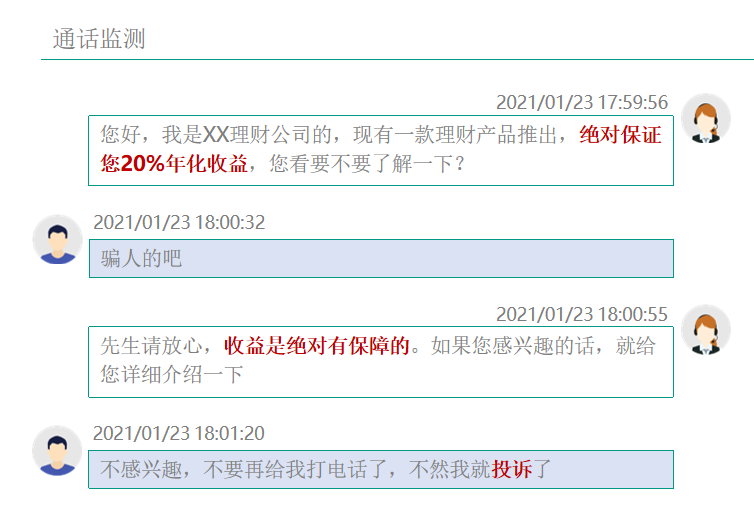

modelscope-funasr通话过程中实时语音转文字,区分客服和用户,这个如何实现呢?就类似于这种

要实现ModelScope-FunASR通话过程中实时语音转文字,并区分客服和用户,可以按照以下步骤进行:

首先,确保您已经正确安装了ModelScope-FunASR所需的依赖库和工具。您可以在ModelScope-FunASR的GitHub仓库中查看安装说明。

在您的应用程序中,使用适当的音频输入设备(如麦克风)捕获通话过程中的实时语音数据。

将实时语音数据传递给ModelScope-FunASR进行语音识别。您可以使用ModelScope-FunASR提供的API或SDK来实现这一点。例如,如果您使用的是Python,可以使用funasr库中的recognize函数进行语音识别。

对于区分客服和用户的需求,您可以在应用程序中添加一个标识符来表示当前发言者的身份。例如,您可以为客服和用户分别分配不同的标识符,如"客服"和"用户"。

在将实时语音数据传递给ModelScope-FunASR之前,将标识符添加到语音数据中。这样,在进行语音识别时,ModelScope-FunASR可以识别出当前发言者的身份。

根据识别结果和发言人身份,您可以在应用程序中执行相应的操作。例如,如果识别结果显示当前发言者是客服,您可以将识别到的文字内容显示在客服界面上;如果识别结果显示当前发言者是用户,您可以将识别到的文字内容显示在用户界面上。

通过以上步骤,您可以实现ModelScope-FunASR通话过程中实时语音转文字,并区分客服和用户。请注意,具体的实现方式可能因您的应用程序需求和技术栈而有所不同。

在通话过程中实时语音转文字,并区分客服和用户,可以通过以下步骤实现:

语音识别:首先,你需要使用语音识别技术将语音转换为文字。这可以通过使用像modelscope-funasr这样的语音识别模型来实现。这些模型可以将实时语音输入转换为文本,从而实现实时的语音转文字功能。

语音分离:为了区分客服和用户,你需要使用语音分离技术来识别不同的说话者。这可以通过使用说话者识别模型来实现。这些模型可以根据声音特征和其他因素来识别谁在说话。

文本处理:一旦你有了识别出的说话者和对应的文本,你就可以对文本进行处理,以区分客服和用户。这可以通过分析文本的内容和风格来实现。例如,你可以使用自然语言处理(NLP)技术来识别文本中的关键词和短语,从而判断谁在说话。

显示结果:最后,你可以将识别出的客服和用户的文本显示在屏幕上,以便用户查看。这可以通过使用图形用户界面(GUI)来实现。

要实现这个功能,你需要使用多种技术和工具,包括语音识别模型、说话者识别模型、自然语言处理工具和图形用户界面。这些技术和工具可以结合起来,实现通话过程中实时语音转文字,并区分客服和用户的功能。

实时语音转文字可以用实时转写包,区别客服和用户可以从音频采集端想办法。建议和通话系统对接一下,看看能不能把客服和用户的语音分离开分别转写。此回答整理自钉群“modelscope-funasr社区交流”

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352