modelscope-funasr这个funasr_-css-client-2pass.cpp的项目支持实时语音吗,比如我边说话,他边显示文字

是的,FunASR支持实时语音识别。在FunASR中,实时语音识别是通过2pass模式实现的。

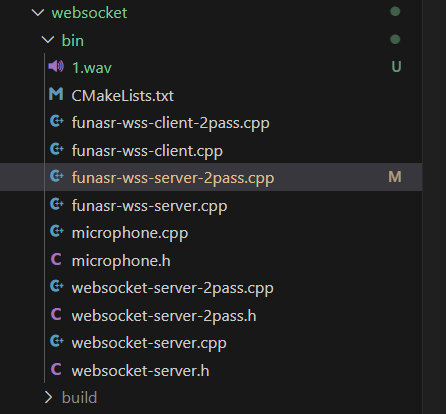

在2pass模式下,FunASR会先进行一次非实时的解码,得到一个初步的识别结果。然后,这个初步的识别结果会被用来指导第二次的实时解码,从而提高实时解码的准确性。

你可以在命令行中使用以下指令来启动FunASR的2pass模式:

cd FunASR/runtime; nohup bash run_server_2pass.sh --download-model-dir /workspace/models --vad-dir damo/speech_fsmn_vad_zh-cn-16k-common-onnx --model-dir damo/speech_paraformer-large_asr_nat-zh-cn-16k-common-vocab8404-onnx --online-model-dir ...

在这个命令中,--download-model-dir参数指定了模型下载的路径,--vad-dir和--model-dir分别指定了VAD和ASR模型的路径。注意,这些路径需要根据你的实际情况进行修改。

是的,FunASR项目支持实时语音识别。在FunASR的Demo页面中,你可以选择“麦克风”作为录音模式,这样你就可以实时地说话,FunASR就会实时地将你的语音转换为文字显示出来。

然而,需要注意的是,实时语音识别的准确性可能会受到网络延迟、设备性能等因素的影响。此外,如果你的语音中包含大量的生僻词或者口音,这也会影响到识别的准确性。

如果你在使用过程中遇到任何问题,你可以参考FunASR的官方文档或者联系他们的技术支持。

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352