DataWorks是这个时间戳超出范围了吗?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

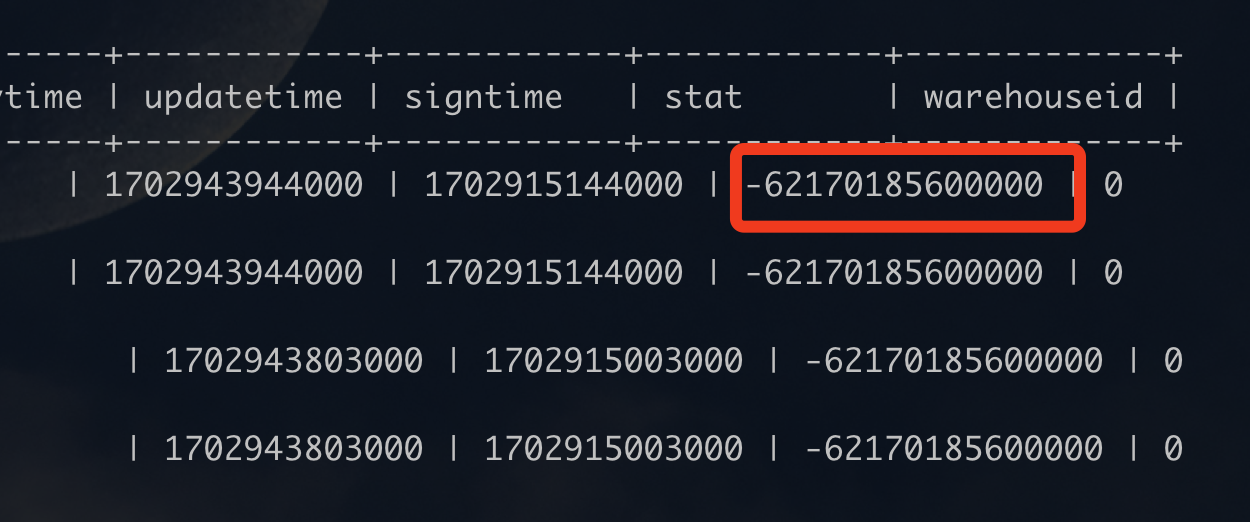

根据您提供的问题“DataWorks是这个时间戳超出范围了吗?”,结合知识库中的相关资料,以下是详细解答:

在使用DataWorks进行数据同步任务时,可能会遇到时间戳超出预期范围的情况。例如,在Kafka数据源中配置了endDateTime来指定同步数据的截止时间,但实际同步到目标数据源的数据中可能包含超出该时间范围的记录。

根据知识库中的描述,这种情况的发生主要与以下机制有关: - Kafka Reader的批量读取行为:Kafka Reader以批量(batch)形式读取数据。当一批数据中包含超过endDateTime的时间戳时,同步任务会停止读取,但该批次中超出时间范围的数据仍会被写入目标数据源。 - 未启用skipExceedRecord配置项:默认情况下,skipExceedRecord配置项为false,即允许超出时间范围的数据被同步。如果需要严格限制时间范围,可以通过设置skipExceedRecord为true来跳过这些数据。

针对时间戳超出范围的问题,您可以采取以下措施:

skipExceedRecord配置项skipExceedRecord设置为true,以确保超出endDateTime的数据不会被同步。{

"stepType": "kafka",

"parameter": {

"endDateTime": "20190416000006",

"skipExceedRecord": "true"

}

}

max.poll.records参数,控制每次拉取的数据量,从而减少超出时间范围的数据量。超出的数据量 < max.poll.records * 并发数

{

"setting": {

"speed": {

"concurrent": 1,

"mbps": "12"

}

},

"parameter": {

"kafkaConfig": {

"max.poll.records": "100"

}

}

}

时间戳超出范围的问题通常由Kafka Reader的批量读取机制引起。通过启用skipExceedRecord配置项、调整批量拉取数据量或优化同步结束策略,可以有效解决该问题。同时,请务必检查调度时区和夏令时配置,以确保时间戳范围符合预期。

如果您仍有疑问或需要进一步的帮助,请提供更多上下文信息,我们将为您深入分析并提供解决方案。

DataWorks基于MaxCompute/Hologres/EMR/CDP等大数据引擎,为数据仓库/数据湖/湖仓一体等解决方案提供统一的全链路大数据开发治理平台。