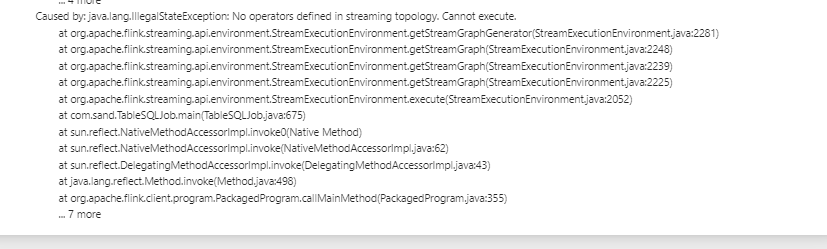

Flink CDC谁遇到过这个 好像跟日志有关系 我在本地浮现 就是跟日志有关系?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

根据您提供的问题描述,Flink CDC 的问题可能与日志相关。以下是基于知识库资料的详细分析和解决方案:

Flink CDC 是通过监听数据库的日志(如 MySQL 的 binlog 或 PostgreSQL 的 WAL)来捕获数据变更的。如果在本地运行时出现问题,通常可能涉及以下几种情况: - 数据库日志保留时间不足,导致 Flink CDC 无法读取所需的日志。 - 日志解析过程中出现异常,例如反序列化失败。 - 配置不当或资源不足,导致日志处理中断。

问题描述: 如果作业正在读取的 Binlog 文件在 MySQL 服务器上已经被清理掉,会出现类似以下报错:

The connector is trying to read binlog starting at GTIDs ..., but this is no longer available on the server

解决方案: - 调整 MySQL 的 Binlog 保留时间

将 expire_logs_days 参数设置为更大的值(如 7 天),以确保日志不会被过早清理。具体命令如下:

show variables like 'expire_logs_days';

set global expire_logs_days=7;

注意: 如果使用的是阿里云 RDS MySQL,还需要检查其日志保留策略,避免因存储空间限制导致日志被清理。

问题描述: 在解析日志时可能出现反序列化错误,例如:

EventDataDeserializationException: Failed to deserialize data of EventHeaderV4

解决方案: - 检查网络连接稳定性

确保 Flink CDC 连接器与数据库之间的网络连接稳定,避免因网络中断导致日志解析失败。 - 升级 Debezium 版本

如果使用的是较旧版本的 Debezium 连接器,建议升级到最新版本,以修复已知的反序列化问题。

问题描述: 如果下游算子(如聚合或 Sink)出现反压,可能导致 Source 无法正常消费日志。

解决方案: - 优化作业资源配置

增加 TaskManager 的内存或 CPU 资源,缓解反压问题。 - 调整并行度

根据数据量调整 Source 和 Sink 的并行度,确保数据流畅通。

为了进一步定位问题,可以通过以下步骤查看 Flink 的启动日志和运行日志:

wal_level 参数设置为 logical,并且订阅表的 REPLICA IDENTITY 设置为 FULL,以保障数据同步的一致性。根据您的描述,问题可能与数据库日志保留时间、日志解析异常或资源配置有关。建议按照上述步骤逐一排查,并结合日志信息定位具体原因。如果问题仍未解决,请提供更详细的错误日志以便进一步分析。

希望以上内容对您有所帮助!

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。