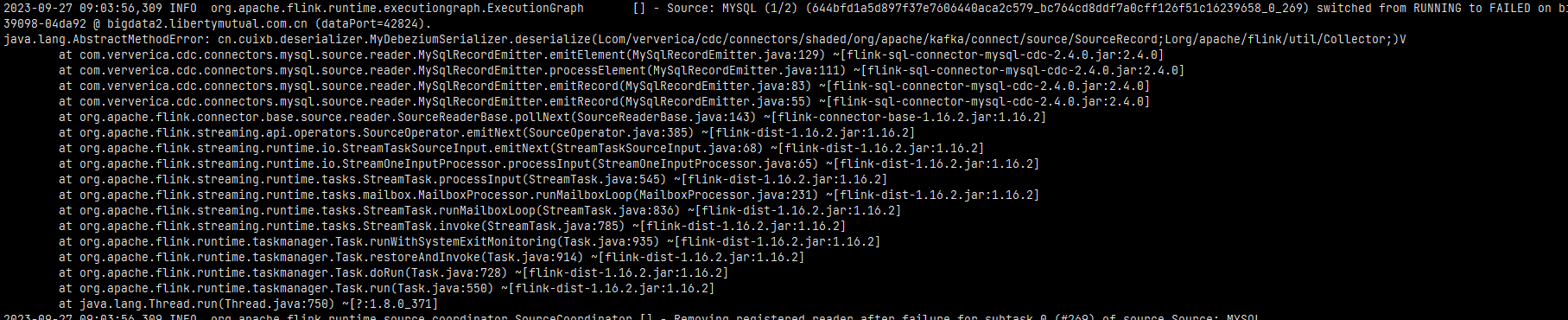

Flink CDC有没有遇到过这个报错?突然就这样了?本地运行不报错,放到环境下就报这个

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

根据您提供的报错描述,虽然具体的错误信息未完全展示,但结合知识库中的内容,可以推测可能的原因和解决方案如下:

Flink CDC在本地运行正常,但在部署环境中报错,最常见的原因是网络连通性问题。Flink默认仅支持访问相同VPC下的服务,如果源端或目标端与Flink工作空间不在同一VPC下,可能会导致网络不通。

确认上下游服务与Flink工作空间的网络是否连通:

connect timed out,请确认访问的服务是否为公网或其他VPC。如果是跨VPC访问,请参考如何配置跨VPC访问。检查白名单配置:

调整连接超时参数:

connect.timeout的值(默认为30秒),例如设置为60秒。如果您的Flink CDC作业依赖于MySQL Binlog或MongoDB Change Stream,以下问题可能导致报错:

Binlog文件被清理:

show variables like 'expire_logs_days';

set global expire_logs_days=7;

RDS MySQL日志保留策略:

oplog.rs中不存在,可能会导致报错。oplog.rs的集合大小,避免其保留时间过短。具体操作可参考MongoDB官方文档。如果报错涉及用户名或密码错误,可能是由于用户凭证未正确配置。例如,MongoDB CDC需要在WITH参数中指定authSource,以确保使用正确的数据库进行身份验证。

'connection.options' = 'authSource=用户所在的DB'

如果Flink作业在环境中运行时出现资源不足的情况,也可能导致报错。例如,Task Manager的CPU使用率过高可能导致finish split response timeout异常。

Has not enough ip address,需要新建可用IP。如果在Flink CDC全量阶段发生了表结构变更,可能会导致作业报错或无法同步表结构变更。

如果Flink CDC消费的数据中存在重复事件(例如Canal或Debezium在故障时投递了重复的变更事件),可能会导致作业运行异常。

table.exec.source.cdc-events-duplicate=true。根据上述分析,建议您按照以下步骤排查问题: 1. 检查网络连通性,确保上下游服务与Flink工作空间在同一VPC下。 2. 确认Binlog或Change Stream的配置是否正确,避免日志被清理或Resume Token失效。 3. 检查用户权限配置,确保authSource参数正确。 4. 增加Task Manager的资源,避免因资源不足导致的异常。 5. 如果涉及表结构变更,停止作业并重新无状态启动。

如果问题仍未解决,请提供更详细的报错信息,以便进一步分析。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。