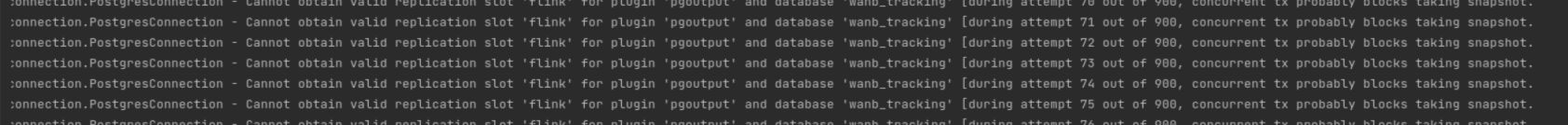

Flink CDC这种报错是因为啥啊?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

Flink CDC 报错的原因可能有多种,具体需要结合报错信息和场景来分析。以下是根据知识库资料总结的常见报错原因及解决方案:

报错原因

在全量阶段发生表结构变更(如新增列、修改列类型等),可能导致作业报错或无法同步表结构变更。

解决方案

报错详情

The primary key is necessary when enable 'Key: 'scan.incremental.snapshot.enabled'

报错原因

MySQL CDC 源表未设置主键(Primary Key)信息,而启用了增量快照功能(scan.incremental.snapshot.enabled=true)。

解决方案

在 DDL 中为表添加主键(PK)信息。

报错详情

The connector is trying to read binlog starting at GTIDs ..., but this is no longer available on the server

报错原因

主服务器已清理包含所需 GTID 的 Binlog 文件,导致从服务器无法读取。

解决方案

报错详情

binlog probably contains events generated with statement or mixed based replication format

报错原因

MySQL 使用了 STATEMENT 或 MIXED 复制格式,而 Flink CDC 要求使用 ROW 格式。

解决方案

修改 MySQL 配置文件,将 binlog_format 设置为 ROW:

SET GLOBAL binlog_format = 'ROW';

报错详情

DELETE command denied to user 'userName'@'*.*.*.*' for table 'table_name'

报错原因

当使用 WHERE 条件过滤时,UPDATE 类型的数据会生成 update_before 和 update_after 两条记录,其中 update_before 会被识别为 DELETE 操作,因此需要用户具有 DELETE 权限。

解决方案

retract 操作。DELETE 权限。报错详情

sub account not auth permission

报错原因

RAM 用户没有权限下载 OSS 上的 Binlog 文件。

解决方案

为 RAM 用户添加下载备份文件的权限。

报错详情

The "before" field of UPDATE/DELETE message is null

报错原因

Postgres 表的 REPLICA IDENTITY 不为 FULL,导致 UPDATE 或 DELETE 操作的 before 字段为空。

解决方案

执行以下命令将表的 REPLICA IDENTITY 设置为 FULL:

ALTER TABLE yourTableName REPLICA IDENTITY FULL;

如果问题依旧存在,可以尝试添加参数 'debezium.slot.drop.on.stop' = 'true'。

报错详情

其他组件可以成功连接,但 MongoDB CDC 提示用户名密码错误。

报错原因

用户凭证是在特定数据库下创建的,而连接时未指定认证数据库。

解决方案

在 WITH 参数中添加:

'connection.options' = 'authSource=用户所在的DB'

报错原因

MongoDB CDC 连接器是独立开发的,不依赖 Debezium 项目,因此不支持 Debezium 相关参数。

解决方案

确保配置参数符合 MongoDB CDC 连接器的要求。

报错原因

在故障情况下,Canal、Maxwell 或 Debezium 可能会投递重复的变更事件到 Kafka,导致 Flink 查询结果异常。

解决方案

table.exec.source.cdc-events-duplicate 设置为 true。报错详情

Task did not exit gracefully within 180 + seconds.

报错原因

Task 退出超时,可能是自定义函数实现有问题(如 close 方法阻塞或计算方法长时间未返回)。

解决方案

task.cancellation.timeout 参数设置为 0,以避免超时。0。以上是针对 Flink CDC 常见报错的详细分析与解决方案。如果您的报错信息不在上述范围内,请提供具体的报错日志以便进一步分析。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。