Flink 基于磁盘的checkpoint,正常跑了很久,莫名其妙报 file not found?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在 Flink 中使用 Python 编写的 UDF(用户定义函数),可以通过以下步骤进行引用:

安装 Python UDF 依赖:在 Flink 的运行环境中,需要安装 Python UDF 相关的依赖库,如 flink-python、pyflink 等。确保您的环境中已正确安装这些依赖。

编写 Python UDF 函数:使用 Python 编写您的自定义函数,并确保函数的输入输出类型符合 Flink 的要求。可以使用装饰器 @udf(result_type=DataTypes.STRING()) 来标记函数为 UDF,并指定输出类型。

注册 Python UDF 函数:在 Flink 的作业中,使用 table_env.create_temporary_function() 方法来注册 Python UDF 函数,将其注册为可用的函数。

在 Flink SQL 或 Table API 中使用:在 Flink 的 SQL 或 Table API 中,可以直接通过函数名来引用已注册的 Python UDF 函数,并将其应用于数据处理的流程中。

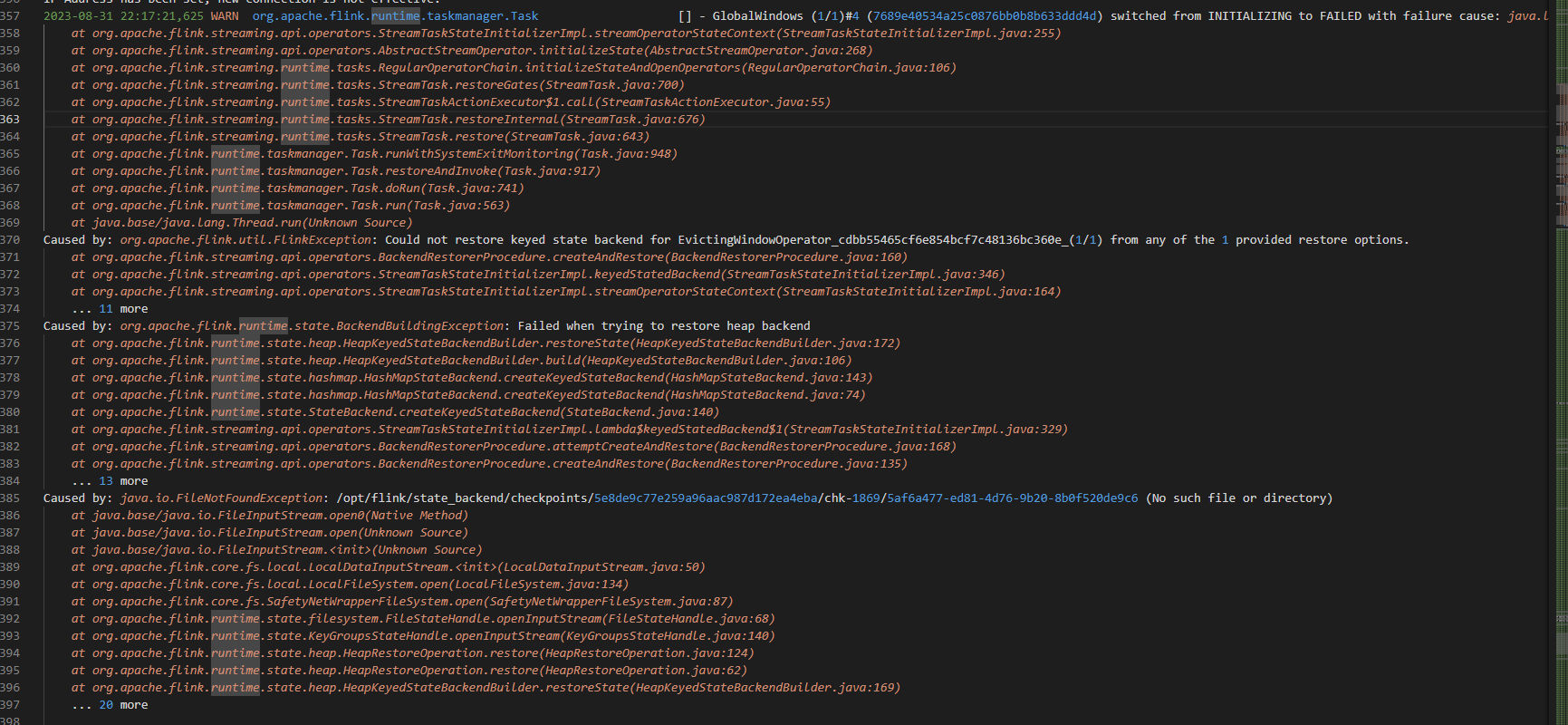

关于您提到的 Flink 基于磁盘的 checkpoint 报文件未找到的问题,可能有以下几个原因和解决方案:

检查文件路径:确认指定的文件路径是否正确,并确保 Flink 程序可以访问到该文件。

检查文件权限:确保 Flink 程序对该文件所在的目录拥有足够的读取权限。

检查文件是否存在:如果文件确实不存在,可能是由于文件被删除或移动导致的。确认文件是否存在,并根据需要进行相应的处理。

如果问题仍然存在,请提供更多详细的错误信息和上下文,以便能够提供更准确的帮助和解决方案。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。