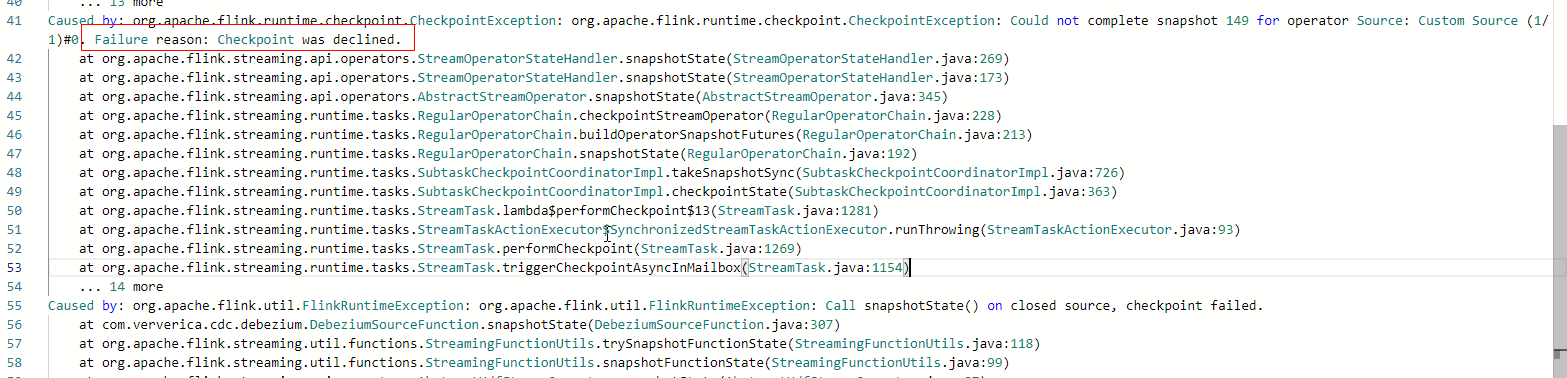

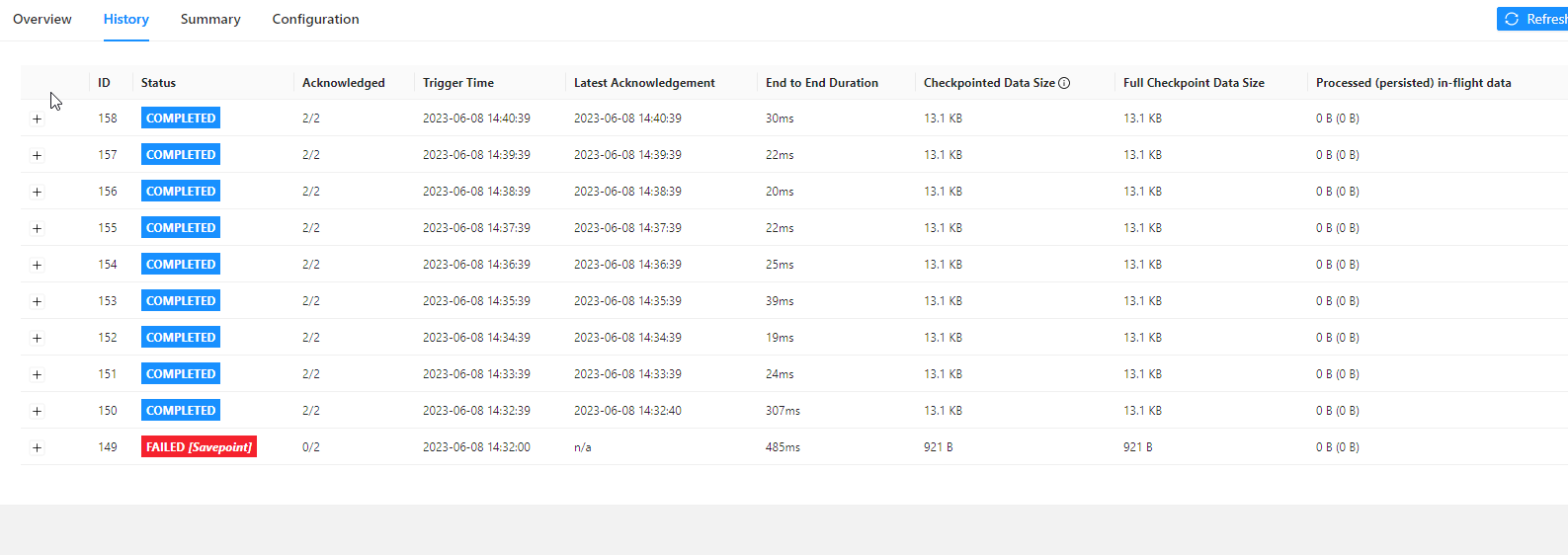

请问Flink CDC中执行savepoint时报这个错是什么原因呢,datastream 2.3 ? 定时checkpoint正常

定时checkpoint正常

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在Flink CDC中执行Savepoint时出现错误,而定时Checkpoint正常运行,可能的原因和解决方案如下:

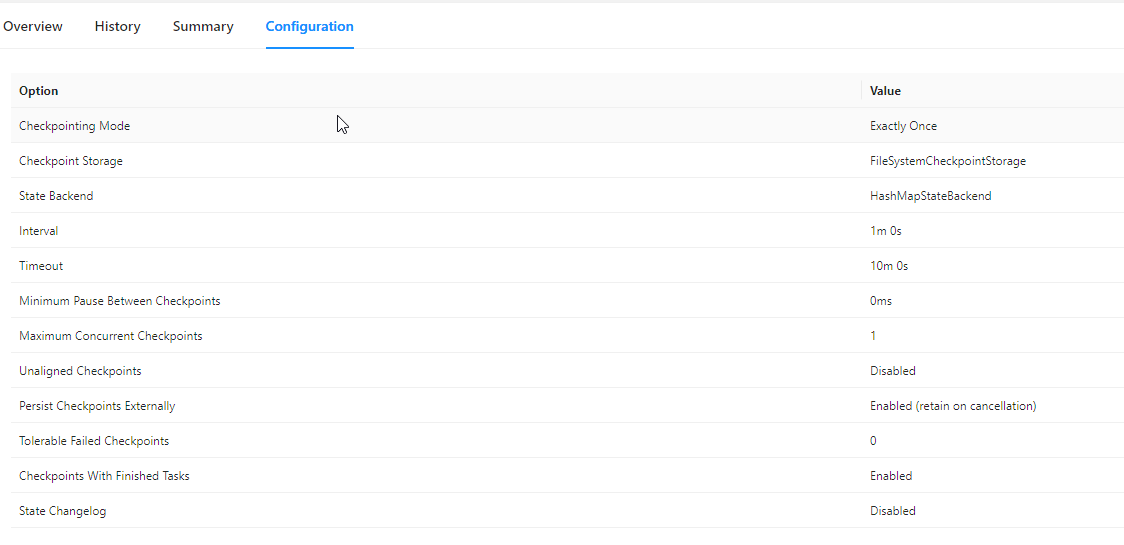

Savepoint和Checkpoint虽然都用于保存作业状态,但它们的机制和用途有所不同: - Checkpoint:由Flink系统自动管理,主要用于故障恢复,生命周期较短。 - Savepoint:由用户手动触发或通过配置生成,通常用于长期保存作业状态(如版本升级、作业迁移等)。

因此,Savepoint对状态一致性和数据完整性的要求更高,可能导致某些场景下Savepoint失败,而Checkpoint正常。

scan.incremental.snapshot.enabled)。如果启用,确保表有主键,因为增量快照需要主键来保证一致性。REPLICA IDENTITY设置为FULL,否则可能导致Savepoint失败。execution.checkpointing.timeout参数值。python.fn-execution.bundle.size和python.fn-execution.bundle.time参数,减少缓存数据量。SET GLOBAL expire_logs_days = 7;

oplog.rs集合的大小足够大,避免Resume Token对应的记录被清理。SELECT、DELETE等)。WHERE),确保用户具有DELETE权限,因为UPDATE_BEFORE会被识别为DELETE操作。ALTER TABLE your_table SET ('sink.savepoint.auto-tag' = 'true');

savepoint-${savepointID})。Can't find any matched tables:检查表名和数据库权限。The primary key is necessary:确保表有主键。Encountered change event for table whose schema isn't known:重新生成快照或检查Debezium配置。Savepoint失败的原因可能涉及状态兼容性、状态大小、数据源日志、权限配置等多个方面。根据上述分析,建议按照以下步骤逐一排查: 1. 检查Flink CDC连接器版本和配置。 2. 确保数据源日志保留时间足够长。 3. 优化状态大小,减少不必要的状态存储。 4. 检查用户权限,确保满足Savepoint需求。 5. 如果使用Paimon,开启Tag自动创建功能。

如果问题仍未解决,请提供具体的错误日志以便进一步分析。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。