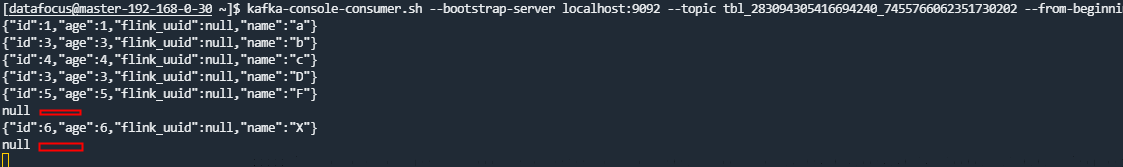

问题1:flink写入kafaka-upsert的记录,如果是删除的记录,写入看到是null.我想自己写代码消费kafka的数据,识别不出删除了哪条记录 这个得怎么搞呢?那我的场景是得自己消费kafka的数据,根据消息,通过业务系统的api去增加、删除数据等同步操作? 问题2:打日志是做标记?但是数据都没有了,标记了有什么 用呢?

这个得怎么搞呢?那我的场景是得自己消费kafka的数据,根据消息,通过业务系统的api去增加、删除数据等同步操作? 问题2:打日志是做标记?但是数据都没有了,标记了有什么 用呢?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

回答1:Key已经被删除了,你当然看不到了,你可以在cdc的入upsert-kafka的时候打个日志 回答2:你数据入upsert-kafka的时候打日志,此回答整理自钉群“Flink CDC 社区”