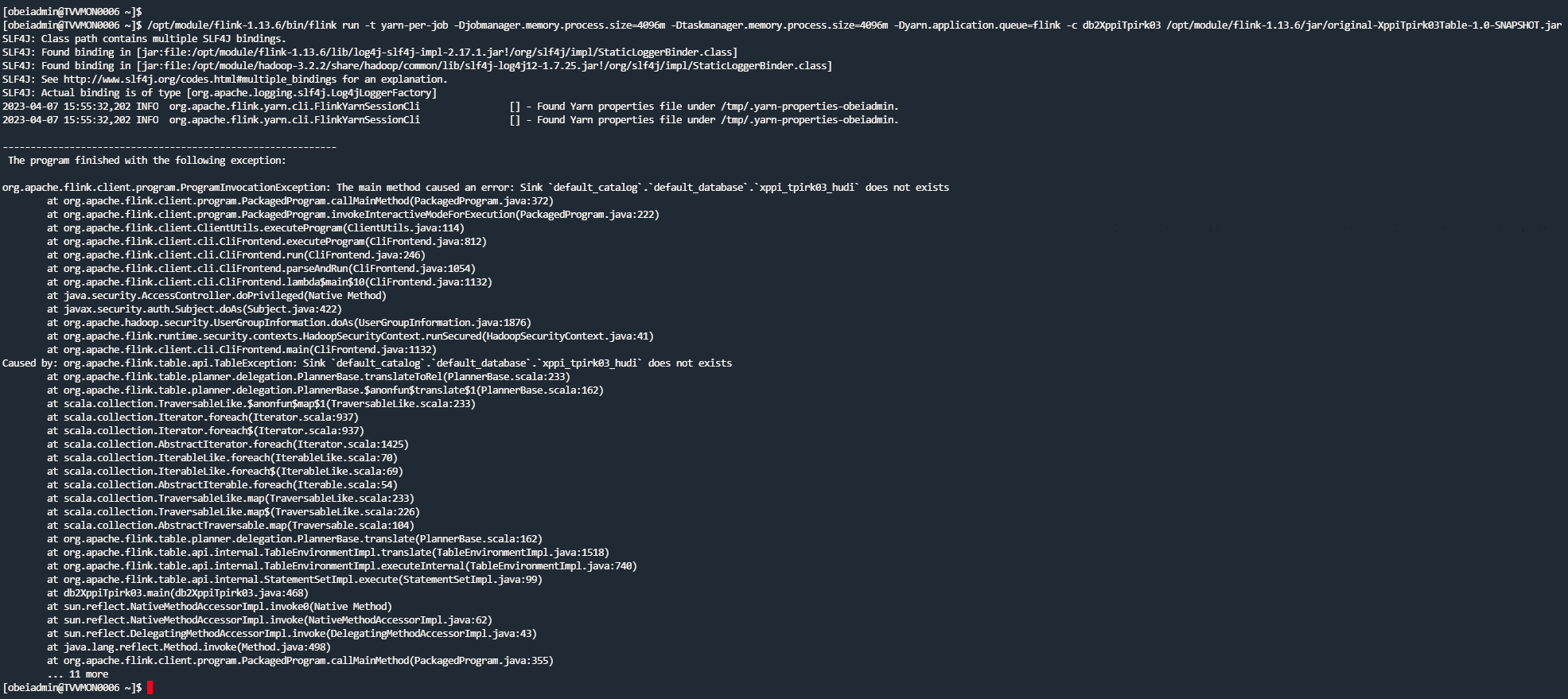

请教一下 这个报错是什么原因导致的?缺少什么jar包吗?flink sql sink hudi

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

根据您提供的信息,报错与Flink SQL Sink到Hudi相关,但具体错误信息未给出。不过,结合知识库中的参考资料,我们可以分析一些常见的问题及其解决方法,这可能对您遇到的情况有所启示。

JAR包依赖冲突或缺失

provided作用域来避免与Flink运行时环境的重复依赖。资源限制问题

如果作业在sink到Hudi过程中遇到如BackPressure Exceed Reject Limit的错误,可能是由于Hudi后端(如数据库、存储系统)压力过大导致的。检查并调整sink端的参数,比如增加写入重试次数rpcRetries。

配置问题

确认Flink作业的配置正确无误,特别是与Hudi sink相关的配置项,例如hoodie.datasource.write.keygenerator.class等。错误的配置可能导致作业无法正常执行。

Classloader冲突

如果遇到类加载异常,如java.lang.ClassCastException: org.codehaus.janino.CompilerFactory,可能是因为不同版本或实现的类库冲突。可以通过调整类加载器的策略来解决,例如设置classloader.parent-first-patterns.additional参数以优先加载特定的类库。

权限与网络问题

确保Flink任务有访问Hudi数据存储位置(如HDFS、S3、OSS)的适当权限,以及网络连接畅通无阻。

请根据这些指导思路检查您的环境和配置,定位具体的问题所在。如果以上建议未能解决问题,请提供更详细的错误信息以便进一步分析。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。