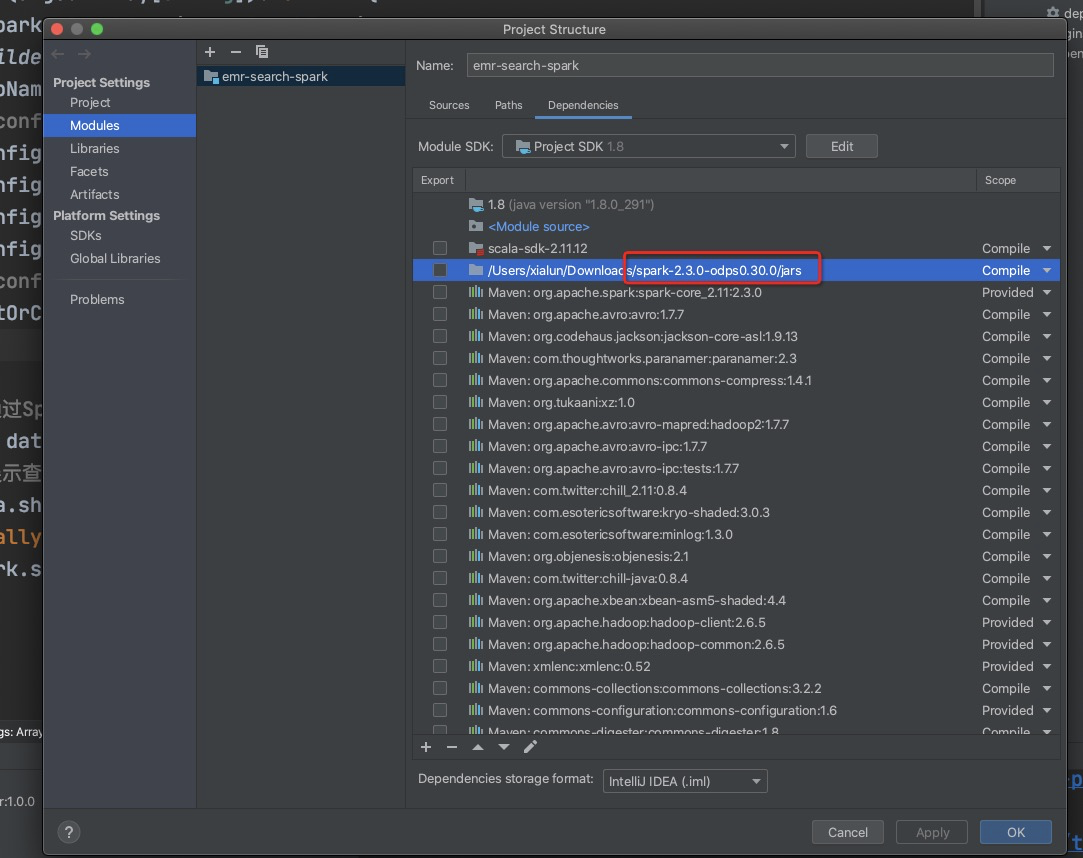

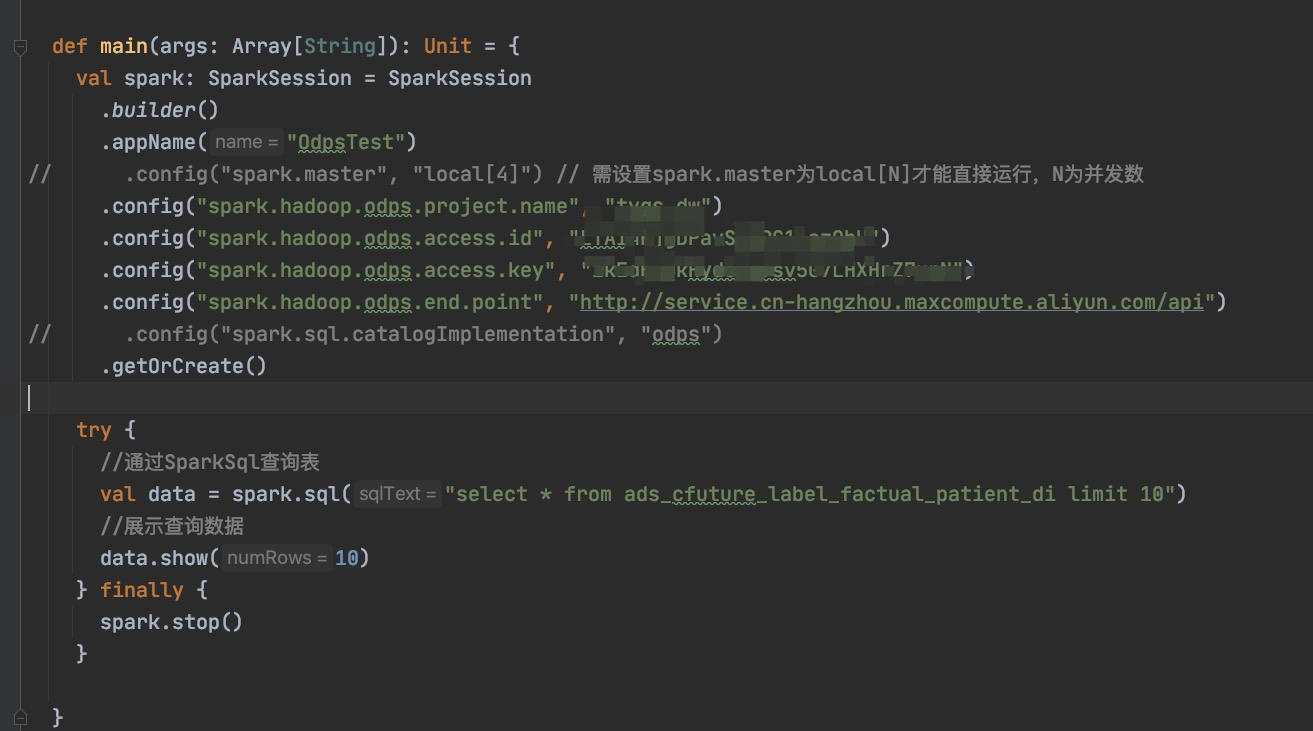

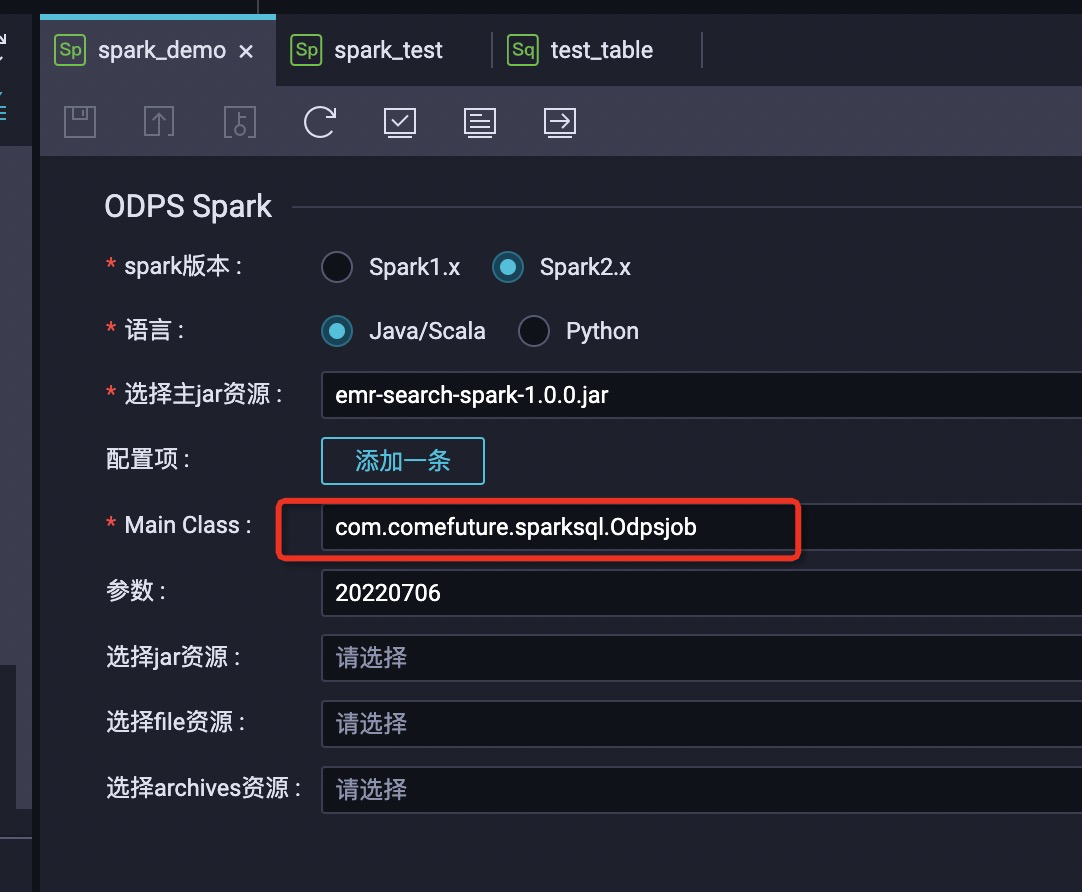

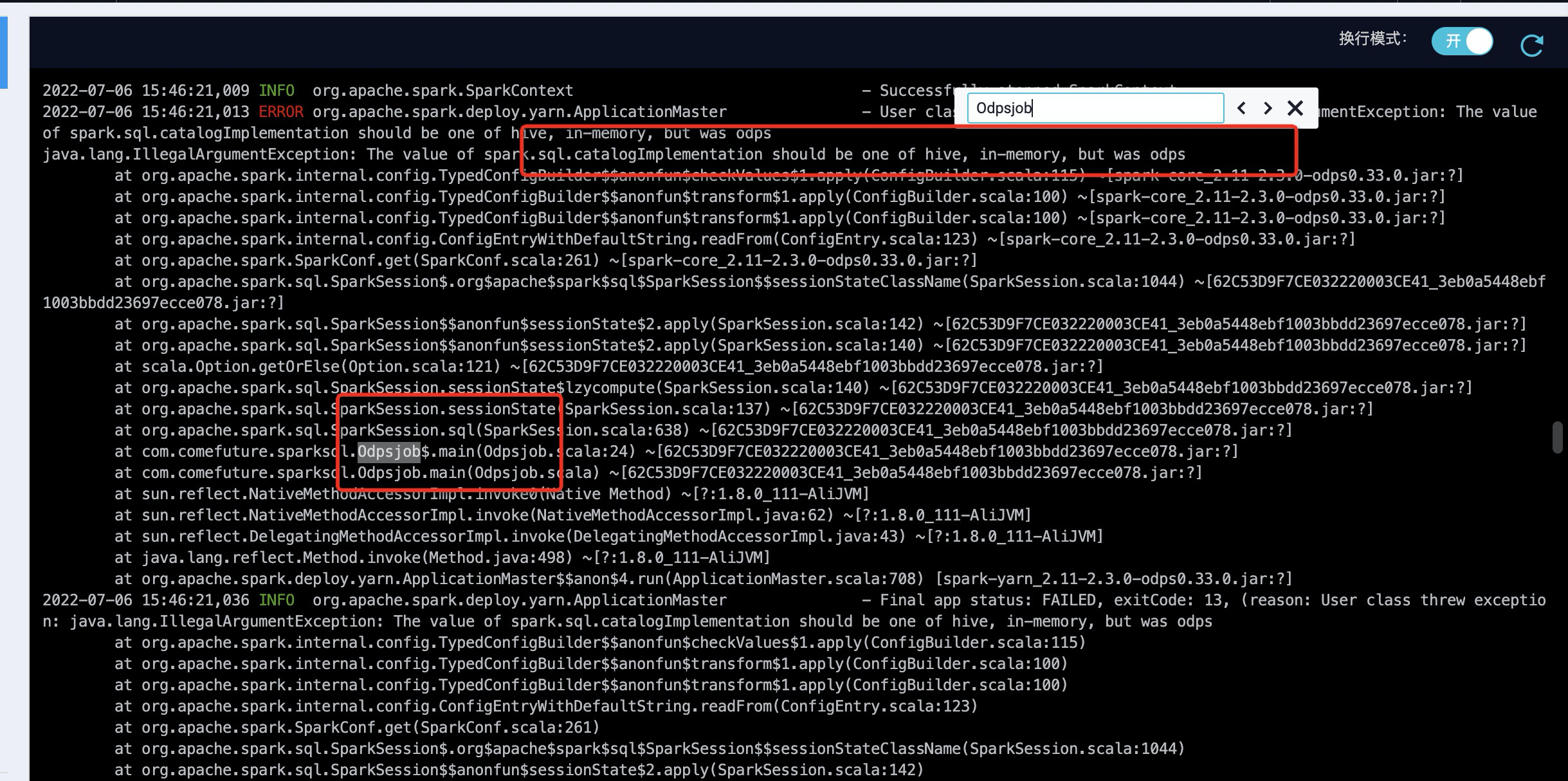

这些odps下的jar已经加进入了,然后界面上创建任务运行后还是提示the value of spark.sql.catalogimplementation should be one of hive in-memory but was odps,怎么回事?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

看下spark版本是2.3还是2.4; 加一下参数试试spark.sql.catalogImplementation Spark 2.3版本需要设置为odps,这个参数在代码中。Spark 2.4版本会改为hive,为了便于作业迁移,建议不要将该配置写在代码中(此答案整理自MaxCompute开发者社区2群)