使用是按照ModelScope模型介绍的示例的方式,怎么处理?

"

使用是按照ModelScope模型介绍的示例的方式,怎么处理?"

展开

收起

1

条回答

写回答

写回答

-

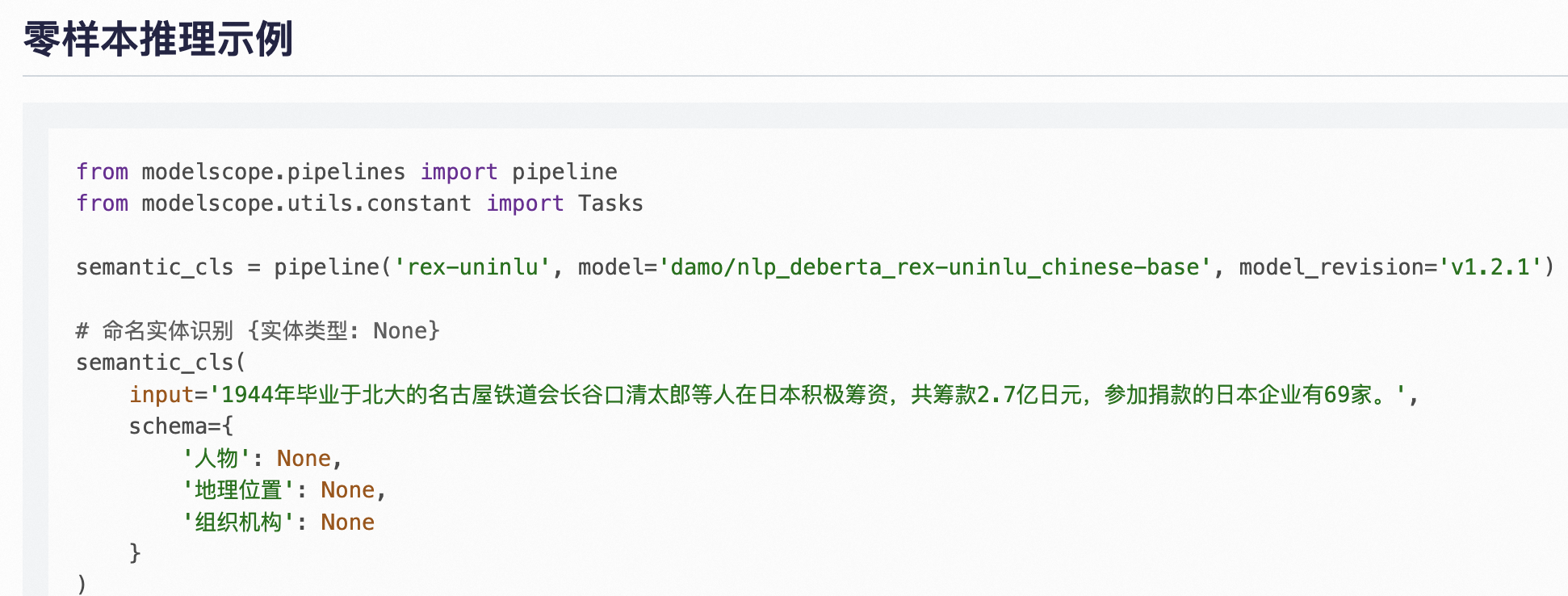

在使用ModelScope模型时,通常会遵循以下步骤来处理问题:

- 选择模型: 首先,你需要在ModelScope平台上找到适合你任务的模型。你可以通过搜索关键词、查看分类或浏览推荐来找到合适的模型。

- 阅读模型文档: 一旦选定模型,务必详细阅读模型的文档。文档通常会包含模型的介绍、适用场景、性能指标、使用示例以及依赖库等重要信息。

- 安装和导入: 根据文档的指示,安装必要的Python库(如

modelscope或huggingface等),然后在代码中导入模型。例如,如果使用Hugging Face的Transformers库,你可能会看到类似以下的代码:

python from transformers import AutoModel, AutoTokenizer model = AutoModel.from_pretrained("model_name") tokenizer = AutoTokenizer.from_pretrained("model_name")- 预处理数据: 使用模型的tokenizer对输入数据进行预处理,将其转换为模型可以接受的格式。例如:

python input_ids = tokenizer.encode("your text here", return_tensors="pt")- 模型推理: 调用模型进行预测或推理。这可能包括编码、解码、分类等操作,具体取决于模型的用途:

python outputs = model(input_ids)- 后处理结果: 对模型的输出进行后处理,得到最终的结果。例如,对于生成任务,可能需要解码输出的tokens;对于分类任务,可能需要提取logits并转换为类别:

python decoded_text = tokenizer.decode(outputs[0])- 运行示例代码: 根据模型文档中的示例代码,将你的输入数据替换到代码中,运行并查看输出。确保你的环境设置正确,所有依赖都已安装。

- 调整参数: 根据需要,可能需要调整模型的超参数,以优化模型在你的特定任务上的性能。

- 保存和加载模型: 为了以后使用或部署,你可以保存模型的权重,以便在需要时快速加载:

python model.save_pretrained("path/to/save") # 加载模型 model = AutoModel.from_pretrained("path/to/save")- 持续学习和优化: 根据模型的表现和需求,你可能需要进一步训练模型,或者寻找其他模型进行对比。

确保在整个过程中,你密切关注任何错误消息,以便及时解决可能出现的问题。如果遇到困难,ModelScope的文档、官方论坛或开发者社区通常会提供帮助。

2024-05-01 18:57:23赞同 展开评论 打赏

相关问答

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉群号:44837352

热门讨论

热门文章

ModelScope qwen7b、14b、72b lora微调分别需要的显存和cpu内存是多少?

5446

ModelScope有部署qwen2-72b的么,正常推理需要多大的显存?

4239

modelscope下载 的模型 如何转ollama

610

ModelScope中,模型下载默认路径在哪个路径?

10259

modelscope-funasr的FunClip怎么安装的?

2424

com/action/joingroup?code=v1是什么意思

7647

modelscope上跑报错,提示要pip install ttsfrd,搞不定

7855

通义千问2.5-7B-Instruct已经下载到本地为什么使还需要联网?而且最近下载模型也提示400

783

无法导入 modelscope,已经pip install了

3726

CUDA error: CUDA-capable device(s) is busy

575

展开全部

阿里云通义千问向全社会开放!

51262

multi-agent:多角色Agent协同合作,高效完成复杂任务

34153

Llama 3开源,魔搭社区手把手带你推理,部署,微调和评估

12316

通义千问72B、1.8B、Audio模型开源!魔搭社区最佳实践来啦!

6092

智胜未来:国内大模型+Agent应用案例精选,以及主流Agent框架开源项目推荐

2356

vanna+qwen实现私有模型的SQL转换

5397

CosyVoice 2.0:阿里开源升级版语音生成大模型,支持多语言和跨语言语音合成,提升发音和音色等的准确性

133

自然语言处理Transformer模型最详细讲解(图解版)

6994

POINTS 1.5:腾讯微信开源的多模态大模型,超越了业界其他的开源视觉语言模型,具备强大的视觉和语言处理能力

124

Kimi 上线视觉思考模型,K1 系列强化学习模型正式开放,无需借助外部 OCR 处理图像与文本进行思考并回答

122

展开全部