如下,机器学习PAI的这个问题怎么解决?

kafka流式数据无法实时sink到MySQL,这个问题怎么处理的?

展开

收起

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

1

条回答

写回答

-

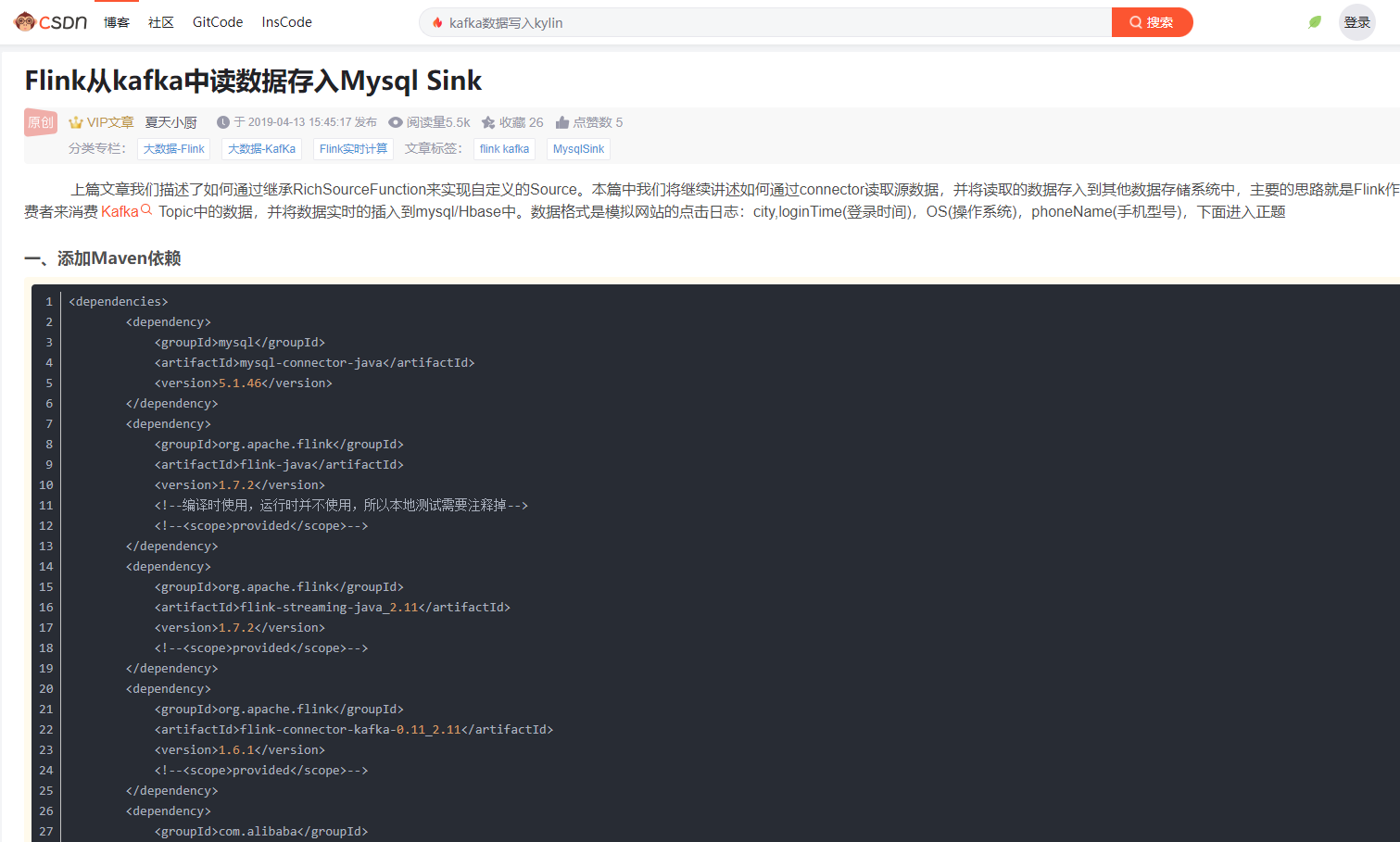

本篇中我们将继续讲述如何通过connector读取源数据,并将读取的数据存入到其他数据存储系统中,主要的思路就是Flink作为消费者来消费Kafka Topic中的数据,并将数据实时的插入到mysql/Hbase中。数据格式是模拟网站的点击日志:city,loginTime(登录时间),OS(操作系统),phoneName(手机型号),下面进入正题 https://blog.csdn.net/a_drjiaoda/article/details/89219274

2023-10-21 15:40:07赞同 展开评论

2023-10-21 15:40:07赞同 展开评论

相关问答

人工智能平台 PAI(Platform for AI,原机器学习平台PAI)是面向开发者和企业的机器学习/深度学习工程平台,提供包含数据标注、模型构建、模型训练、模型部署、推理优化在内的AI开发全链路服务,内置140+种优化算法,具备丰富的行业场景插件,为用户提供低门槛、高性能的云原生AI工程化能力。

相关文章

热门讨论

热门文章

还有其他疑问?

咨询AI助理