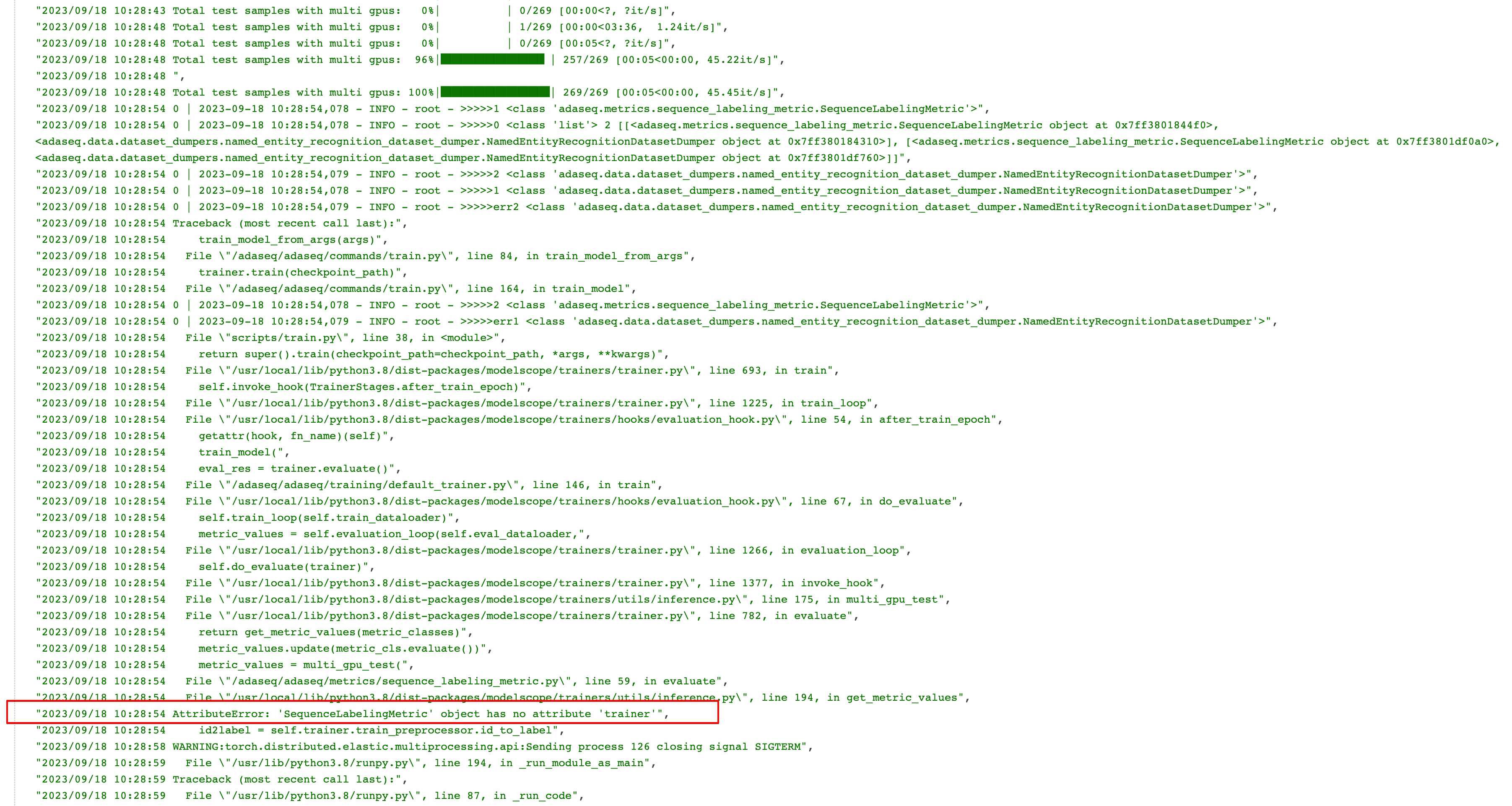

ModelScope中单机2卡和多机2卡都报下面的错误,单机1卡则能跑通 麻烦验证下看看是什么问题

ModelScope中 跑adaseq bert-crf例子(https://github.com/modelscope/AdaSeq/blob/master/examples/bert_crf/configs/maoe_example.yaml)

跑adaseq bert-crf例子(https://github.com/modelscope/AdaSeq/blob/master/examples/bert_crf/configs/maoe_example.yaml)

环境:torch1.11.0,modelscope1.8.4,adaseq0.6.4

单机2卡命令:python -m torch.distributed.launch --nproc_per_node=2--master_port=29527 scripts/train.py -c $config

异常:单机2卡和多机2卡都报下面的错误,单机1卡则能跑通

麻烦验证下

展开

收起

1

条回答

写回答

写回答

-

您参考一下这里的分布式训练https://modelscope.cn/docs/%E8%AE%AD%E7%BB%83%E7%9A%84%E8%AF%A6%E7%BB%86%E5%8F%82%E6%95%B0 或者您github上开个issue,多卡的情况我这边暂时还没法复现哦。——此回答整理自钉群:魔搭ModelScope开发者联盟群 ①

2023-09-27 22:44:22赞同 展开评论 打赏

相关问答

热门讨论

热门文章

com/action/joingroup?code=v1是什么意思

7211

ModelScope中,模型下载默认路径在哪个路径?

9701

我希望通过damo-YOLO训练1500*1500的图片

8685

请问在 ModelScope 上的模型断网使用报这个错误啥原因了?

2236

服务器上onnxruntime-gpu 调用结束,如何释放显存

5241

ModelScope中我尝试使用这个模型搭建了一个推理服务,然后报错了怎么办?

3490

ModelScope中,大佬们4卡跑lora时,遇到这样的错,怎么解决?

1960

ModelScope有没有人知道windows安装ttsfrd的方法或者ttsfrd源码?

836

streamlit 生成链接无法访问,gradio只生成内网,无法生成公网

2672

modelscope cache 环境变量是啥?

2754

展开全部