DataWorks中kafka实时同步到odps?

DataWorks中kafka实时同步到odps?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

-

北京阿里云ACE会长

在阿里云DataWorks中,可以通过MaxCompute(ODPS)和Kafka的集成来实现Kafka实时同步到ODPS的功能。具体步骤如下:

在DataWorks中创建MaxCompute项目和Kafka Topic,分别作为数据的存储和流入源。

在Kafka Topic的配置中,配置数据源和数据目的地,指定MaxCompute(ODPS)作为数据的目的地。

在Kafka Topic中定义数据的Schema,确定数据的格式和字段信息。2023-07-21 19:30:45赞同 展开评论 -

在 DataWorks 中,要实现 Kafka 到 MaxCompute(ODPS)的实时同步,可以采用以下步骤:

创建项目:在 DataWorks 控制台中创建一个项目,用于管理和组织数据同步任务。

创建数据源:在项目中创建两个数据源,一个用于连接 Kafka,另一个用于连接 MaxCompute。选择 "新建数据源",然后根据你的配置提供 Kafka 和 MaxCompute 的相关参数、认证信息等。

创建数据集:在项目中创建两个数据集,一个用于读取 Kafka 数据,另一个用于写入 MaxCompute。选择 "新建数据集",选择对应的数据源,配置相关参数,以便正确读取和写入数据。

创建同步任务:在项目中创建一个同步任务,用于将 Kafka 数据实时同步到 MaxCompute。选择 "新建同步任务",然后配置任务名称、描述等基本信息。

配置同步任务:在同步任务的配置页中,设置数据源和数据集的映射关系,指定 Kafka 数据集作为源数据集,MaxCompute 数据集作为目标数据集。

编写脚本或配置转换规则:根据需要,你可以编写脚本或配置转换规则,以处理从 Kafka 读取的数据,并将其转换为符合 MaxCompute 格式要求的数据。

调度和启动任务:设置同步任务的调度时间、频率和触发条件等,确保任务能够按照你的需求自动执行。保存并启动同步任务。

监控和查看结果:一旦同步任务开始执行,你可以在 DataWorks 控制台的任务监控页面中跟踪任务的执行进度和状态。完成后,你可以查看数据是否成功同步到 MaxCompute 中。

2023-07-18 09:46:54赞同 展开评论 -

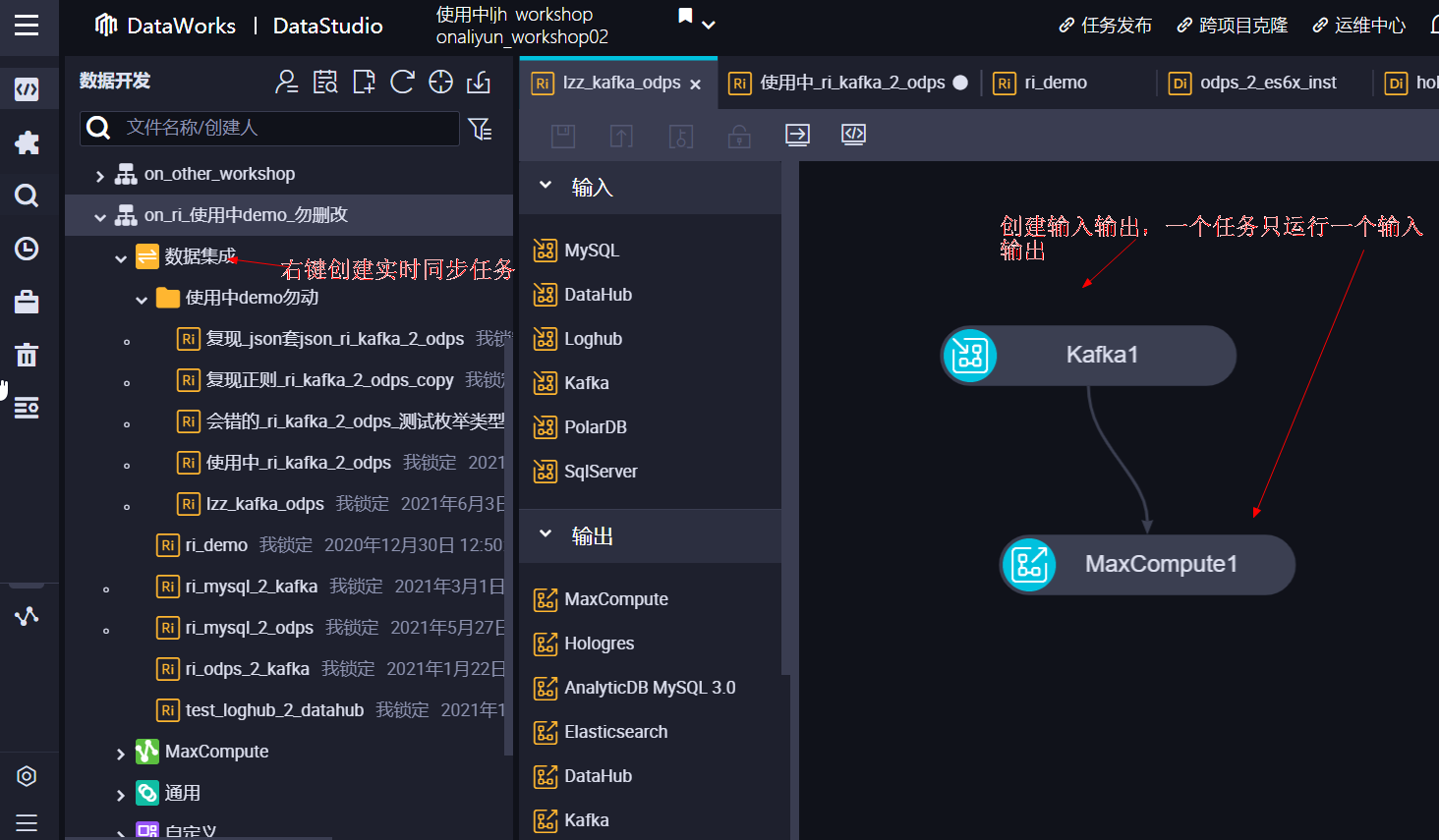

创建实时同步任务:

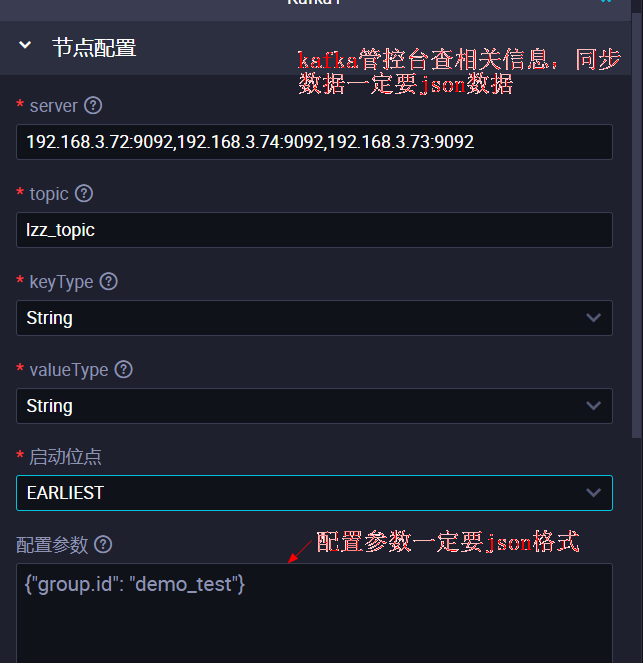

配置输入参数:

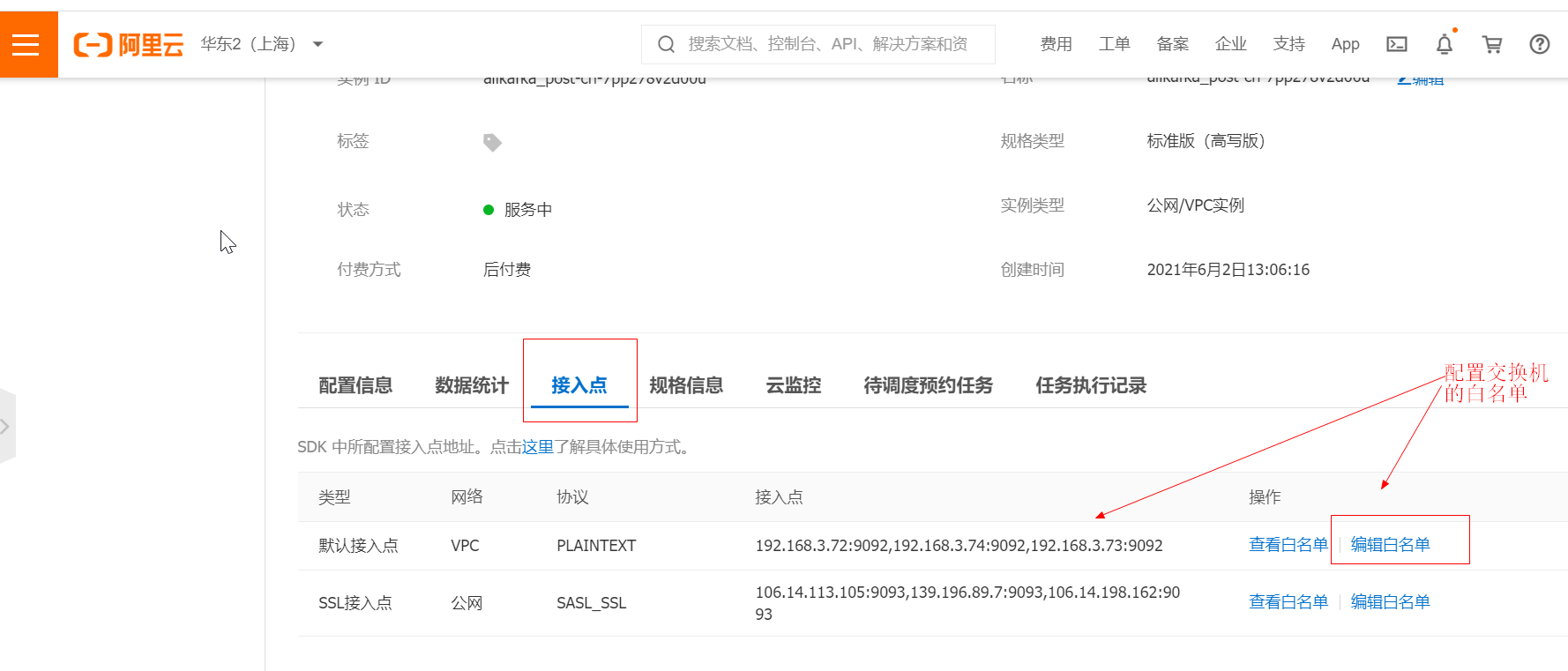

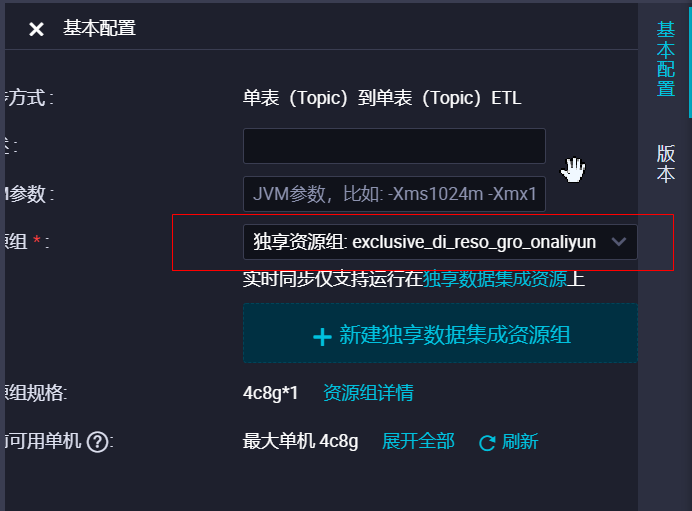

在kafka管控台找server信息,如下图:(注意:实时同步只能运行在独享数据集成资源组上,下面界面要配置独享资源组白名单)

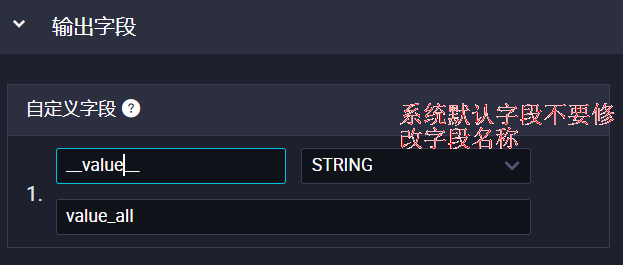

添加输出参数:

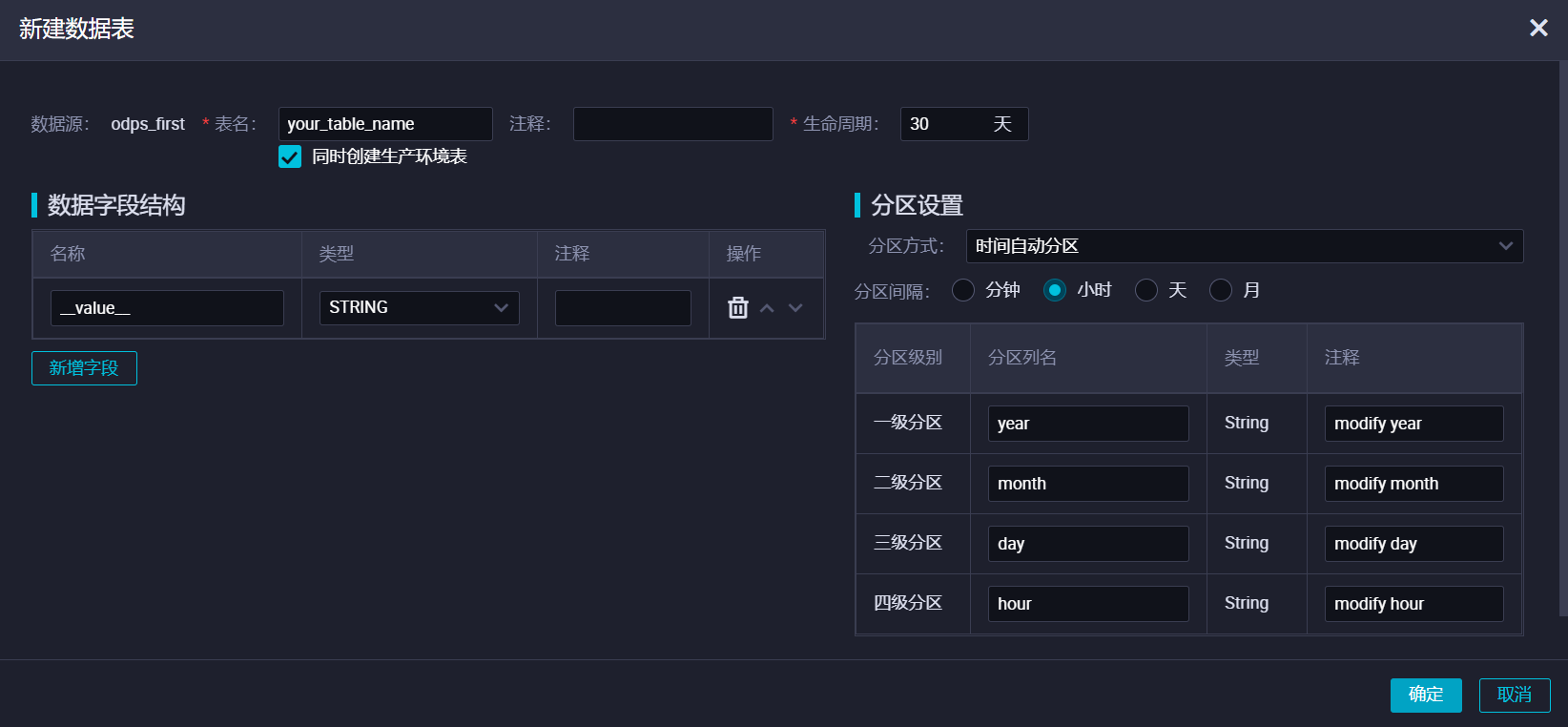

新建目标表,设置分区:

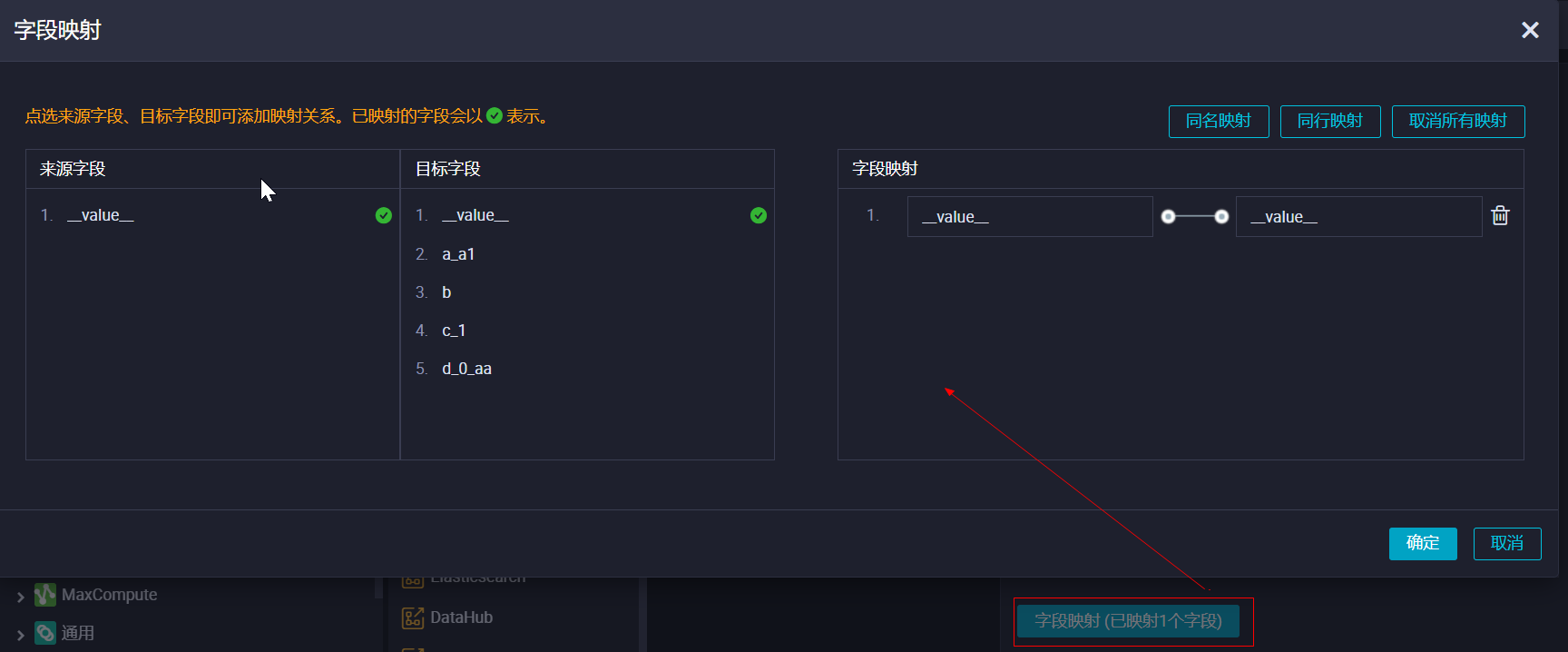

创建映射字段:

配置资源组:

运维中心查看日志:

,此回答整理自钉群“DataWorks交流群(答疑@机器人)”2023-07-16 14:04:50赞同 展开评论

DataWorks基于MaxCompute/Hologres/EMR/CDP等大数据引擎,为数据仓库/数据湖/湖仓一体等解决方案提供统一的全链路大数据开发治理平台。