在机器学习PAI中useRemoteEnv也需要在对应的flink集群安装对应的S3插件吗?

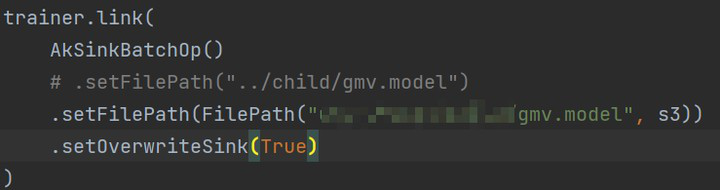

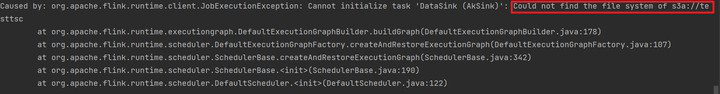

现在能访问S3文件系统了,但是又有个新的问题,现在我们代码里面使用useRemoteEnv("XXX", 8080, 1),通过远程提交的方式提交python代码到我们的云服务上面,然后通过下面的方法尝试把模型放到S3上,结果报了下面的错误.请问下老师,在机器学习PAI中useRemoteEnv也需要在对应的flink集群安装对应的S3插件吗?类似于下载对应的jar包,然后添加到 Flink 的 lib 目录。

展开

收起

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

1

条回答

写回答

-

和你提交机一样,在某个目录下放plugin就行,最简单的方法,就是弄个镜像,提交机,远程都用同一个镜像就行,镜像里边单机可以跑过,远程就都可以了。此回答整理自钉群“Alink开源--用户群”

2023-05-29 11:45:23赞同 展开评论

问答分类:

相关问答

人工智能平台 PAI(Platform for AI,原机器学习平台PAI)是面向开发者和企业的机器学习/深度学习工程平台,提供包含数据标注、模型构建、模型训练、模型部署、推理优化在内的AI开发全链路服务,内置140+种优化算法,具备丰富的行业场景插件,为用户提供低门槛、高性能的云原生AI工程化能力。

收录在圈子:

+ 订阅

相关文章

热门讨论

热门文章

展开全部

还有其他疑问?

咨询AI助理