分享99个ASP整站程序源码,总有一款适合您

99个ASP整站程序源码下载链接:https://pan.baidu.com/s/1nKDDakDyOid5H8aXM87BzA?pwd=8i5g

提取码:8i5g

Python采集代码下载链接:采集代码.zip - 蓝奏云

import os import shutil import requests from bs4 import BeautifulSoup from framework.base.BaseFrame import BaseFrame from sprider.access.SpriderAccess import SpriderAccess from sprider.plugin.SpriderTools import SpriderTools from sprider.plugin.UserAgent import UserAgent class CNSourceCoder: base_url = "http://www.downcode.com" max_pager = 10 # 每页的数量 影响再次采集的起始位置. word_image_count = 5 # word插入图片数量 同时也是明细采集图片和描述的数量 page_end_number = 0 word_content_list = [] haved_sprider_count = 0 # 已经采集的数量 sprider_detail_index = 0 # 明细方法采集的数量 累加

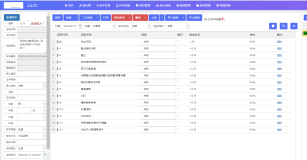

Web590网上书店系统

小天设计1.0

星蒴网站管理系统 V1.0

93度网站管理系统

中国风行天下网络企业网站 V2.0

企业网站智能管理系统中英文版 V3.5

中国网址库(清爽终结版)

易华自助系统企业精简版

60度 2006版(内核动易2006最新程序)

FY CMS 3.0免费版本

仿百度链程序

玉溪人才招聘网

爱情公寓整站程序

帅气男孩个人网站(破解版)

轩魂国度设计企业VS个人全站V4.0

D摘网 V2.0 完整版

精心设计网管理系统V1.0版本

小屋工作室2006-4-10更新

265888资源空间

大舜网络整站系统 V0.13.3 Build 0420

徐州百姓生活网V8.2破解版

精诚网络全站程序

最新仿黑软基地新云网站管理系统

俪人网整站程序

驴友格子Sql V1.2

FLASHZ网采集程序(直接生成HTML)

嘉缘人才网站自建系统V4.01免费版

清新淡雅的个人主页整站程序

世纪飞星个人主页程序 V2.0

好玩吧免费百万流量格子

行业信息网 2.0

商城网店系统整站程序

中国晴网信息港2.0(带万数据)

Myweb企业网站系统综合版

幸运格子V2.0

QQ娱乐资源网音乐插件版

简单生活V2.2个人网

烧饼工作室2.0版(漂亮的门户网站)

[韩式风格]皖西学院计应0401班同学录V2.0无错版!铜陵何飞倾情奉献!

中国建站吧-格子联盟美化版

奉新娱乐网

合肥达美装饰工程安庆分公司

倚锋科技智能网站系统 V3.0

恒浪整合动易2005+网友翻唱+动网 V7.1sp1+Oblog V3.12 整合版

满洲里飞雨工作室 V3.14

惠州生活网鲜花网整站程序

倚锋科技旅游系统2.0

半轮秋整站程序1.2

暗礁工作室全站

F-Zone V1.0 仿Q-ZONE程序无组件版

ReaKun个人主页 V2.0

落日全站╅蓝色贝壳╆美化版 V4.0

飞扬网络CMS2006免费版

终点文学SQL清风修改版

Cc驿站Version1.5(完美版)

个人家园申请系统

我搜我房专业房地产信息网站(仿搜房网)

BMCMS 1.0企业建站系统

V2兴业视窗全站程序

孤鹜网络整站系统V1.01

老笨大型社区信息港综合门户程序

亚特网站管理系统(TradeCMS) V2006

自由地带 V1.0.1127

王子俱乐部 整站系统(FLASH 站)

茂名信息网3.0加强版

笨笨滴窝全站程序 V1.0

一个人的空间[完整版]

唯雪个人求职网

康网博客2006 V1.11

运城生活网最新4.5升级版

安庆创意百货公司网站管理系统

爱的风狂 V1.0

网盟轩V1.0修正版

广安计算机信息中心整站

动易2005SP2核心-7COLOR工作室整站程序

60度模板(Edron 网络 杨健设计 生鱼片网络)

17UX『一起游戏装备交易』V6共享版

FLASH动漫网

七彩天空整站程序

Wj8.Net春来春往酷站大全

离子星全站(含QQ迷你门户)

七夕情人节

聂枫设计 V2.1

合肥高校联盟 V2.0 完整版

民政信息

家住蕲春全站V2.1

金无忧多用户博客

仿百度贴吧

52ks博摘

def sprider(self,sprider_name,sprider_count,start_number, pager_number,sprider_type,is_show_browse,root_path, first_column_name,second_column_name,is_record_db): """ http://www.downcode.com/sort/j_1_2_1.shtml :param sprider_name: :return: """ self.first_folder_name=sprider_type.upper() self.base_path=root_path self.first_column_name = first_column_name self.second_column_name = second_column_name self.sprider_start_count=start_number self.is_record_db=is_record_db BaseFrame().debug("开始采集[源码下载站]" + self.first_folder_name + "源码...") BaseFrame().right("本次采集参数:sprider_count(采集数量):" + str(sprider_count) + "") BaseFrame().right("本次采集参数:sprider_name(采集名称):" + sprider_name + "") sprider_url = self.base_url + "/{0}/{1}_1.shtml".format(self.first_column_name, self.second_column_name)# 根据栏目构建URL BaseFrame().debug("本次采集参数:sprider_url:" + sprider_url) self.second_folder_name = str(sprider_count) + "个" + sprider_name # 二级目录也是wordTitle self.merchant = int(self.sprider_start_count) // int(self.max_pager) + 1 # 起始页码用于效率采集 self.file_path = self.base_path + os.sep + self.first_folder_name + os.sep + self.second_folder_name BaseFrame().right("本次采集参数:file_path=" + self.file_path + "") # 浏览器的下载路径 self.down_path = self.base_path + os.sep + self.first_folder_name+ os.sep + self.second_folder_name+ "\\Temp\\" BaseFrame().right("本次采集参数:down_path=" + self.down_path + "") # First/PPT/88个动态PPT模板/动态PPT模板 self.save_path = self.base_path + os.sep + self.first_folder_name + os.sep + self.second_folder_name + os.sep + sprider_name BaseFrame().right("本次采集参数:save_path=" + self.save_path + "") if os.path.exists(self.down_path) is True: shutil.rmtree(self.down_path) if os.path.exists(self.down_path) is False: os.makedirs(self.down_path) if os.path.exists(self.save_path) is True: shutil.rmtree(self.save_path) if os.path.exists(self.save_path) is False: os.makedirs(self.save_path) response = requests.get(sprider_url, timeout=10, headers=UserAgent().get_random_header(self.base_url)) response.encoding = 'gb2312' soup = BeautifulSoup(response.text, "html5lib") #print(soup) element_list = soup.find_all('div', attrs={"class": 'j_text_sort_a'}) page_end_number = 1 page_end_url = "" page_end_title = soup.find("a", attrs={"title": '最后页'}) page_end_url = page_end_title.get("href") if page_end_url is None or page_end_url == "": page_end_number = 1 else: page_end_number = (page_end_url.split(".shtml")[0].split("_")[3]) self.page_count = self.merchant while self.page_count <= int(page_end_number): # 翻完停止 try: if self.page_count == 1: self.sprider_detail(element_list, page_end_number,sprider_count) pass else: if int(self.haved_sprider_count) == int(sprider_count): BaseFrame().debug("sprider采集到达数量采集停止...") BaseFrame().debug("开始写文章...") SpriderTools.builder_word(self.second_folder_name, self.word_content_list, self.file_path, self.word_image_count, self.first_folder_name) SpriderTools.copy_file(self.word_content_list, self.save_path, self.second_folder_name, self.file_path) SpriderTools.gen_passandtxt(self.second_folder_name, self.word_content_list, self.file_path) BaseFrame().debug("文件编写完毕,请到对应的磁盘查看word文件和下载文件!") break next_url = self.base_url + "/{0}/{1}_{2}.shtml".format(self.first_column_name, self.second_column_name, self.page_count) response = requests.get(next_url, timeout=10, headers=UserAgent().get_random_header(self.base_url)) response.encoding = 'gb2312' soup = BeautifulSoup(response.text, "html5lib") element_list = soup.find_all('div', attrs={"class": 'j_text_sort_a'}) self.sprider_detail(element_list, page_end_number,sprider_count) pass self.page_count = self.page_count + 1 # 页码增加1 except Exception as e: BaseFrame().error("sprider()执行过程出现错误:" + str(e))

紫色雨真爱永恒版

我就爱乐娱乐站

宇森流量广告交易平台文本链

汉中泰奇互动整站

优秀企业整站(英文版)

优秀企业通用网站

媒体中国韩国酷站网址大全

美加喜房产中介程序

飞马驿站全站程序

老崔家园整站程序[后台管理补丁]

最后送大家一首诗:

山高路远坑深,

大军纵横驰奔,

谁敢横刀立马?

惟有点赞加关注大军。