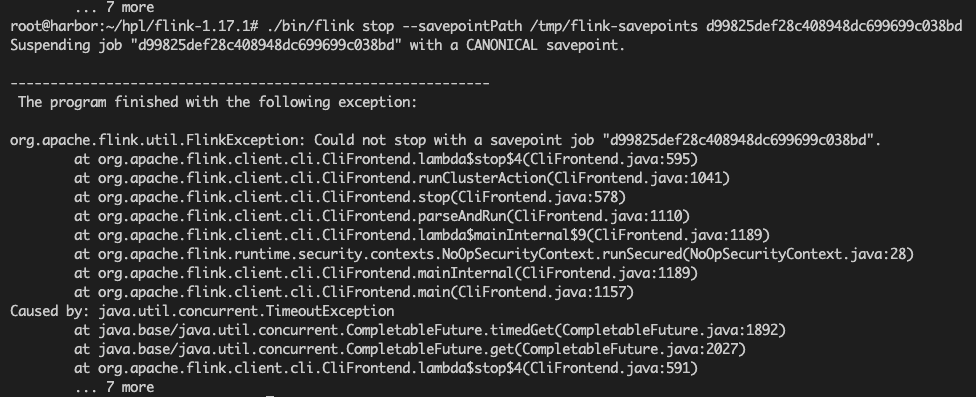

我想保存Flink savepoint,却报超时错误,应该如何处理呀?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

Flink在保存savepoint时出现超时错误,可能是由于任务执行时间过长或者网络问题导致的。你可以尝试以下方法来解决这个问题:

withSavepointDisposalTimeout参数来增加超时时间。例如,使用Python API时,可以这样设置:env.enable_checkpointing(interval=60 * 1000, min_pause_between_checkpoints=60 * 1000)

savepoint = env.get_checkpoint_status("your-savepoint-path", with_options=CheckpointOptions().with_savepoint_disposal_timeout(3600 * 1000))

优化任务性能:检查你的Flink任务,看是否有可以优化的地方,例如减少数据倾斜、优化数据源和sink的读写速度等。

检查网络状况:确保Flink集群的网络连接正常,没有丢包或延迟过高的情况。

升级Flink版本:如果问题仍然存在,可以尝试升级到最新的Flink版本,看看是否解决了问题。

联系社区支持:如果以上方法都无法解决问题,可以联系Apache Flink社区支持,他们会帮助你进一步排查问题。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。