大数据计算MaxCompute在idea下的Local模式下运行Spark,报错怎么排查这个问题啊?

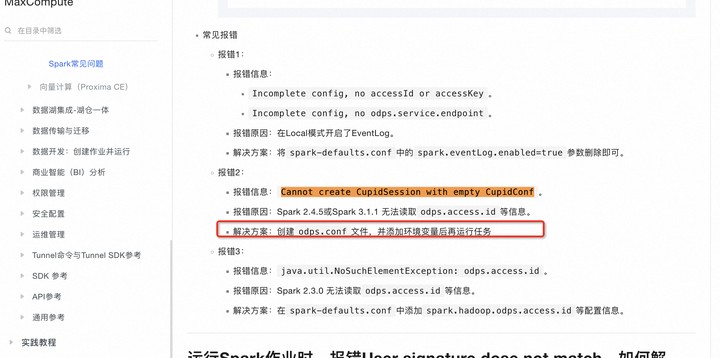

Cannot create CupidSession with empty CupidConf.

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

根据提供的信息,如果你在MaxCompute中在idea下的Local模式下运行Spark时,遇到了Cannot create CupidSession with empty CupidConf.的错误,你可以使用以下方法进行排查:

这个错误提示表明CupidSession无法使用空的CupidConf创建。CupidConf是用于配置Spark应用程序的参数的对象,因此需要确保在创建CupidSession之前正确设置了所有必要的参数。

以下是一些可能的解决方案:

这个错误信息表明MaxCompute在IDEA下的Local模式下运行Spark时,无法创建CupidSession。CupidSession是MaxCompute的一个重要组件,用于连接MaxCompute集群并执行Spark任务。

要解决这个问题,你可以尝试以下几种方法:

这个问题可能是由于CupidSession的创建失败导致的。为了解决这个问题,你可以尝试以下步骤:

检查你的代码中是否正确设置了CupidConf。确保所有的配置项都已经正确设置,并且没有遗漏任何必要的参数。

检查你的环境变量是否已经正确设置。特别是CUPINST_HOME和CUPINST_CONF这两个环境变量,它们分别指向了Cupid安装目录和配置文件的位置。

查看错误日志。在运行Spark任务时,Cupid会生成一些日志文件,这些文件可以帮助你定位问题。你可以查看这些日志文件,看看是否有任何错误信息或者警告信息。

如果以上步骤都无法解决问题,你可以尝试升级到最新版本的Cupid,或者尝试使用其他的大数据计算引擎,如Hadoop、Spark等。

先用spark客户端或者DataWorks的spark节点运行一下吧。idea上我这边测试也有识别不到conf的问题出现,需要升级研发帮忙看下

运行模式:https://help.aliyun.com/zh/maxcompute/user-guide/running-modes?spm=a2c4g.11186623.0.0.296d991aTbBIbY

### 注意,如果使用spark 2.4.5及以上的版本,需要在代码中配置spark.sql.catalogImplementation=hive,不再需要在代码中配置spark.hadoop.odps.project.name,spark.hadoop.odps.access.id,spark.hadoop.odps.access.key,spark.hadoop.odps.end.point这几个参数

只要在代码的resources目录下(类加载器能加载的目录)创建一个名为odps.conf的文件,然后添加以下配置,注意在集群模式中需要将该文件删除:

odps.project.name=***

odps.access.id=***

odps.access.key=***

odps.end.point=***

此回答整理自钉群“MaxCompute开发者社区1群”

MaxCompute(原ODPS)是一项面向分析的大数据计算服务,它以Serverless架构提供快速、全托管的在线数据仓库服务,消除传统数据平台在资源扩展性和弹性方面的限制,最小化用户运维投入,使您经济并高效的分析处理海量数据。