flink cdc 支持kafka ogg json 格式吗?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

Flink CDC 当前不直接支持从 Kafka、OGG(Oracle GoldenGate)或 JSON 格式中读取数据。然而,你可以结合其他的组件和解决方案来实现这些功能。

对于从 Kafka 中读取数据,你可以使用 Flink 提供的 Kafka Connector。该连接器可用于将 Kafka 主题中的数据流导入到 Flink 中进行处理。你可以根据需要配置连接器以适应特定的数据格式。

关于 OGG 数据和 JSON 格式,你可以考虑以下两种方式:

自定义解析:使用 Flink 的 DataStream API 或 Table API,编写自定义的解析逻辑来处理 OGG 数据和 JSON 格式。你可以通过实现自定义的 DeserializationSchema 或使用相应的库来解析和转换数据。

集成外部解析工具:将外部的解析工具集成到 Flink 中。例如,你可以使用 OGG 提供的解析工具来捕获 OGG 数据,并将其发送到 Flink 中进行进一步处理。对于 JSON 格式,你可以使用 Flink 的 JsonTableSource 或第三方库,如 Jackson 或 Gson,来解析和操作 JSON 数据。

在 Flink CDC 中,可以使用 Kafka Connect 连接器来读取 Kafka 中的 JSON 格式数据,并将其转换为 Flink 数据流进行处理。Kafka Connect 是 Kafka 生态系统中的一个开源组件,可以用于构建可扩展、高吞吐量的数据管道,支持从各种数据源读取数据并将其写入 Kafka,或者从 Kafka 中读取数据并将其写入各种数据源。

如果您的数据源是使用 Oracle GoldenGate(OGG)进行数据同步,并且将数据写入 Kafka 中,可以考虑使用 Kafka Connect 连接器来读取 JSON 格式的数据。Kafka Connect 提供了多种连接器,可以用于连接不同类型的数据源,例如 JDBC Connector、Debezium Connector、Confluent Connector 等。

其中,Debezium Connector 是一个开源的、支持多种数据库的连接器,可以连接到 MySQL、PostgreSQL、MongoDB 等数据库,并将数据变更事件转换为 Kafka 消息进行传输。通过使用 Debezium Connector,可以将 Oracle GoldenGate 同步到 Kafka,并将其转换为 JSON 格式的数据,供 Flink CDC 进行处理。

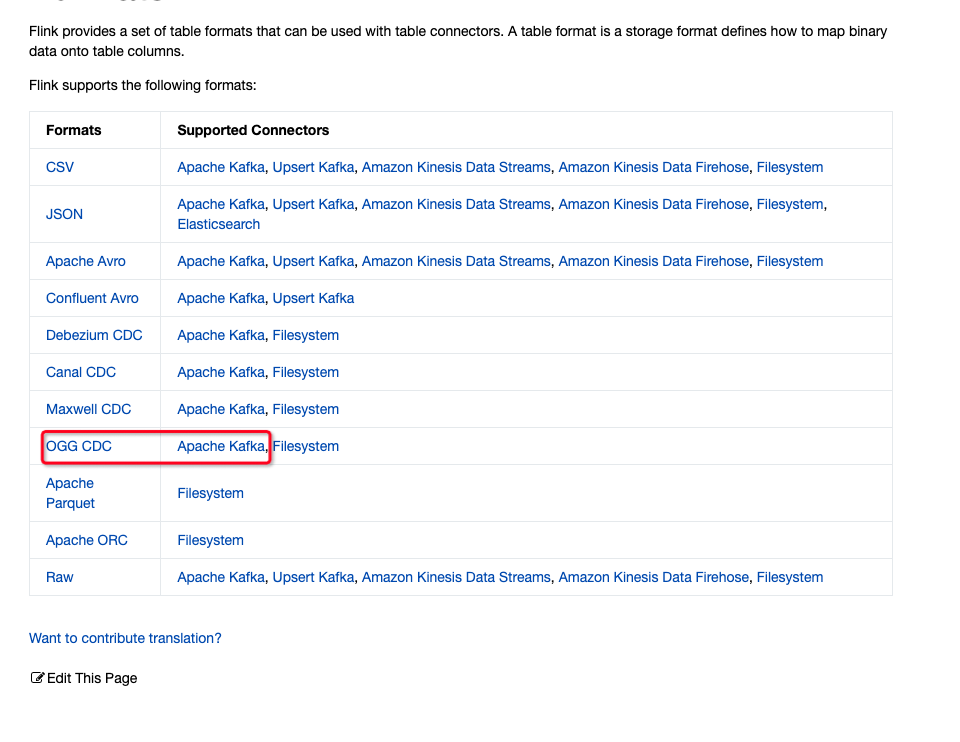

"这和cdc没关系,你直接用flink接入kafka,用ogg 格式解析数据。

https://nightlies.apache.org/flink/flink-docs-release-1.17/docs/connectors/table/formats/ogg/

此回答整理至钉群“Flink CDC 社区”。"

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。