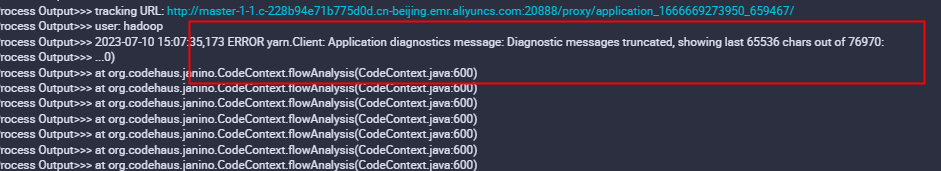

DataWorks我拖了一个spark sql节点,写了sql 报这个错误 啥原因?sql有字数限制吗?

emr spark我调啥参数?我看上面没啥参数可调 并且百度也没得资料

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

一个节点的SQL语句最多可以包含65535个字符,如果超过该限制,就会报出类似于“超出最大长度”的错误。

如果您遇到了这个问题,可以尝试以下解决方法:

将SQL语句拆分成多个节点,分别执行。将原本单节点的SQL语句拆分成多个节点,每个节点只处理部分数据,可以避免SQL语句过长的问题。

缩短SQL语句的长度。可以通过简化SQL语句、去除不必要的空格等方式来减少SQL语句的长度。

使用其他节点类型。如果SQL语句过长,可以尝试使用其他节点类型(如PyODPS、Data Integration等)来处理数据。

SQL语句的长度通常是有限制的,不同的数据库或工具可能具有不同的限制。但在大多数常见的关系型数据库系统中,SQL语句的长度一般是有上限的。

对于DataWorks中的Spark SQL节点,SQL语句的长度限制取决于Spark的配置和执行环境。Spark本身没有严格的SQL语句长度限制,但是由于内存和计算资源的限制,过长的SQL语句可能会导致内存溢出或计算失败。

当你在DataWorks的Spark SQL节点中遇到错误时,可能有以下几个原因导致:

SQL语句超过了Spark执行环境的限制,导致内存溢出或计算失败。这种情况下,你可以尝试优化SQL语句,减少数据量或使用分批处理等方式来解决。

SQL语法错误或逻辑错误。检查SQL语句是否符合正确的语法规则,并确保逻辑正确。

数据库连接问题。如果你在SQL语句中引用了外部数据库表或视图,确保数据库连接配置正确,并且数据库服务器正常运行。

DataWorks基于MaxCompute/Hologres/EMR/CDP等大数据引擎,为数据仓库/数据湖/湖仓一体等解决方案提供统一的全链路大数据开发治理平台。