Flink CDC中sink 到 ck 报这个错?有用过这个驱动的老师吗 ?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

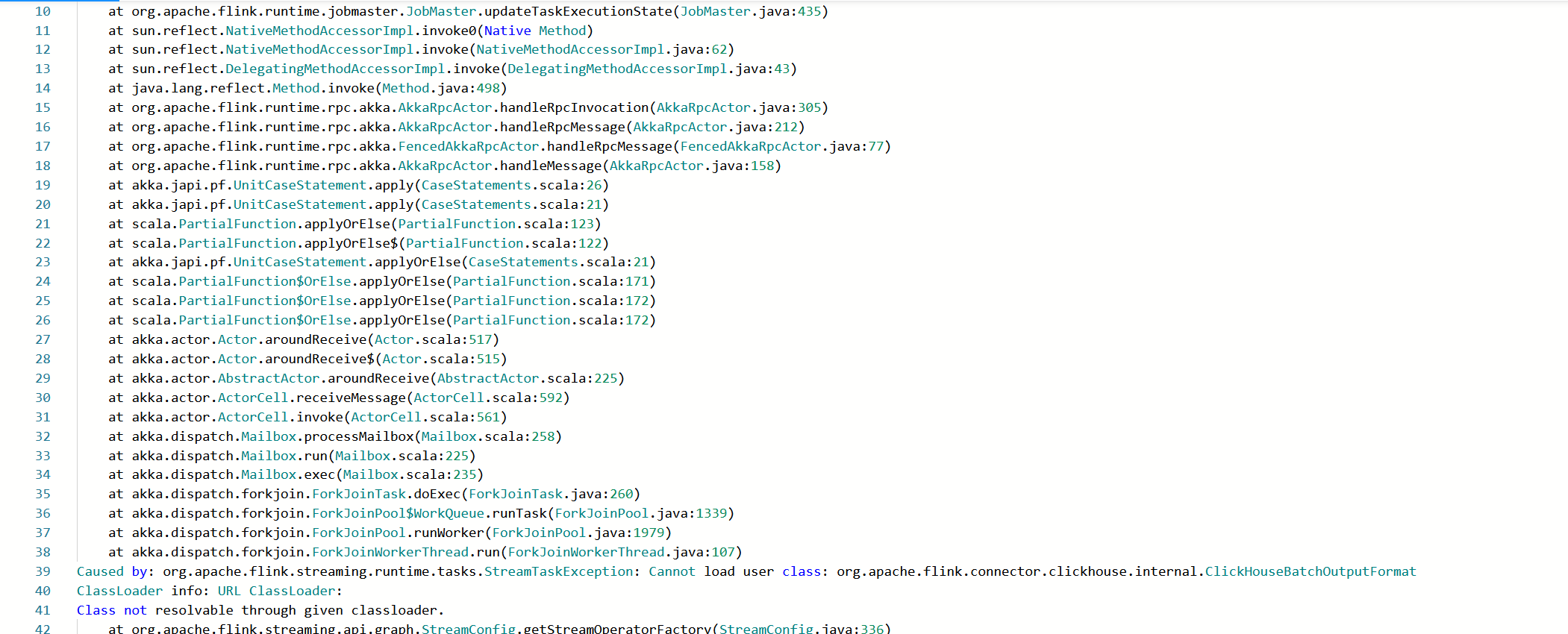

在使用Flink CDC将数据Sink到ClickHouse(CK)时,如果遇到报错,可能是由于配置不当、驱动问题或数据格式不匹配等原因导致的。以下是针对该问题的详细分析和解决方案:

根据知识库中的相关资料,以下是一些可能导致Sink到ClickHouse失败的原因: - 驱动版本不兼容:Flink CDC与ClickHouse的JDBC驱动可能存在版本不匹配的问题。 - 数据格式不匹配:ClickHouse对数据格式有严格要求,例如字段类型、分隔符等。如果Sink的数据格式不符合ClickHouse的要求,可能会导致写入失败。 - 连接参数配置错误:ClickHouse的连接参数(如sink.buffer-flush.max-rows、sink.buffer-flush.interval等)未正确设置,可能导致数据写入异常。 - 权限问题:用于连接ClickHouse的用户可能缺少必要的写入权限。

确保使用的ClickHouse JDBC驱动版本与Flink CDC版本兼容。建议使用最新稳定版本的驱动,并在Flink作业中显式指定驱动依赖。例如:

<dependency>

<groupId>com.clickhouse</groupId>

<artifactId>clickhouse-jdbc</artifactId>

<version>0.3.2</version>

</dependency>

如果使用的是Flink SQL CLI模式,请确保驱动已正确加载到Flink的lib目录中。

根据知识库中的JDBC文档,以下是一些关键的ClickHouse Sink配置项及其说明: - sink.buffer-flush.max-rows:控制每次批量写入的最大行数,默认值为100。如果数据量较大,可以适当调高该值以提高性能。 - sink.buffer-flush.interval:控制数据缓存的时间间隔,默认值为1秒。如果需要实时性较高的写入,可以将其设置为较小值。 - sink.max-retries:写入失败后的最大重试次数,默认值为3。可以根据实际需求调整。

示例配置如下:

CREATE TEMPORARY TABLE ck_sink (

id BIGINT,

name STRING,

age INT

) WITH (

'connector' = 'jdbc',

'url' = 'jdbc:clickhouse://<host>:8123/<database>',

'table-name' = '<table_name>',

'username' = '<username>',

'password' = '<password>',

'sink.buffer-flush.max-rows' = '500',

'sink.buffer-flush.interval' = '2s',

'sink.max-retries' = '5'

);

ClickHouse对数据格式有严格要求,尤其是字段类型和分隔符。如果使用CSV格式写入数据,请确保以下参数正确配置:

sink.properties.format='csv'

sink.properties.column_separator=','

sink.properties.line_delimiter='\n'

如果使用JSON格式写入数据,则需配置:

sink.properties.format='json'

确保用于连接ClickHouse的用户具有写入目标表的权限。可以通过以下SQL语句检查并授予权限:

-- 检查用户权限

SHOW GRANTS FOR '<username>';

-- 授予写入权限

GRANT INSERT ON <database>.<table_name> TO '<username>';

如果上述步骤仍无法解决问题,建议启用Flink的调试日志,查看具体的错误信息。可以在flink-conf.yaml中添加以下配置:

logger.level: DEBUG

通过日志分析,定位具体的报错原因。

table.exec.sink.keyed-shuffle参数,确保相同主键的数据被发送到同一个并发节点。sink.label-prefix参数,以确保Stream Load的唯一性。以下是一个完整的Flink CDC Sink到ClickHouse的示例代码:

-- 源表(MySQL CDC)

CREATE TEMPORARY TABLE mysql_source (

id BIGINT,

name STRING,

age INT

) WITH (

'connector' = 'mysql-cdc',

'hostname' = '<mysql_host>',

'port' = '3306',

'username' = '<mysql_username>',

'password' = '<mysql_password>',

'database-name' = '<database>',

'table-name' = '<table_name>'

);

-- 结果表(ClickHouse)

CREATE TEMPORARY TABLE ck_sink (

id BIGINT,

name STRING,

age INT

) WITH (

'connector' = 'jdbc',

'url' = 'jdbc:clickhouse://<ck_host>:8123/<database>',

'table-name' = '<table_name>',

'username' = '<ck_username>',

'password' = '<ck_password>',

'sink.buffer-flush.max-rows' = '500',

'sink.buffer-flush.interval' = '2s',

'sink.max-retries' = '5'

);

-- 数据写入

INSERT INTO ck_sink SELECT * FROM mysql_source;

通过以上步骤,您可以逐步排查并解决Flink CDC Sink到ClickHouse的报错问题。如果仍有疑问,请提供具体的报错信息以便进一步分析。