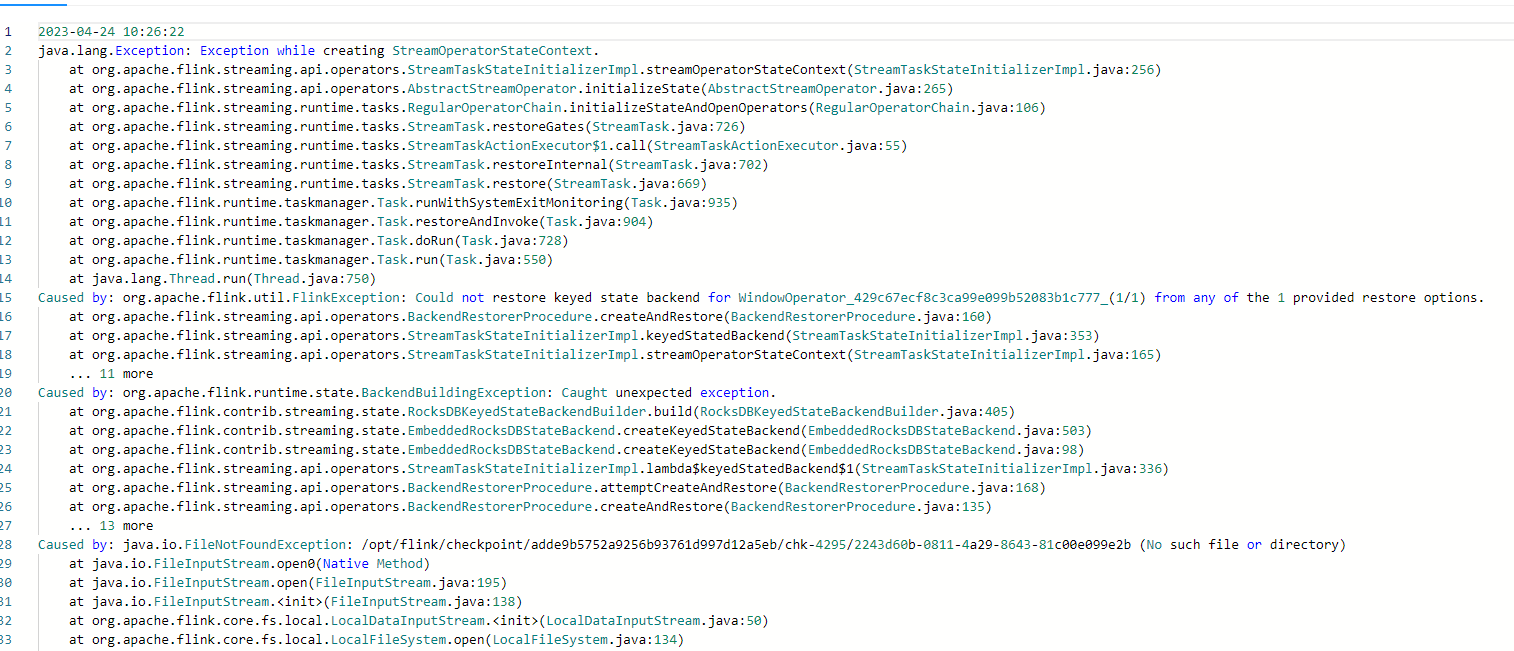

请问下,Flink CDC中我用checkpoint恢复任务,为什么会报这异常呀?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在Flink CDC中,使用checkpoint恢复任务时遇到异常,可能的原因有几种情况:

Resume Token无效:当从Checkpoint恢复时,Flink会使用Change Stream的Resume Token来继续读取MongoDB的变更事件。如果该Resume Token对应的记录在oplog.rs(MongoDB变更日志集合)中不存在,这通常是因为oplog.rs的集合大小有限,导致旧的变更记录被滚动删除。此时,您需要设置一个合适的oplog.rs大小,以确保在期望的恢复时间范围内保留足够的变更日志。

表结构变动:对于某些数据源,如Hologres Binlog,在作业从Checkpoint恢复过程中,如果源表的结构或标识(如table id)发生了变化,可能会导致恢复失败。例如,如果执行了TRUNCATE或重建表操作,即使在VVR 8.0.9及以上版本中取消了table id的强制检查,仍然可能导致数据不一致的问题,因为新表的消费位点与旧表不匹配。

配置不匹配:恢复时使用的连接参数或环境与创建Checkpoint时不同,比如MongoDB CDC中用户名密码错误或未正确指定用户凭证所在的数据库,也可能导致恢复任务失败。

解决步骤包括:

检查Oplog大小:确保MongoDB的oplog.rs足够大,能够保存从上次Checkpoint到当前的所有变更记录。

验证表结构:确认没有对源表进行过影响其结构或标识的操作,或者在进行此类操作后重新初始化作业而不要尝试直接从老的Checkpoint恢复。

核对连接配置:复查所有连接相关的配置,确保用户名、密码以及任何特定于连接的选项(如authSource)与Checkpoint创建时完全一致。

更新依赖或版本:如果问题与已知的软件版本缺陷相关,考虑升级到推荐的版本,比如针对Hologres Binlog源的VVR 8.0.9版本以上。

通过上述排查和调整,应能解决使用Checkpoint恢复Flink CDC任务时遇到的异常情况。如果问题依旧,请查阅更详细的官方文档或联系技术支持获取进一步帮助。