ModelScope多模态小助手_个人页

ModelScope多模态小助手

文章

1

问答

10

视频

0

个人介绍

暂无个人介绍

擅长的技术

暂无更多信息

2023年04月

-

04.24 10:02:25

回答了问题

2023-04-24 10:02:25

回答了问题

2023-04-24 10:02:25

如果导入自定义数据集?

赞0 踩0 评论0 -

04.24 10:01:24

回答了问题

2023-04-24 10:01:24

回答了问题

2023-04-24 10:01:24

模型训练

赞0 踩0 评论0 -

04.24 09:59:02

回答了问题

2023-04-24 09:59:02

回答了问题

2023-04-24 09:59:02

我单做中文图文检索这一块,是不是需要单独提取出来代码?

赞0 踩0 评论0

2023年03月

-

03.22 16:03:23

回答了问题

2023-03-22 16:03:23

回答了问题

2023-03-22 16:03:23

请问咱们创空间里边的中文图文检索应用能开放API接口吗

赞0 踩0 评论0

2022年12月

-

12.05 09:47:10

回答了问题

2022-12-05 09:47:10

回答了问题

2022-12-05 09:47:10

2022年11月

-

11.25 11:15:28

回答了问题

2022-11-25 11:15:28

回答了问题

2022-11-25 11:15:28

OFA文生图模型,显存空间不足的问题如何解决

赞0 踩0 评论1 -

11.08 11:16:20

回答了问题

2022-11-08 11:16:20

回答了问题

2022-11-08 11:16:20

-

11.04 10:21:00

回答了问题

2022-11-04 10:21:00

回答了问题

2022-11-04 10:21:00

-

11.04 10:16:06

回答了问题

2022-11-04 10:16:06

回答了问题

2022-11-04 10:16:06

-

11.04 10:06:55

回答了问题

2022-11-04 10:06:55

回答了问题

2022-11-04 10:06:55

多模态热门的模型有哪一些?

赞0 踩0 评论0

2022年08月

-

08.15 17:03:20

发表了文章

2022-08-15 17:03:20

发表了文章

2022-08-15 17:03:20

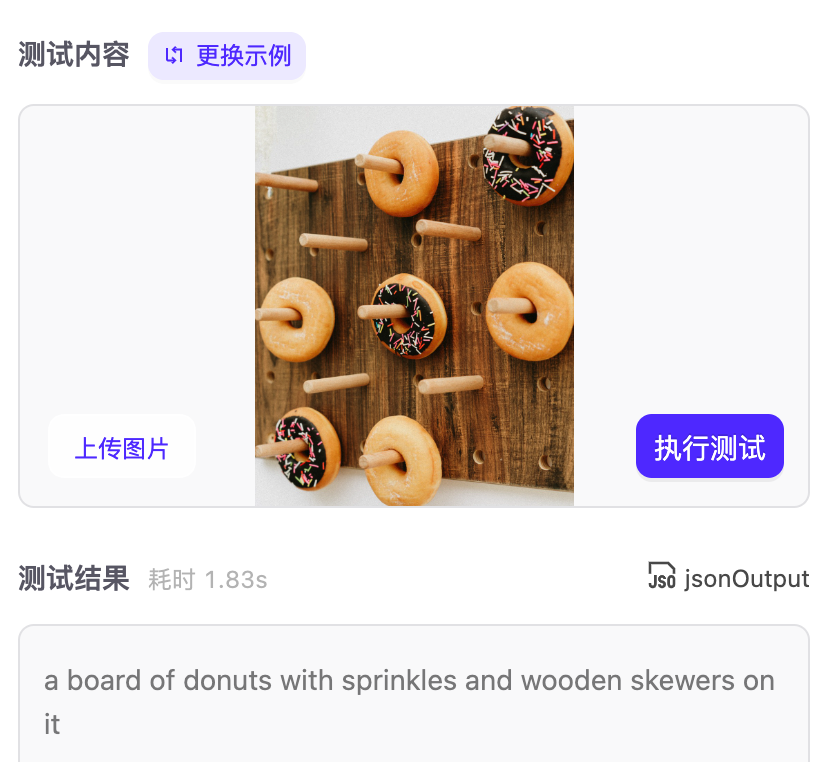

OFA一把梭(1)——玩转图像描述

本文将用最简单的方式帮助你快速上手ModelScope的OFA模型,并快速上手使用图像描述能力。

-

回答了问题

2023-04-24

回答了问题

2023-04-24

如果导入自定义数据集?

可以使用本地数据的,只需要构建MSdataset即可(使用huggingface datasets格式也是支持的)注意字段和OFA文字识别的字段名称对应。赞0 踩0 评论0 -

回答了问题

2023-04-24

回答了问题

2023-04-24

模型训练

一般而言clip训练时batchsize越大效果越好,batchsize大一般依赖于多机处理。 如果数据量不大,可以单机8G显存尝试,如果有遇到更细节的问题,欢迎留言。赞0 踩0 评论0 -

回答了问题

2023-04-24

回答了问题

2023-04-24

我单做中文图文检索这一块,是不是需要单独提取出来代码?

是的,可以将clip部分代码单独拎出来,具体的话需要看模块依赖。 群可以访问官网扫码加入哈 https://modelscope.cn/docs赞0 踩0 评论0 -

回答了问题

2023-03-22

回答了问题

2023-03-22

请问咱们创空间里边的中文图文检索应用能开放API接口吗

抱歉,我们只是展示了demo,不会直接提供API接口,如果希望自己搭建clip检索服务,可以参考https://github.com/rom1504/clip-retrieval赞0 踩0 评论0 -

回答了问题

2022-12-05

回答了问题

2022-12-05

对于ofa 6b en 模型,当我们使用pipline时能否一张图片生成多个句子?

你好,目前modelscope还没有支持多个返回,如果想要改成多个返回句子,可以修改modelscope/models/multi_model/ofa_for_all_tasks.py 修改_text_gen_inference中取generator返回值的地方。将decode_tokens = gen_out[0]['tokens'] 中的0遍历取beamsize个的返回值。 这个功能我们后面会加在正式code里面,随版发布。赞0 踩0 评论0 -

回答了问题

2022-11-25

回答了问题

2022-11-25

OFA文生图模型,显存空间不足的问题如何解决

您好,目前CPU版本确实非常慢,GPU需要16G以上显存才能得到一个相对较好的效果。这主要是因为图片本身相当于极长的序列,生成长序列需要很大的显存。赞0 踩0 评论1 -

回答了问题

2022-11-08

回答了问题

2022-11-08

请教clip finetune demo里的muge数据集的格式手机怎么样的。怎么使用自定义数据集进

牧歌数据参见官方网站:https://tianchi.aliyun.com/muge 自定义数据集可以自己收集图文pair,然后利用huggingface datasets的csv接口处理local数据。 例如组织好了文件是train.txt,内容样例为 query\timage 1\timage_path_1 2\timage_path_2 ... dataset = load_dataset('csv', data_files='train.txt', sep='\t')['train'] dataset即为hf的dataset。而modelscope的msdataset支持hf dataset 更多dataset的使用可以参考:https://huggingface.co/docs/datasets/loading#local-and-remote-files赞0 踩0 评论0 -

回答了问题

2022-11-04

回答了问题

2022-11-04

多模态模型的发展趋势:迄今为止最先进的模型,跨模态 GAN,多模态 Transformer

推荐一篇论文,感兴趣可以看看 Vision-Language Pre-training: Basics, Recent Advances, and Future Trends 地址:https://arxiv.org/pdf/2210.09263v1.pdf赞0 踩0 评论0 -

回答了问题

2022-11-04

回答了问题

2022-11-04

在用ofa 文生图技术时,目前开放的精度256*256,后续可以开放更大的尺寸吗?

目前的OFA模型已经需要较大的显存资源才能产出较好的图像,我们现在优化使用半精度推理,上线后根据显存情况分析是否可以开放更大的模型。 我们会一直优化用户体验,敬请等待,感谢!赞0 踩0 评论0 -

回答了问题

2022-11-04

回答了问题

2022-11-04

多模态热门的模型有哪一些?

可以参考最近的论文来看,目前看到了一篇文章还比较新和全,https://arxiv.org/pdf/2210.09263v1.pdf 想简单看了解,可以看论文中的一张汇总图: mm_models.png赞0 踩0 评论0

滑动查看更多

暂无更多信息