《阿里云产品四月刊》—一文解读:阿里云 AI 基础设施的演进与挑战(3)https://developer.aliyun.com/article/1554149

如何释放云上性能?

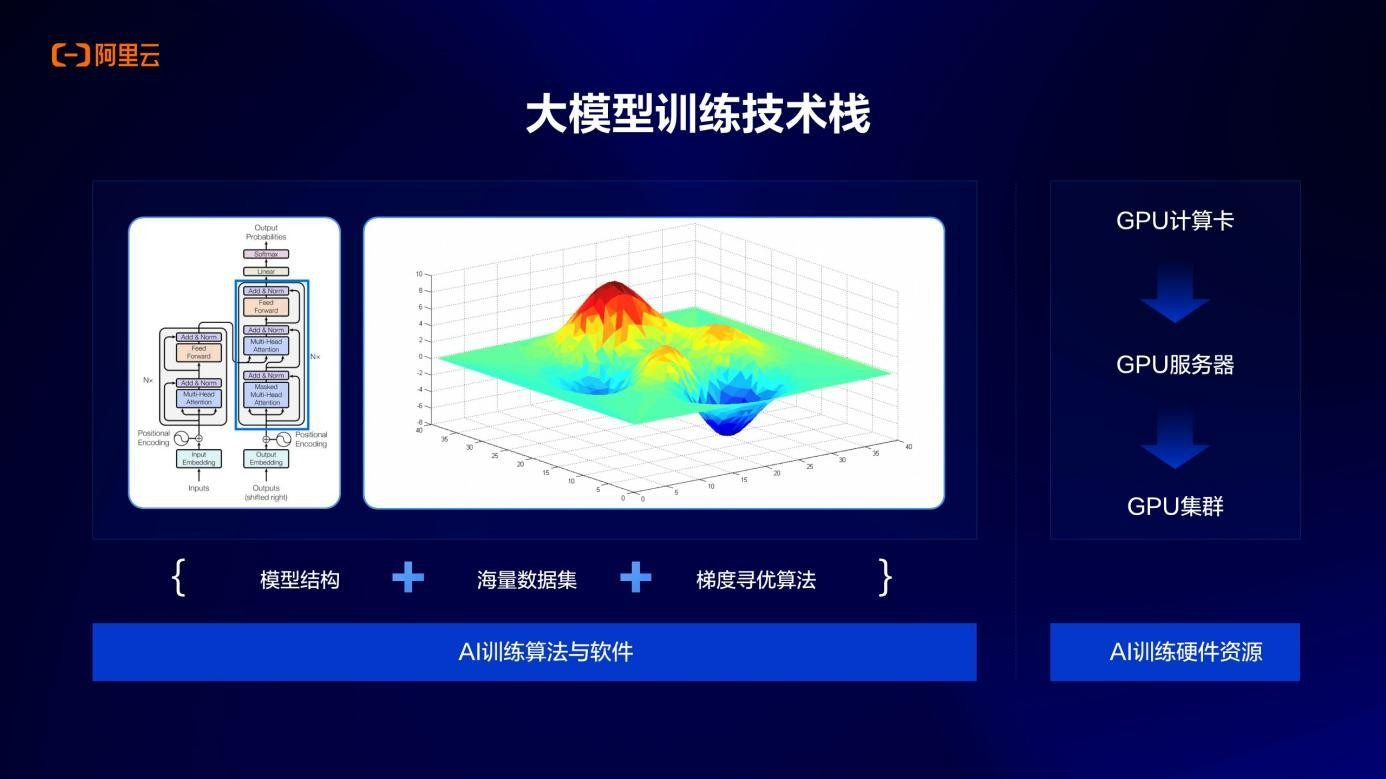

对于大模型训练的技术栈,由 AI 训练算法与软件、Ai 训练硬件资源两个部分构成。

当前,主要是模型结构(主要是 Transformer 结构)、海量级数据以及梯度寻优算法, 这三块构成 AI 训练的软件和算法。

AI 硬件就是 GPU 的计算卡,从单卡扩展到服务器(如 8 卡),再扩展到更大的服务器集群,做成千卡/万卡的规模,构成整个大模型训练硬件的计算资源。

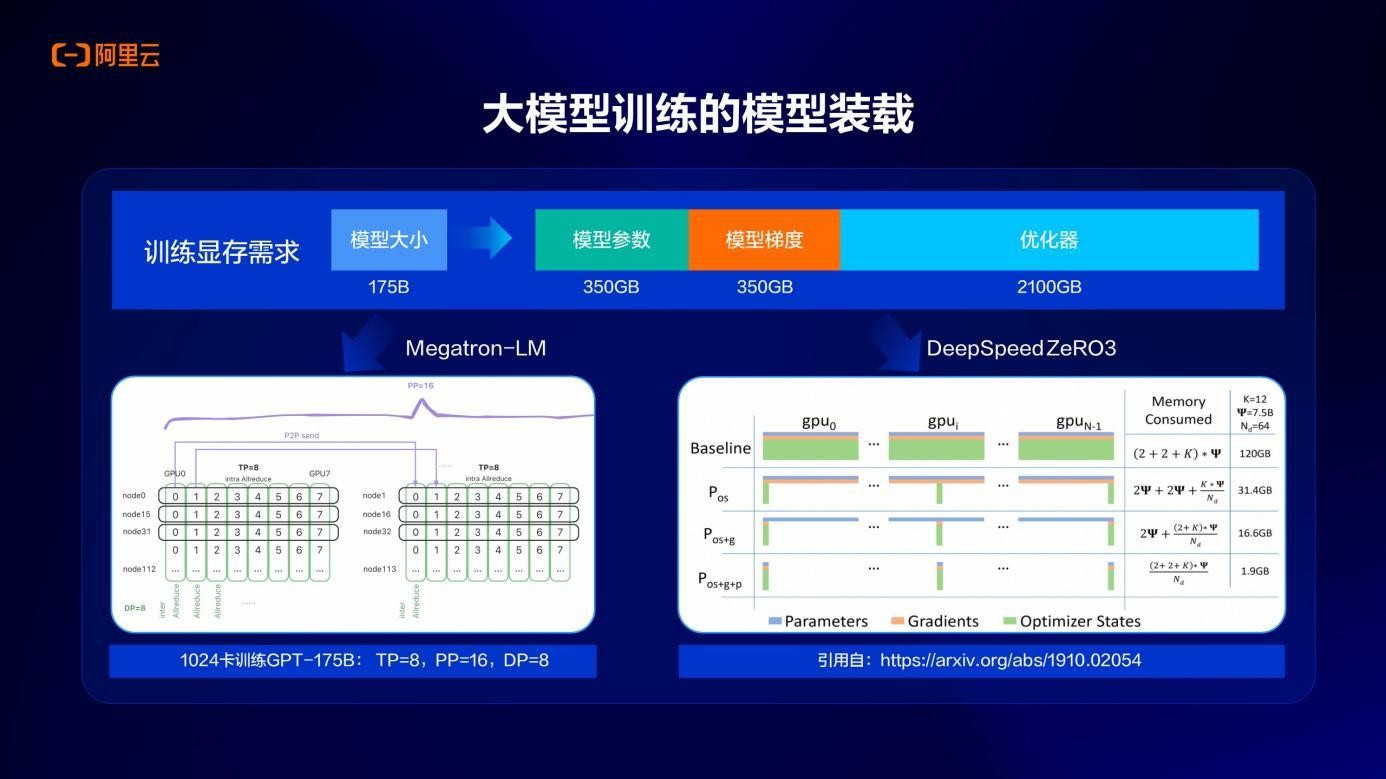

大模型训练过程中有一个典型的现实问题:模型的加载和并行。以 GPT 175B 的模型举例来说,它需要的显存规模就训练来说大概需要 2800G,上图是以 A100 80G 为例,要解决的问题是我们需要多少张卡装载这个模型,装载模型后还需要如何去把训练效率提 升,这就需要用模型并行技术来解决。

另外,还有互联的问题,互联有单机内部互联(NVlink),还有机器与机器之间的互联 网络,这对于分布式训练来说非常重要,因为会在通信上产生一些开销。

《阿里云产品四月刊》—一文解读:阿里云 AI 基础设施的演进与挑战(5)https://developer.aliyun.com/article/1554147