昨天我们聊到了OpenAI公司出品的DALL-E 2模型,可以轻松加愉悦的完成文本到图像的转换。

可技术创新有可能不是螺旋式上升,波浪式前进的,而是飞跃式的。

仅仅一个月之后,卷王Google就推出了自己的文本到图像生成模型,或者叫模型工厂,因为它的实现不仅仅是依赖于一个简单的模型,而是一堆大小模型的组合,Google给它取名叫做 Imagen。

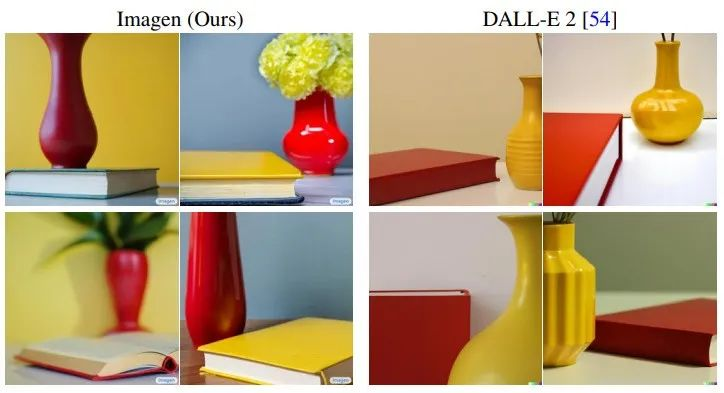

Imagen 一出,就剑指DALL-E 2,Google 的论文《Photorealistic Text-to-Image Diffusion Models with Deep Language Understanding》中就直接给出Imagen 吊打 DALL-E 2的例子。

Imagen V.S. DALL-E 2

下面从几个角度看看,Imagen是如何吊打DALL-E 2的。

颜色分类

(一个黄色的书和一个红色的花瓶)

评:文本描述是,一个黄色的书和一个红色的花瓶,看来 DALL-E 2 确实把颜色搞反了。

容易让人误解的文字描述:英文文本理解

评:

A couple of glasses are sitting on a table. 英语过了6级的我,对这句话的翻译也懵懵的。A couple of glasses 到底应该翻译为一对玻璃杯还是一副眼镜?

查了查资料才明白,原来,a couple of glasses 既可以翻译为一副眼镜,也可以翻译为一对玻璃杯,关键在于动词是不是复数。注意这里用的是 are, 很显然,正确翻译是一对玻璃杯。而 DALL-E 2 中却有的图片生成出现了眼镜。

Imagen 更胜一筹。

文本位置展示

评:这个例子是希望在纽约天际上空,出现Hello World字样,并且伴有烟花。DALL-E 2 很明显出现了几处 Hellow world 的错误文本。此处Imagen又胜出。

除此之外,论文中还列举了很多例子,不多赘述。

Google凭借 Imagen 的出色发挥,可以说直接吊打了 DALL-E 2,并且顺便碾压了下另一个模型GLIDE。

总结下来就是一句话。

Google借着这篇论文,向其他文本-图像模型说了句:你们都是弟弟。

伦理问题

遥想2013年,快播兴盛至极,风头一时无两。几乎每个电脑的桌面上,都能看到一个红色圆圈的标志。

可突然之间,快播被禁,创始人被抓,锒铛入狱,只留下一句互联网上流传至今的名言:“技术是无罪的。”

没错,技术无罪。

但被滥用了,创始人就被抓了。

Imagen 同样面临这个问题。

你能想象一个人对着模型说。

嘿,给我生成一张吴某某的绯闻照片。

或者更细节的,生成一张吴某某和谁谁谁在哪里,干什么的照片。

想起了死亡笔记。虽然不至于致人身亡,即使莫须有的照片,但社会影响,足以让一个奋斗多年的人,身败名裂。造假的代价太小,而影响太大。

很显然,Google意识到了这个问题。

如果对文本描述不加限制,对图像生成不加限制。最终生成一些越来越真实并且带有社会危害性的图片,那不是Google想看到的。

于是,Google很聪明,做了一些声明。

首先,文本-图像的使用场景多种多样,并且很可能会影响社会,潜在的风险会让人们批判这个项目,因此决定不进行开源和在公开场合进行功能演示。

其次,文本-图像的生成需求,会导致大量各行业从业人员严重依赖AI模型和数据。同时,训练Imagen需要涉及到大量的数据集,包括色情图像、种族主义诽谤和有害的社会刻板印象等相关文件,会进一步增加模型和公众使用的风险,所以决定Imagen不对公众开放。

最后,文本-图像的评估方法还需要进一步研究,以消除社会和文化偏见。

声明的很好,我们的技术很牛,但我们不对外开放。

什么时候解决了社会伦理问题,我们再考虑公开。

One More Thing

《三体2:黑暗森林》中有一个画面。

当三体舰队到达地球时,所有的人类科技在三体文明面前都是渣渣,人类存亡危在旦夕。罗辑站在自己的坟墓前,拿着手枪,对着自己的脑袋,向三体人喊到:“我要和三体人通话。”

...

罗辑赢了,不费一颗子弹,利用他的社会宇宙学——黑暗森林法则,开启了人类与三体人共生共存的威慑纪元。

写到这,我意识到。

自然科学的发展与人文社会学的发展应该是相辅相成的。

自然科技发展快了,社会伦理跟不上,需要等一等。

尤其在人工智能,这种到处都有可能面临伦理道德风险的行业。

自然科学发展的再好,也逃脱不了社会伦理人文的约束。曾经的“学好数理化,走遍天下都不怕”的思想,需要审视一下了。

![[译][AI OpenAI] 引入 GPT-4o 及更多工具至免费版 ChatGPT 用户](https://ucc.alicdn.com/pic/developer-ecology/tbo73ymmu5nmu_f91a4c16f5a84cd1bd63cd453fee0efd.png?x-oss-process=image/resize,h_160,m_lfit)

![[译][AI OpenAI] 您好,GPT-4o](https://ucc.alicdn.com/tbo73ymmu5nmu_20240514_a61a0b34c9e247929cc1e63a6ca41350.jpeg?x-oss-process=image/resize,h_160,m_lfit)

![[译][AI OpenAI-doc] 延迟优化](https://ucc.alicdn.com/tbo73ymmu5nmu_20240513_802c2d330d8f44d1bed5bdb43be55cba.png?x-oss-process=image/resize,h_160,m_lfit)

![[译][AI OpenAI-doc] Prompt工程](https://ucc.alicdn.com/pic/developer-ecology/tbo73ymmu5nmu_bf37e439f4ef4ae8a3b43bf68cfe1a62.jpg?x-oss-process=image/resize,h_160,m_lfit)

![[译][AI OpenAI-doc] 迁移指南 Beta](https://ucc.alicdn.com/pic/developer-ecology/tbo73ymmu5nmu_9adde0c2e5074f4aa2b88fd3baba2c64.jpg?x-oss-process=image/resize,h_160,m_lfit)