类目筛选

如何提取手写票据信息

本文主要讲述在处理票据信息结构化提取任务时,如何结合OCR(光学字符识别)技术和多模态大模型Qwen-VL来提高票据信息提取的准确性和效率。

GitLab 国际站中国大陆等地区停服,如何将数据快速迁移到云效

对于正在使用 GitLab 国际站托管代码的企业和研发团队,除迁移至极狐 GitLab 外,国内其他主流的 DevOps 平台也具有完备的产品能力,为开发者提供了更多的选择。其中,阿里云云效也提供了针对常见代码托管平台如 GitHub、GitLab 简单便捷的迁移方案,帮助用户快速完成核心代码数据的迁移,确保代码资产安全。

AI 场景下,函数计算 GPU 实例模型存储最佳实践

当前,函数计算 FC 已被广泛应用在各种 AI 场景下,函数计算支持通过使用容器镜像部署 AI 推理应用,并且提供多种选项来访问训练好的模型。为了帮助开发者高效地在函数计算上部署 AI 推理应用,并快速解决不同场景下的模型存储选型问题,本文将对函数计算的 GPU 模型存储的优缺点及适用场景进行对比分析,以期为您的模型存储决策提供帮助。

进行GPU算力管理

本篇主要简单介绍了在AI时代由‘大参数、大数据、大算力’需求下,对GPU算力管理和分配带来的挑战。以及面对这些挑战,GPU算力需要从单卡算力管理、单机多卡算力管理、多机多卡算力管理等多个方面发展出来的业界通用的技术。

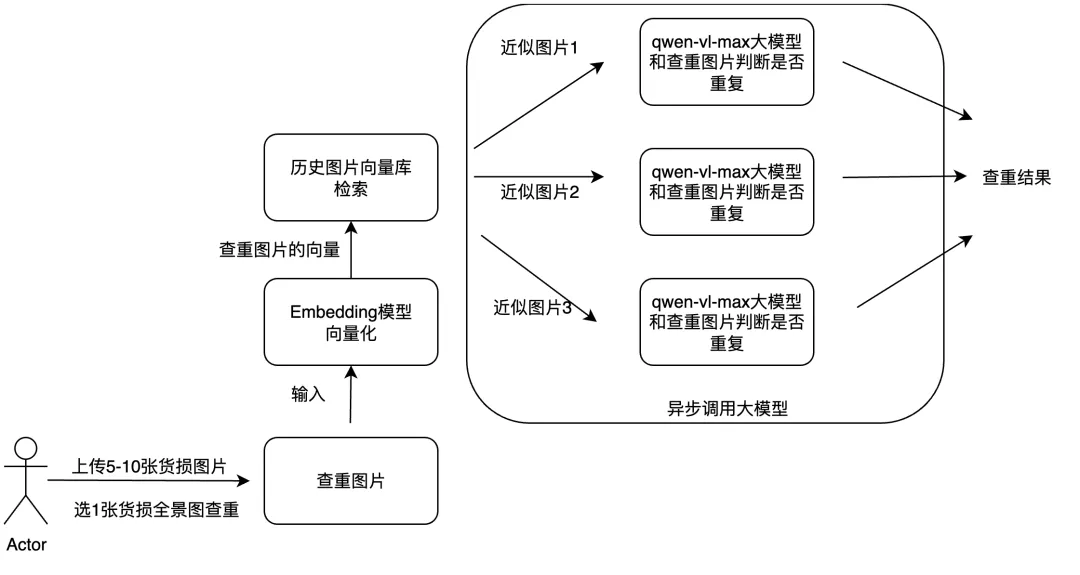

结合多模态RAG和异步调用实现大模型内容

文章探讨了如何利用多模态大模型和工程优化手段提升物流理赔业务效率。核心方案包括:通过多模态RAG技术实现图片查重,结合异步调用方法优化货损识别功能。

AI 时代,为什么编程能力≠ 开发门槛

在 2.0 阶段,我们目标是实现面向任务的协同编码模式,人的主要职责转变为任务的下发、干预以及最后结果的审查。在这个过程中,人的实际工作量开始减轻,AI 工作的占比显著提升。目前的 2.0 版本是我们最近上线的。

StrmVol 存储卷:解锁 K8s 对象存储海量小文件访问性能新高度

本文介绍了阿里云容器服务(ACK)支持的StrmVol存储卷方案,旨在解决Kubernetes环境中海量小文件访问性能瓶颈问题。通过虚拟块设备与内核态文件系统(如EROFS)结合,StrmVol显著降低了小文件访问延迟,适用于AI训练集加载、时序日志分析等场景。其核心优化包括内存预取加速、减少I/O等待、内核态直接读取避免用户态切换开销,以及轻量索引快速初始化。示例中展示了基于Argo Workflows的工作流任务,模拟分布式图像数据集加载,测试结果显示平均处理时间为21秒。StrmVol适合只读场景且OSS端数据无需频繁更新的情况,详细使用方法可参考官方文档。

如何在Anolis OS上轻松使用 Kata 安全容器

本篇文章我们将详细介绍怎么轻松在 Anolis OS 上使用 Kata Containers 安全容器

Spring循环依赖那些事儿(含Spring详细流程图)

本篇不仅仅是介绍Spring循环依赖的原理,而且给出Spring不能支持的循环依赖场景与案例,对其进行详细解析,同时给出解决建议与方案,以后出现此问题可以少走弯路。