类目筛选

2023-11-07

43755

基于阿里云PAI平台搭建知识库检索增强的大模型对话系统

基于原始的阿里云计算平台产技文档,搭建一套基于大模型检索增强答疑机器人。本方案已在阿里云线上多个场景落地,将覆盖阿里云官方答疑群聊、研发答疑机器人、钉钉技术服务助手等。线上工单拦截率提升10+%,答疑采纳率70+%,显著提升答疑效率。

43,755

2024-05-16

57092

容器内存可观测性新视角:WorkingSet 与 PageCache 监控

本文介绍了 Kubernetes 中的容器工作内存(WorkingSet)概念,它用于表示容器内存的实时使用量,尤其是活跃内存。

57,092

2024-09-25

811

新场景、新能力,AI-native 时代的可观测革新

借助 AI-native 可观测解决方案,阿里云为用户提供开箱即用的覆盖大模型应用、大模型到基础设施的全链路实时观测、告警与诊断能力,帮助企业在复杂的数字化转型过程中更有效地确保资源的高效利用与业务的持续成功。

811

2024-11-15

1253

AI经营|多Agent择优生成商品标题

商品标题中关键词的好坏是商品能否被主搜检索到的关键因素,使用大模型自动优化标题成为【AI经营】中的核心能力之一,本文讲述大模型如何帮助商家优化商品素材,提升商品竞争力。

1,253

2024-12-24

1315

探索大型语言模型LLM推理全阶段的JSON格式输出限制方法

本篇文章详细讨论了如何确保大型语言模型(LLMs)输出结构化的JSON格式,这对于提高数据处理的自动化程度和系统的互操作性至关重要。

1,315

2024-12-06

1365

【阅读十分钟,百分百成功】——通过大模型实现对客服回答的质量评估

本文章基于业务实践,总结有关客服质检场景的解决方案和处理经验,为相似场景提供可行的借鉴方法。

1,365

2025-04-03

1870

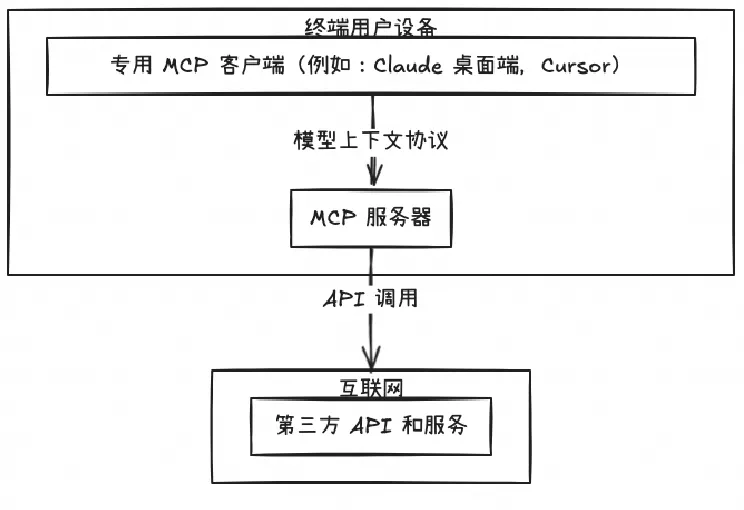

开源 Remote MCP Server 一站式托管来啦!

MCP Server 的实施存在着诸多挑战,特别是在认证授权、服务可靠性和可观测性方面,Higress 作为 AI 原生的 API 网关,提供了完整的开源 MCP Server 托管解决方案,实现存量 API 到 MCP 的协议转换。即将上线的 MCP 市场,将大幅降低开发者构建 MCP Server 的时间和人力成本。

1,870

2025-05-06

1337

MCP 规范新版本特性全景解析与落地实践

MCP Specification 在 2025-03-26 发布了最新的版本,本文对主要的改动进行详细介绍和解释

1,337