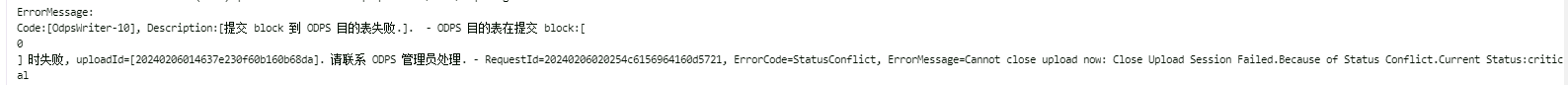

DataWorks这种错误如何优化?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

两种常见的原因 1)小文件过多 2)超过了tunnel session 最长时间24h

可以把tunnelid和地域工单发给maxcompute同学帮忙查一下实际原因,2024-02-06 01:23-02:04左右MC元数据服务出现单机异常 不知道是不是这个原因导致的 可以重跑试一下 ,此回答整理自钉群“DataWorks0群已满,新群请看群公告”

要解决这个问题,可以尝试以下步骤:

检查ODPS目标表是否存在:确保ODPS中存在你正在尝试写入的表。如果不存在,你需要先创建该表。

检查ODPS表结构是否与源数据匹配:确保ODPS表的列名和数据类型与你正在上传的数据相匹配。如果不匹配,你需要调整ODPS表结构或源数据格式。

确保ODPS表有足够的空间:检查ODPS表是否有足够的存储空间来容纳上传的数据。如果没有,你需要清理一些旧数据或者增加存储空间。

尝试重新上传:有时候,网络或其他临时性问题可能会导致上传失败。在这种情况下,你可以尝试稍后重新上传数据。

检查DataWorks任务设置:确保你的DataWorks任务设置正确无误,包括ODPS连接、表名、数据源等。

查看DataWorks日志:查看DataWorks任务的日志,看看是否有其他错误信息或警告可以帮助你定位问题。

调整DataWorks任务执行时间:如果问题是由资源竞争引起的,你可以尝试调整任务的执行时间,避开高峰期。

DataWorks基于MaxCompute/Hologres/EMR/CDP等大数据引擎,为数据仓库/数据湖/湖仓一体等解决方案提供统一的全链路大数据开发治理平台。