FlinkCDC如何保证数据的一致性?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

Apache Flink CDC(Change Data Capture)通过一系列技术和机制来保证数据的一致性:

一致性快照(Snapshotting):

Checkpoint与Savepoint:

精确一次(Exactly-once)处理:

幂等性Sink:

Watermarking与事件时间处理:

综上所述,Flink CDC通过组合上述技术手段,实现了在分布式流处理环境下对数据库变更数据的一致性和完整性保障。不过,是否能达到精确一次语义还取决于上下游系统和中间件的支持程度,以及在整个数据链路中各个组件的配置和协调。

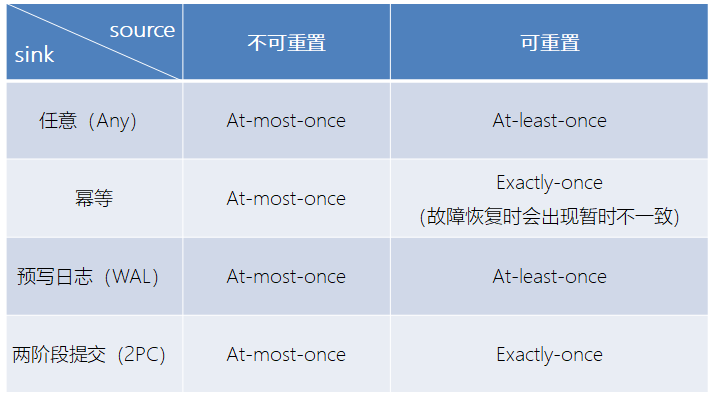

端到端的一致性保证,意味着结果的正确性贯穿了整个流处理应用的始终;每一个组件都保证了它自己的一致性,整个端到端的一致性级别取决于所有组件中一致性最弱的组件。具体可以划分如下:

而对于sink端,又有两种具体的实现方式:幂等(Idempotent)写入和事务性(Transactional)写入。

不同Source和Sink的一致性保证可用下表说明:

——参考链接。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。