dataWorks有一张12亿数据的表,怎么分批导出到csv文件,有什么好的办法吗?全量导出,本地

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

当需要全量导出一张包含12亿数据的表到本地的CSV文件时,一次性导出可能会遇到内存和性能方面的挑战。为了有效地分批导出数据,可以考虑以下方法:

分页查询:使用分页查询的方式逐页获取数据,并将每页的结果写入到CSV文件中。这样可以控制每次查询的数据量,减少内存压力。在每次查询时,在SELECT语句中通过LIMIT和OFFSET子句指定当前页数和每页记录数。

分区导出:如果目标表是分区表,可以按照分区进行导出。先确定每个分区的范围,然后针对每个分区执行导出操作。这样可以将数据拆分为多个较小的文件,简化导出过程。

并行导出:将导出任务分成多个并行的子任务,每个子任务导出部分数据,并行执行。这样可以同时利用多个资源进行导出,加快导出速度。

下载数据。

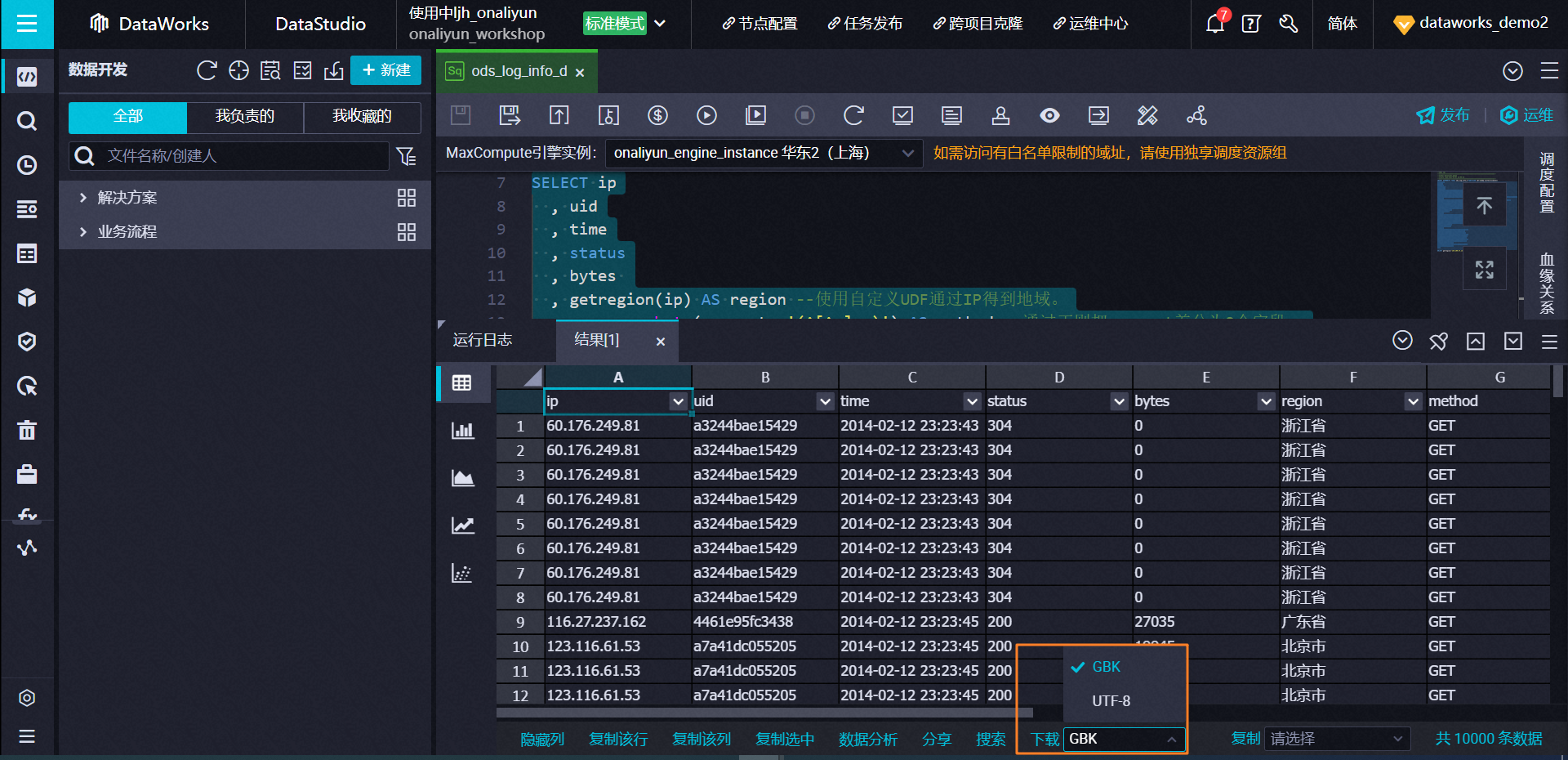

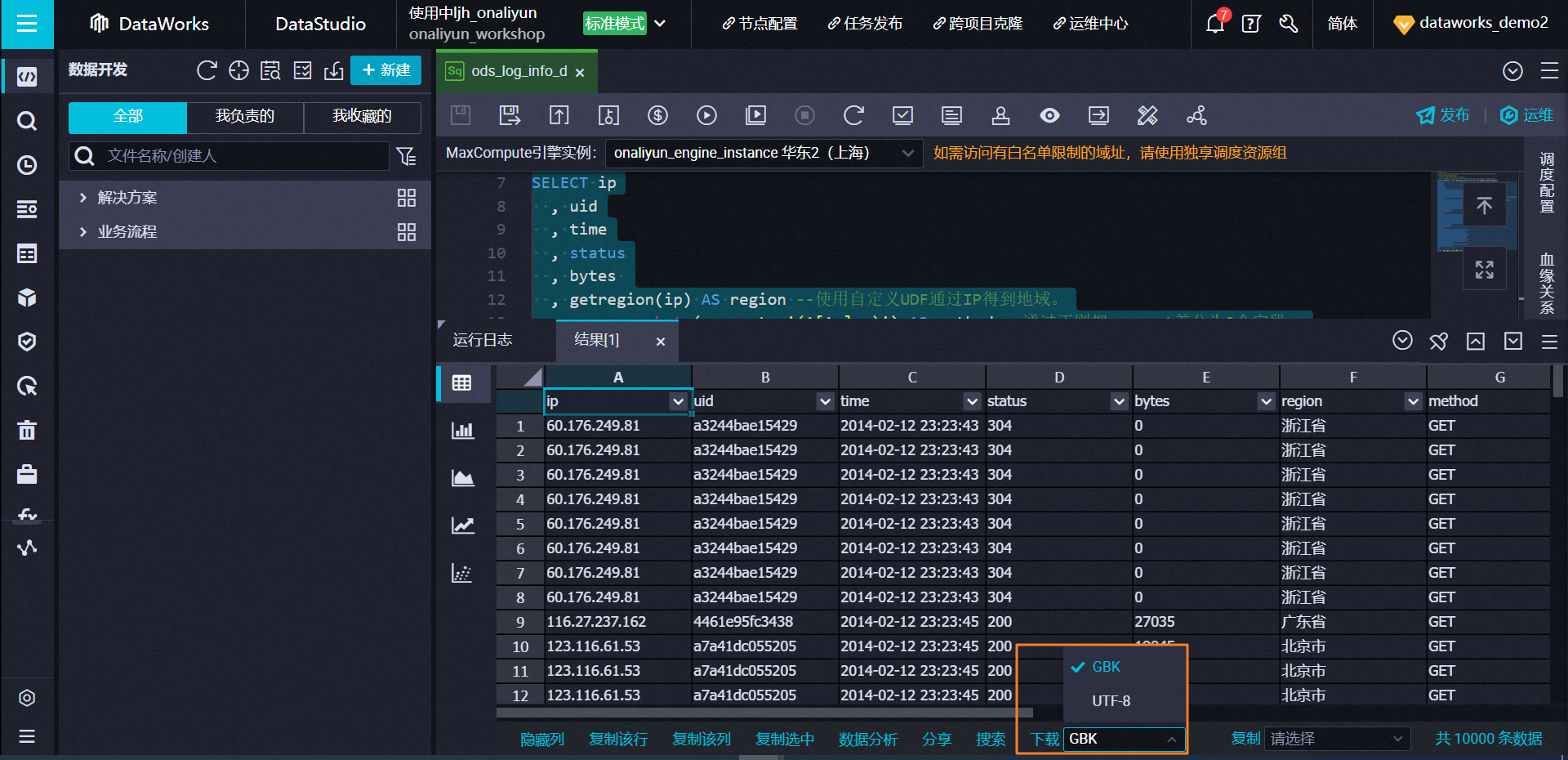

【下载方式一】DataStudio查询结果下载

限制:上限1万条。

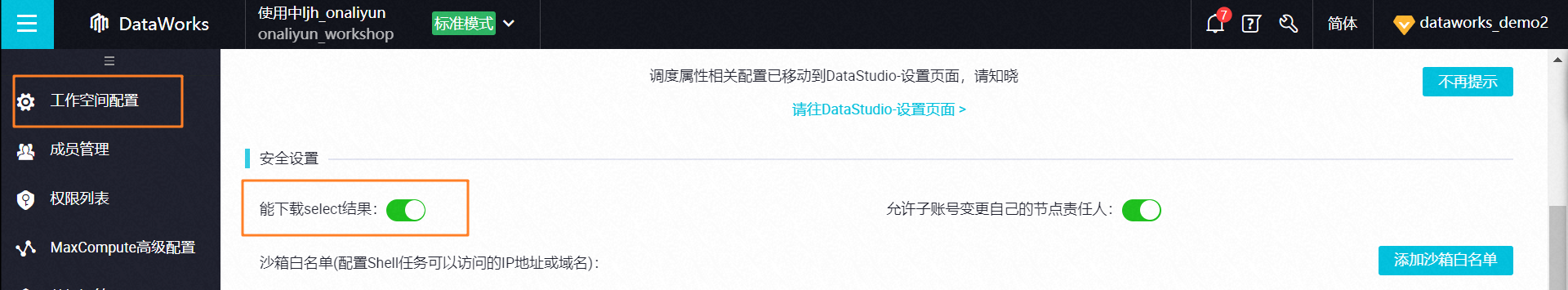

step1:项目管理员角色设置项目开启允许下载。

step2:DataStudio查询结果下载

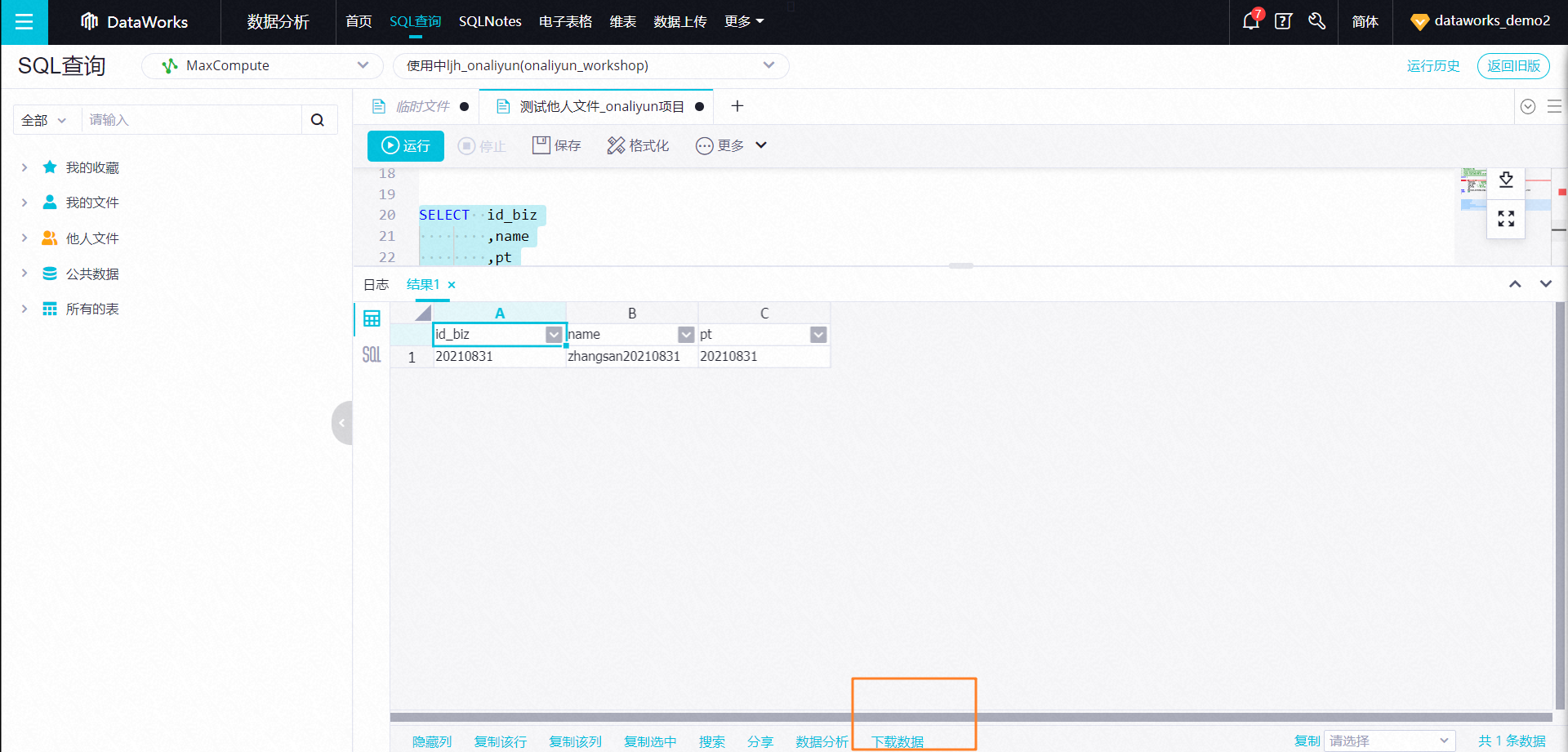

【下载方式二】数据分析查询结果下载

限制:,DataWorks标准版及以上上限20万条,基础版上限1万条。仅阿里云主账号和租户管理员可以访问编辑。

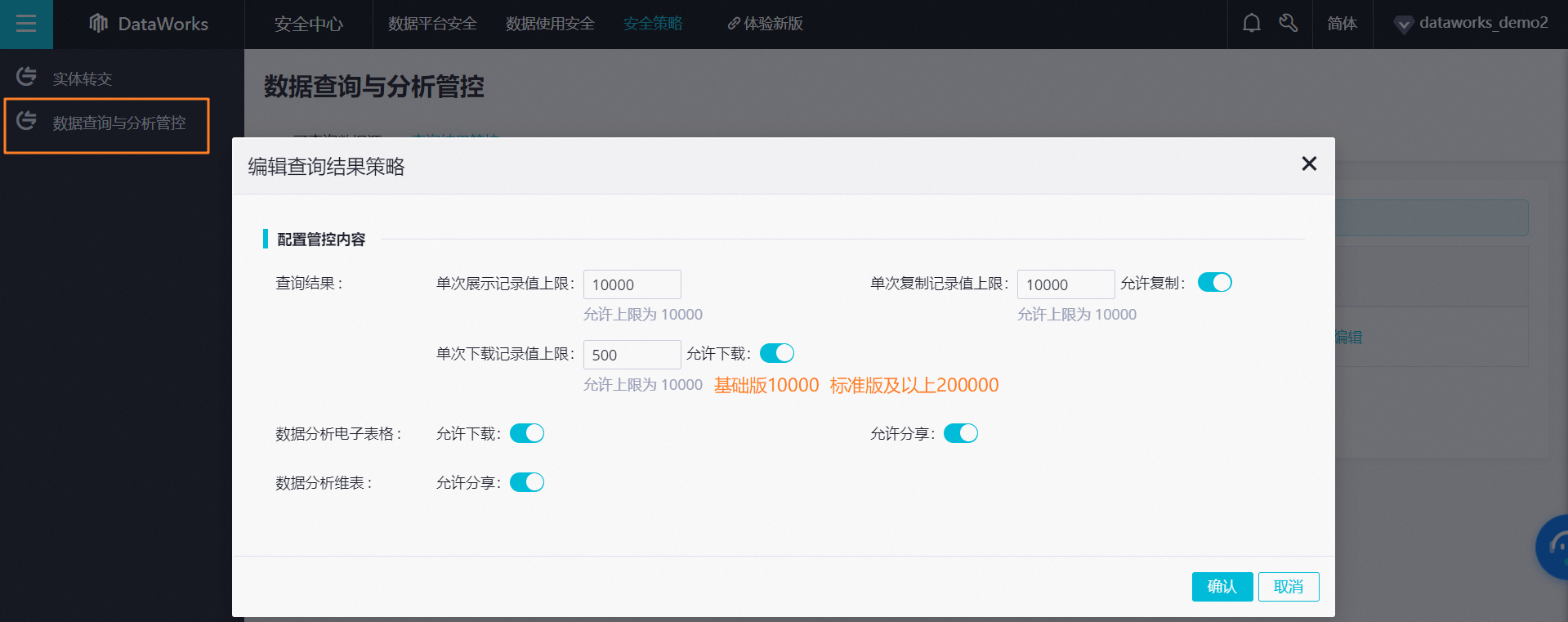

step1:安全中心>安全策略>数据查询与分析管控,开启下载

新版本:

老版本:数据分析-系统管理-设置允许下载。

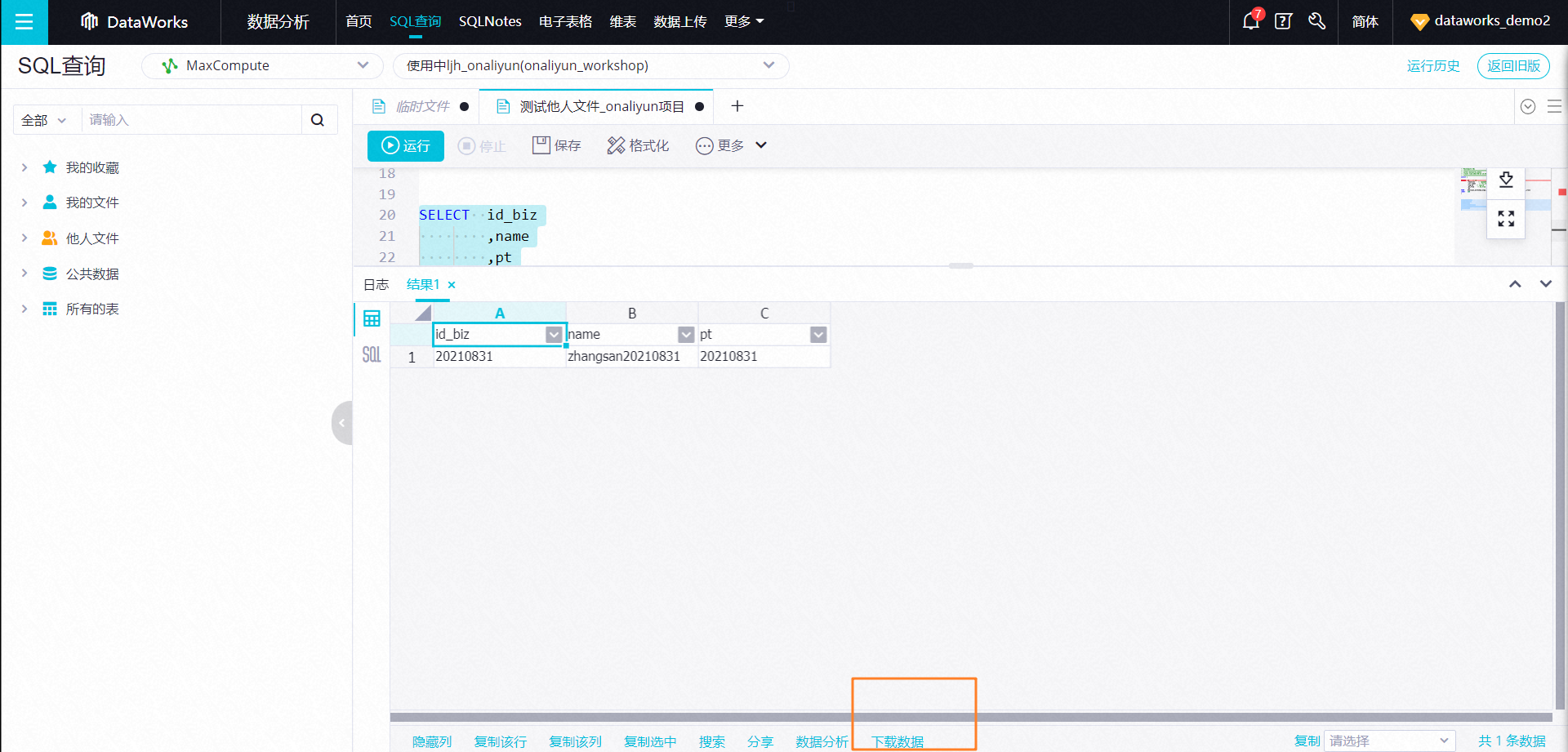

step2:SQL查询结果下载。

【下载方式三】SQLTask配合Tunnel实现量数据导出

限制:支持全量下载。,此回答整理自钉群“DataWorks交流群(答疑@机器人)”

DataWorks基于MaxCompute/Hologres/EMR/CDP等大数据引擎,为数据仓库/数据湖/湖仓一体等解决方案提供统一的全链路大数据开发治理平台。