📋 个人简介

- 💖 作者简介:大家好,我是阿牛😜

- 💬格言:迄今所有人生都大写着失败,但不妨碍我继续向前!🔥

🧨前言

百度贴吧!曾今一代人的回忆,曾经用了一年时间就成长为了全球最大的中文社区。用户量超 15 亿,曾诞生无数金句!“贾君鹏,你妈喊你回家吃饭”、“帝吧出征,寸草不生”,当年流行一句“吧友一起吼一吼,整个互联网都要抖三抖。”由此可见当年的贴吧多么火爆,即使今天大不如从前了,但阿牛依旧是贴吧资深吧友,闲暇时常去刷搞笑段子,那么今天阿牛对贴吧下手了!

🧧分析

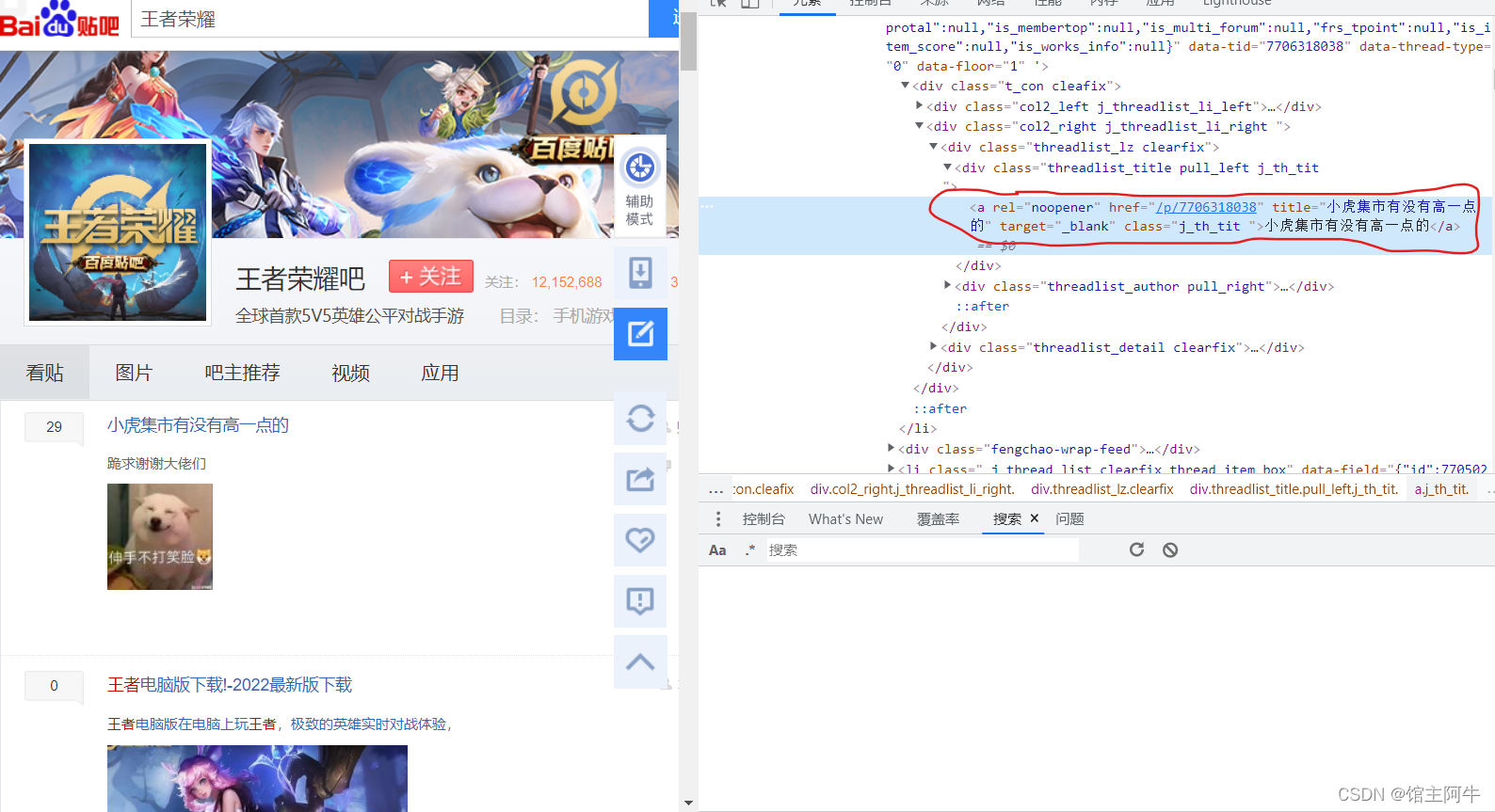

今天目标是帖子的标题和链接,从标题中就可以看出很多内容了,接下来做一个分页处理就好了

可以观察出页码是由pn参数决定的,第一页pn=0,第二页pn=50,第三页pn=100,以此类推。另外,可以看到链接中的参数kw就是我们搜索的参数,可以用上,把爬虫写活一点!

正常分析就完成了,那我们上代码看看

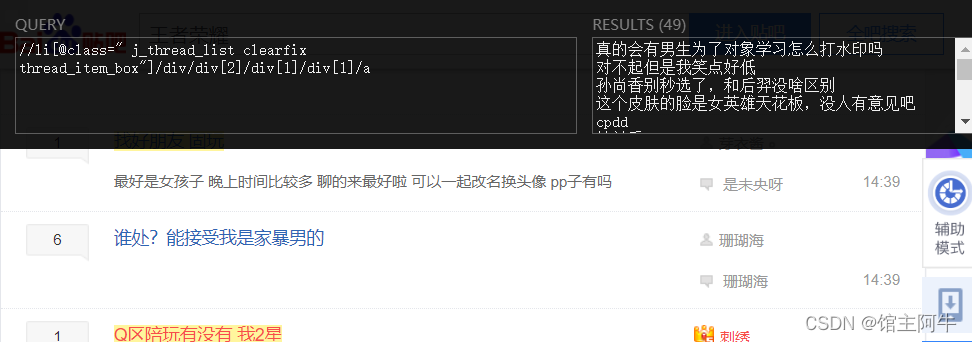

好家伙,出问题了,没有匹配到所有要提取信息的元素节点,列表为空,这可把阿牛整懵了,学到现在,阿牛对xpath一直用xpath helper,不会出错,不信你们看:

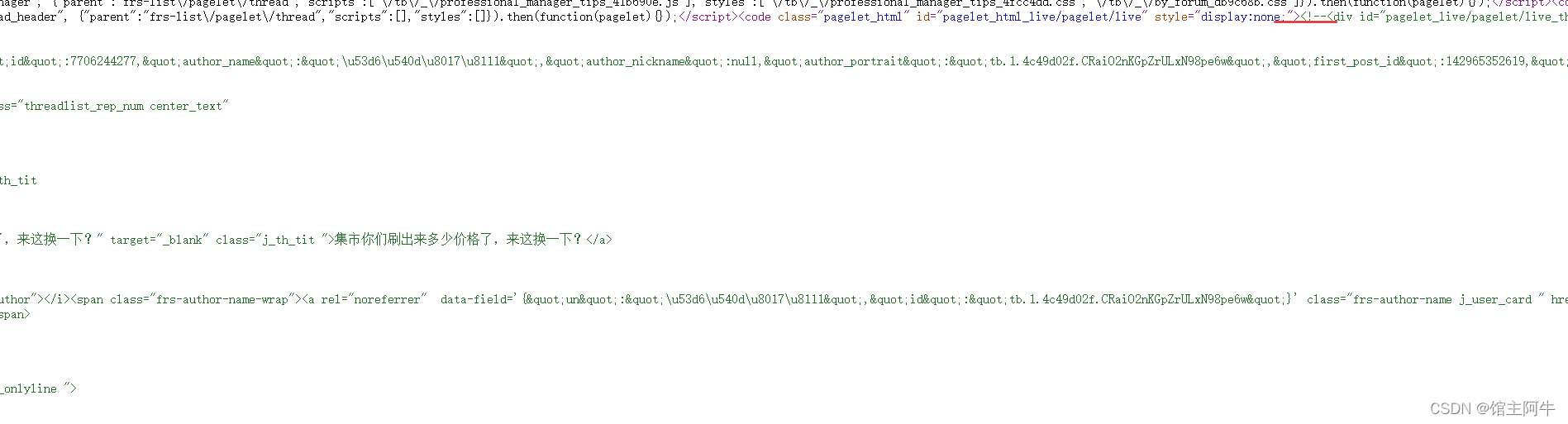

正常猜想是反爬了,不急,先打开网页源代码看一手,不看不知道,一看吓一跳,源码中内容是注释掉的,在浏览器通过渲染去掉了注释。

所以我们拿到的内容是注释掉的,需要处理去掉HTML的注释符号,我们的xpath才能生效。

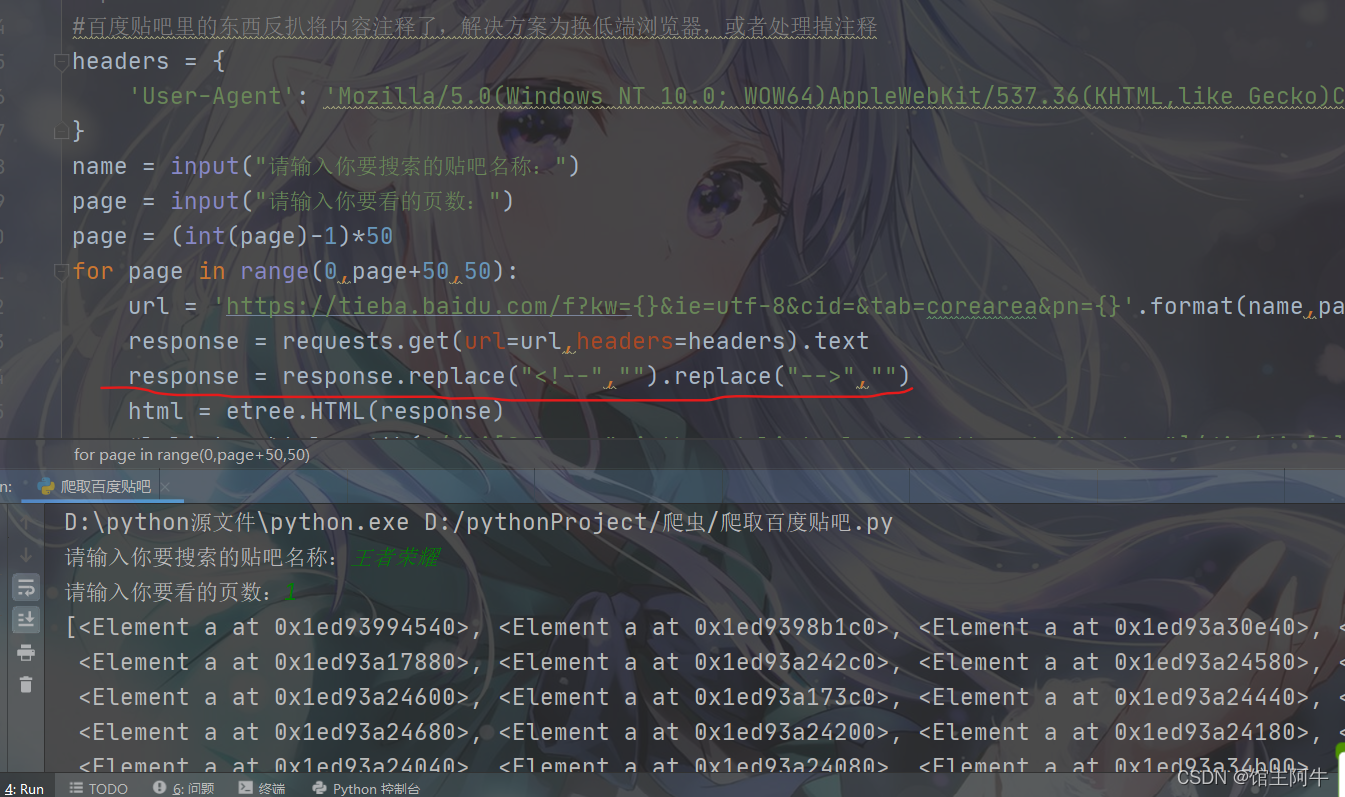

果然去掉注释后我们拿到了对象,接下来我们就可以进行数据提取了,最后把他存为csv文件。

🧧源码

import requests

from lxml import etree

import csv

#百度贴吧里的东西反扒将内容注释了,解决方案为换低端浏览器,或者处理掉注释

headers = {

'User-Agent': 'Mozilla/5.0(Windows NT 10.0; WOW64)AppleWebKit/537.36(KHTML,like Gecko)Chrome/90.0.4430.85 Safari/537.',

}

name = input("请输入你要搜索的贴吧名称:")

page = input("请输入你要看的页数:")

page = (int(page)-1)*50

for page in range(0,page+50,50):

url = 'https://tieba.baidu.com/f?kw={}&ie=utf-8&cid=&tab=corearea&pn={}'.format(name,page)

response = requests.get(url=url,headers=headers).text

#去掉html的注释符号

response = response.replace("<!--","").replace("-->","")

html = etree.HTML(response)

el_list = html.xpath('//li[@class=" j_thread_list clearfix thread_item_box"]/div/div[2]/div[1]/div[1]/a')

# print(el_list)

# newline='' 去掉存进csv文件内容之间的空行

with open("贴吧.csv", "w", encoding="utf-8",newline='') as csvfile:

fieldnames = ["title", "link"]

writer = csv.DictWriter(csvfile, fieldnames=fieldnames)

writer.writeheader()

for el in el_list:

temp = {}

temp['title'] = el.xpath("./text()")[0]

#给链接拼接域名

temp['link'] = 'https://tieba.baidu.com'+el.xpath("./@href")[0]

print(temp)

writer.writerow(temp)

print("爬取完毕!")

🧧结果

🧨结语

这都是阿牛很久以前写的,抽空把它写出来,希望对大家有所帮助,我会持续将以前学的慢慢发布到专栏哦!感谢大家的支持!!!