怎么做MECE

MECE主要是用来帮助问题的分析人员找到所有影响预期或者目标的关键因素,并找到所有可能的解决办法。使用它能够帮助管理者快速的对问题进行排序、分析,并快速的找到合适的解决办法。

MECE是通过条理化和最大的完善度理清了你的思路,MECE从你的解决方案的最高层次开始——列出你所必须解决的问题的各项组成内容。

那么使用MECE分析法的两种方法如下:

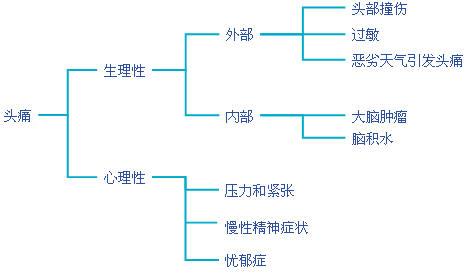

第一种:通过鱼刺图的方式在主要问题的基线上进行问题的分解,找到全部问题的解决办法,这样有助于问题的分析以及解决方案的对比,从而快速的找到最优的办法。

第二种:通过头脑风暴的找到全部问题,在不考虑资源约束的情况下给出全部的解决方案,在全部过程中方案和方案的相互结合很有可能出现新方案。最后再将各种方案的资源等的约束加上,这样通过综合的对比分析找出最优解决办法。

MECE的步骤

对于问题的标准动作: 收集信息->描述发现->得出结论->提出方案。

再将一个问题分解为更详细的内容或者方法的时候,主要有两条原则,第一就是完整性,也就是说不能分解过程中将原来问题的一些keyword丢失了,第二就是独立性,也就是在分解过程中各项工作之间要相互独立,不能互相交织在一起,这也是MECE方法四个单词的重点。当你觉得这些内容已经确定以后,仔细琢磨它们。是不是每一项内容都是独立的、可以清楚区分的事情?如果是,那么你的内容清单就是"相互独立的"。

MECE法的适用性

MECE更容易通过结构化思维理清楚问题的本质逻辑,更加有利于将问题思考的更加完善、有条理,在分析事实、创建假设、证明或者证伪的分析过程中都有着很大的优势。但是这里的结构化思维并不是分解思维,而是通过条理分析完成的问题解决方案的寻找,这样在理清问题的过程中并没有否认事物之间的相互联系。